±ΨΈΡ’ϊάμΉ‘ΧΎ―Ε ΐΨίΚΰ―–ΖΔΗΏΦΕΙΛ≥Χ Π≥¬ΩΓΫή‘Ύ 4 ‘¬ 17 »’ …œΚΘ’Ψ Flink Meetup Ζ÷œμΒΡΓΕΑΌ“ΎΦΕ Β ± ΐΨί»κΚΰ Β’ΫΓΖΘ§ΈΡ’¬ΡΎ»ίΈΣΘΚ

ΧΎ―Ε ΐΨίΚΰΫι…ήΑΌ“ΎΦΕ ΐΨί≥ΓΨΑ¬δΒΊΈ¥ά¥ΙφΜ°ΉήΫαGitHub ΒΊ÷Ζ

https://github.com/apache/flink

ΜΕ”≠¥σΦ“Ηχ Flink Βψ‘όΥΆ star~

¥”…œΆΦΩ…“‘Ω¥≥ωά¥Θ§’ϊΗωΤΫΧ®±»Ϋœ¥σΘ§Αϋά®ΝΥ ΐΨίΫ”»κΓΔ…œ≤ψΒΡΖ÷ΈωΓΔ÷–ΦδΒΡΙήάμ (»γ»ΈΈώΙήάμΘ§Ζ÷ΈωΙήάμΚΆ“ΐ«φΙήάμ)Θ§‘ΌΒΫΉνœ¬≤ψΒΡ Table FormatΓΘ

ΕΰΓΔΑΌ“ΎΦΕ ΐΨί¬δΒΊ≥ΓΨΑ¬δΒΊ1. ¥ΪΆ≥ΤΫΧ®ΦήΙΙ

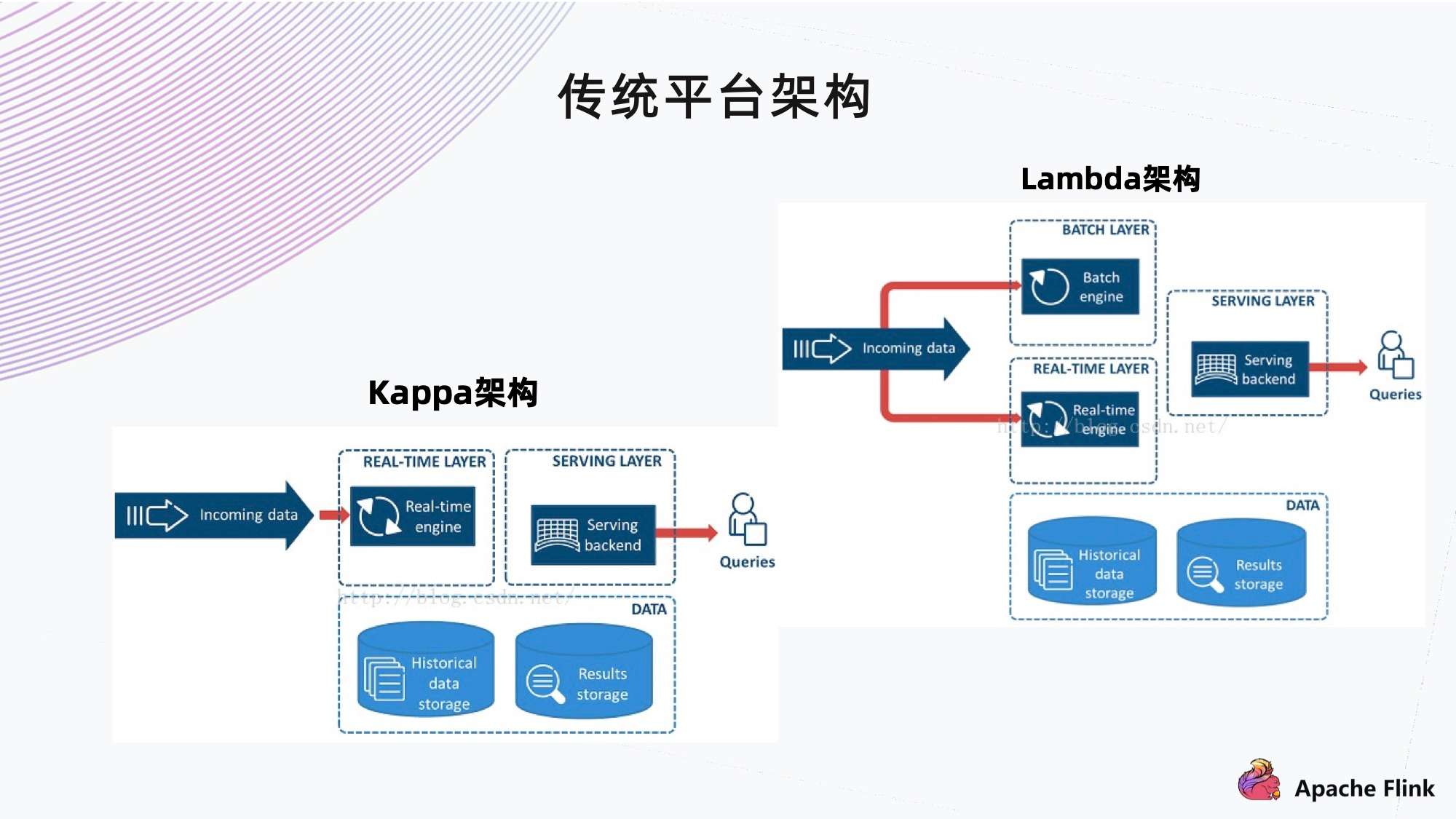

»γ…œΆΦΥυ ΨΘ§Ιΐ»ΞΒΡ¥ΪΆ≥ΤΫΧ®ΦήΙΙΈόΖ« «ΝΫ÷÷Θ§“Μ÷÷ « Lambda ΦήΙΙΘ§“Μ÷÷ « Kappa ΦήΙΙΘΚ

Lambda ΦήΙΙ÷–Θ§≈ζΚΆΝς «Ζ÷ΩΣΒΡΘ§Υυ“‘‘ΥΈ§“Σ”–ΝΫΧΉΦ·»ΚΘ§“ΜΧΉ « For Spark/HiveΘ§“ΜΧΉ « For FlinkΓΘ’β¥φ‘ΎΦΗΗωΈ ΧβΘΚ

ΒΎ“Μ «‘ΥΈ§ΒΡ≥…±Ψ±»Ϋœ¥σΘΜΒΎΕΰ «ΩΣΖΔ≥…±ΨΓΘάΐ»γ‘Ύ“ΒΈώΖΫΟφΘ§“ΜΜα“Σ–¥ SparkΘ§“ΜΜα“Σ–¥ Flink Μρ’Ώ SQLΘ§ΉήΧεά¥ΥΒΘ§ΩΣΖΔ≥…±ΨΕ‘ ΐΨίΖ÷Έω»Υ‘±≤Μ «ΧΊ±π”―ΚΟΓΘΒΎΕΰΗω « Kappa ΦήΙΙΓΘΤδ ΒΨΆ «œϊœΔΕ”Ν–Θ§ΒΫΒΉ≤ψΒΡ¥Ϊ δΘ§‘ΌΒΫΚσΟφ»ΞΉω“Μ–©Ζ÷ΈωΓΘΥϋΒΡΧΊΒψ «±»ΫœΩλΘ§Μυ”Ύ Kafka ”–“ΜΕ®ΒΡ Β ±–‘ΓΘ’βΝΫ÷÷ΦήΙΙΗς”–άϊ±ΉΘ§Ήν¥σΒΡΈ Χβ «¥φ¥ΔΩ…ΡήΜα≤ΜΆ≥“ΜΘ§ΒΦ÷¬ ΐΨίΝ¥¬ΖΗνΝ―ΓΘΡΩ«ΑΈ“Ο«ΤΫΧ®“―Ψ≠Ϋ”»κΝΥ IcebergΘ§œ¬ΟφΜαΗυΨί≤ΜΆ§≥ΓΨΑΘ§≤ϊ ω”ωΒΫΒΡΈ ΧβΦΑΫβΨωΒΡΙΐ≥ΧΓΘ

2. ≥ΓΨΑ“Μ: ÷ Q Α≤»Ϊ ΐΨί»κΚΰ

÷Μζ QQ Α≤»Ϊ ΐΨί»κΚΰ «“ΜΗωΖ«≥ΘΒδ–ΆΒΡ≥ΓΨΑΓΘ

ΡΩ«ΑΒΡ“ΒΈώ≥ΓΨΑ «œϊœΔΕ”Ν– TubeMQ Ά®Ιΐ Flink ¬δΒΊ≥… ODS ΒΫ IcebergΘ§»ΜΚσ‘Ό”Ο Flink Ήω“Μ–©”ΟΜß±μΒΡΙΊΝΣΘ§÷°ΚσΉω≥…“ΜΗωΩμ±μ»ΞΉω“Μ–©≤ι―·Θ§Ζ≈ΒΫ COS ÷–Θ§Ω…ΡήΜα‘Ύ BI ≥ΓΨΑΉω“Μ–©Ζ÷ΈωΓΘ

’βΗωΙΐ≥ΧΩ¥ΥΤΤΫΤΫΈόΤφΘ§ΒΪ «“Σ÷ΣΒάΘ§ ÷ Q ΒΡ”ΟΜßΙΊΝΣΈ§±μΈΣ 28 “ΎΘ§ΟΩΧλΒΡœϊœΔΕ”Ν– «ΑΌ“ΎΦΕΒΡΘ§“ρ¥ΥΜαΟφΝΌ“ΜΕ®ΒΡΧτ’ΫΓΘ

–ΓΈΡΦΰΧτ’Ϋ

Flink Writer ≤ζ…ζ–ΓΈΡΦΰFlink –¥»κΟΜ”– shuffleΘ§Ζ÷ΖΔΒΡ ΐΨίΈό–ρΘ§ΒΦ÷¬–ΓΈΡΦΰΕύΓΘ

―”≥Ό“Σ«σΗΏcheckpoint ΦδΗτΕΧΘ§commit ΦδΗτ–ΓΘ§Ζ≈¥σ–ΓΈΡΦΰΈ ΧβΓΘ

–ΓΈΡΦ౧’®ΦΗΧλ ±Φδ‘Σ ΐΨίΚΆ ΐΨίΒΡ–ΓΈΡΦΰΆ§ ±±§’®Θ§Φ·»Κ―ΙΝΠΨό¥σΓΘ

Κœ≤Δ–ΓΈΡΦΰ”÷Ζ≈¥σΈ ΧβΈΣΝΥΫβΨω–ΓΈΡΦΰΈ ΧβΘ§ΩΣ Action Ϋχ–––ΓΈΡΦΰΚœ≤ΔΘ§ΫαΙϊ≤ζ…ζΗϋΕύΈΡΦΰΓΘ

ά¥≤ΜΦΑ…Ψ ΐΨί…Ψ≥ΐΩλ’’Θ§…ΨΙ¬ΕυΈΡΦΰΘ§ΒΪ «…®ΟηΈΡΦΰΧΪΕύΘ§namenode ―ΙΝΠΨό¥σΓΘ

ΫβΨωΖΫΑΗ

Flink Ά§≤ΫΚœ≤Δ

‘ωΦ”–ΓΈΡΦΰΚœ≤Δ OperatorsΘΜ‘ωΦ” Snapshot Ή‘Ε·«εάμΜζ÷ΤΓΘ1Θ©snapshot.retain-last.nums

2Θ©snapshot.retain-last.minutes

Spark “λ≤ΫΚœ≤Δ

‘ωΦ”ΚσΧ®ΖΰΈώΫχ–––ΓΈΡΦΰΚœ≤ΔΚΆΙ¬ΕυΈΡΦΰ…Ψ≥ΐΘΜ‘ωΦ”–ΓΈΡΦΰΙΐ¬Υ¬ΏΦ≠Θ§÷π≤Ϋ…Ψ≥ΐ–ΓΈΡΦΰΘΜ‘ωΦ”Α¥Ζ÷«χΚœ≤Δ¬ΏΦ≠Θ§±ήΟβ“Μ¥Έ…ζ≥…ΧΪΕύ…Ψ≥ΐΈΡΦΰΒΦ÷¬»ΈΈώ OOMΓΘFlink Ά§≤ΫΚœ≤Δ

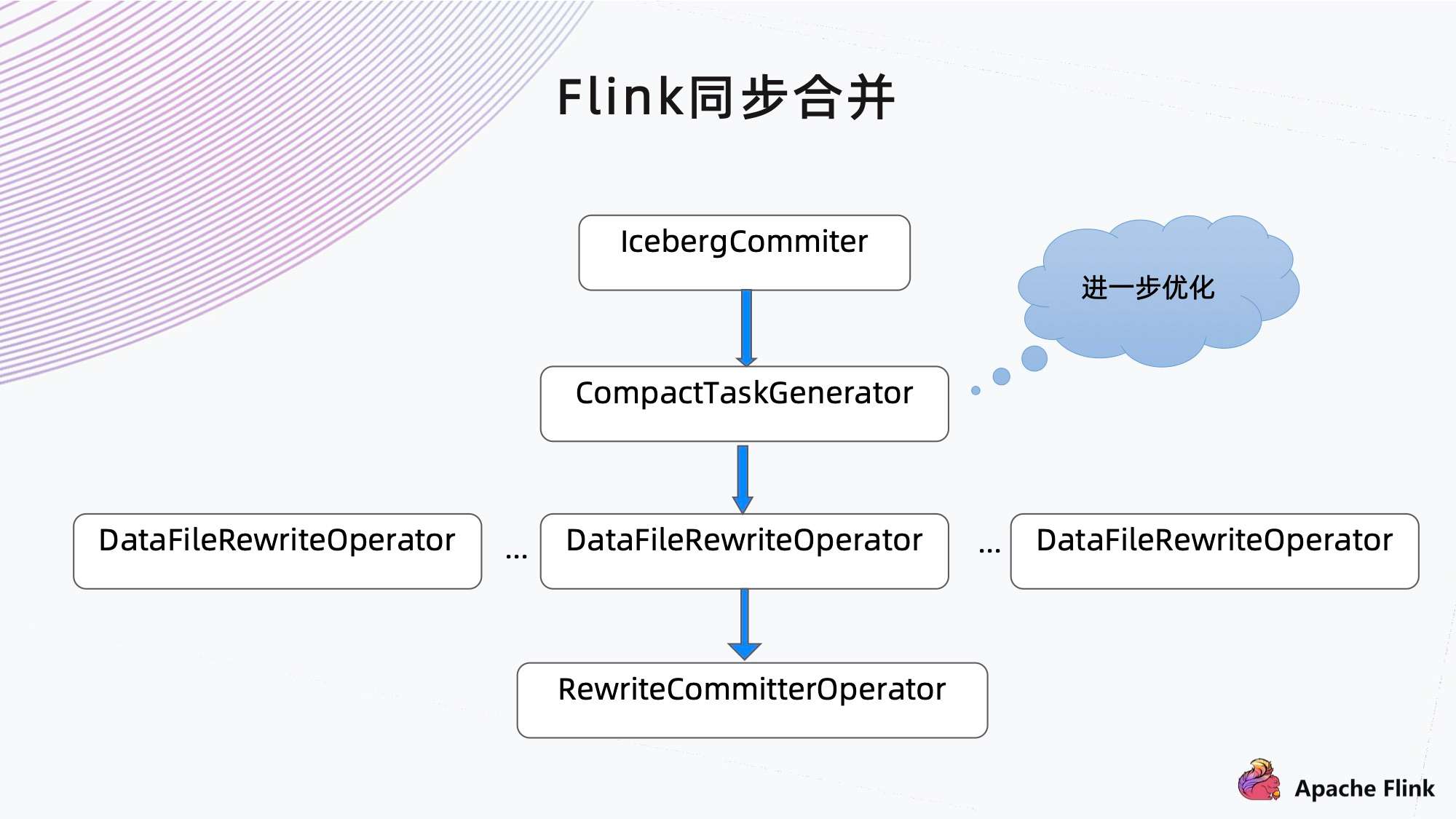

Α―Υυ”–ΒΡ Data ΈΡΦΰ Commit ÷°ΚσΘ§Μα≤ζ…ζ“ΜΗω Commit ResultΓΘΈ“Ο«ΜαΡΟ Commit Result …ζ≥…“ΜΗω―ΙΥθΒΡ»ΈΈώΘ§‘ΌΗχΥϋ≤ΔΖΔ≥…ΕύΗω Task Manager »ΞΉω Rewrite ΒΡΙΛΉςΘ§Ήν÷’Α―ΫαΙϊ Commit ΒΫ Iceberg ±μάοΟφΓΘ

Β±»ΜΘ§’βάοΟφΒΡΙΊΦϋΥυ‘Ύ « CompactTaskGenerator ‘θΟ¥ΉωΓΘΗ’ΩΣ ΦΒΡ ±ΚρΈ“Ο«œκΨΓΝΩΒΊΚœ≤ΔΘ§”Ύ «»ΞΉω±μΒΡ scanΘ§Α―ΚήΕύΈΡΦΰΕΦ…®“Μ±ιΓΘ»ΜΕχΥϋΒΡ±μΖ«≥Θ¥σΘ§–ΓΈΡΦΰΖ«≥ΘΕύΘ§“Μ…® ΙΒΟ’ϊΗω Flink ΝΔ¬μΙ“ΒτΓΘ

Έ“Ο«œκΝΥΗωΖΫΖ®Θ§ΟΩ¥ΈΚœ≤ΔΆξΘ§‘ωΝΩΒΊ»Ξ…® ΐΨίΓΘ¥”…œ“ΜΗω Replace Operation άοΟφΒΫœ÷‘ΎΉω“ΜΗω‘ωΝΩΘ§Ω¥’β÷–Φδ”÷‘ωΝΥΕύ…ΌΘ§ΡΡ–©ΖϊΚœ Rewrite ΒΡ≤Ώ¬‘ΓΘ

’βάοΟφΤδ Β”––μΕύ≈δ÷ΟΘ§»ΞΩ¥¥οΒΫΝΥΕύ…ΌΗω snapshotΘ§Μρ’Ώ¥οΒΫΝΥΕύ…ΌΗωΈΡΦΰΩ…“‘»ΞΉωΚœ≤ΔΘ§’β–©ΒΊΖΫ”ΟΜßΩ…“‘Ή‘ΦΚ…η÷ΟΓΘΒ±»ΜΘ§Έ“Ο«±Ψ…μ“≤…η”–Ρ§»œ÷ΒΘ§¥”Εχ±Θ÷Λ”ΟΜßΈόΗ–÷ΣΒΊ Ι”Ο’β–©ΙΠΡήΓΘ

Fanout Writer ΒΡΩ”

‘Ύ Fanout Writer ±Θ§»γΙϊ ΐΨίΝΩ¥σΩ…ΡήΜα”ωΒΫΕύ≤ψΖ÷«χΓΘ±»»γ ÷ Q ΒΡ ΐΨίΖ÷ ΓΓΔΖ÷ –ΘΜΒΪΖ÷Άξ÷°ΚσΜΙ «Κή¥σΘ§”Ύ «”÷Ζ÷ bucketΓΘ¥Υ ±ΟΩΗω Task Manager άοΩ…ΡήΖ÷ΒΫΚήΕύΖ÷«χΘ§ΟΩΗωΖ÷«χ¥ρΩΣ“ΜΗω WriterΘ§Writer ΨΆΜαΖ«≥ΘΒΡΕύΘ§‘λ≥…ΡΎ¥φ≤ΜΉψΓΘ

’βάοΈ“Ο«ΉωΝΥΝΫΦΰ ¬«ιΘΚ

ΒΎ“Μ « KeyBy ÷ß≥÷ΓΘΗυΨί”ΟΜß…η÷ΟΒΡΖ÷«χΉω KeyBy ΒΡΕ·ΉςΘ§»ΜΚσΑ―œύΆ§Ζ÷«χΒΡΨέΦ·‘Ύ“ΜΗω Task Manager ÷–Θ§’β―υΥϋΨΆ≤ΜΜα¥ρΩΣΡ«Ο¥ΕύΖ÷«χΒΡ WriterΓΘΒ±»ΜΘ§’β―υΒΡΉωΖ®Μα¥χά¥“Μ–©–‘Ρή…œΒΡΥπ ßΓΘΒΎΕΰ «Ήω LRU WriterΘ§‘ΎΡΎ¥φάοΟφΈ§≥÷“ΜΗω MapΓΘ3. ≥ΓΨΑΕΰΘΚ–¬Έ≈ΤΫΧ®Υς“ΐΖ÷Έω

…œΖΫ «Μυ”Ύ Iceberg Νς≈ζ“ΜΧεΒΡ–¬Έ≈ΈΡ’¬‘ΎœΏΥς“ΐΦήΙΙΓΘΉσ±Ώ « Spark ≤…Φ· HDFS …œΟφΒΡΈ§±μΘ§”“±Ώ «Ϋ”»κœΒΆ≥Θ§≤…Φ·“‘ΚσΜα”Ο Flink ΚΆΈ§±μΉω“ΜΗωΜυ”Ύ Window ΒΡ JoinΘ§»ΜΚσ–¥ΒΫΥς“ΐΝςΥ°±μ÷–ΓΘ

ΙΠΡή

ΉΦ Β ±ΟςœΗ≤ψΘΜ Β ±Νς ΫœϊΖ―ΘΜΝς Ϋ MERGE INTOΘΜΕύΈ§Ζ÷ΈωΘΜάκœΏΖ÷ΈωΓΘ≥ΓΨΑΧΊΒψ

…œ ω≥ΓΨΑ”–“‘œ¬ΦΗΗωΧΊΒψΘΚ

ΐΝΩΦΕΘΚΥς“ΐΒΞ±μ≥§«ß“ΎΘ§ΒΞ batch 2000 ΆρΘ§»’Ψυ«ß“ΎΘΜ ±―”–η«σΘΚΕΥΒΫΕΥ ΐΨίΩ…Φϊ–‘Ζ÷÷”ΦΕΘΜ ΐΨί‘¥ΘΚ»ΪΝΩΓΔΉΦ Β ±‘ωΝΩΓΔœϊœΔΝςΘΜœϊΖ―ΖΫ ΫΘΚΝς ΫœϊΖ―ΓΔ≈ζΦ”‘ΊΓΔΒψ≤ιΓΔ––Ηϋ–¬ΓΔΕύΈ§Ζ÷ΈωΓΘΧτ’ΫΘΚMERGE INTO

”–”ΟΜßΧα≥ωΝΥ Merge Into ΒΡ–η«σΘ§“ρ¥ΥΈ“Ο«¥”»ΐΗωΖΫΟφΫχ––ΝΥΥΦΩΦΘΚ

ΙΠΡήΘΚΫΪΟΩΗω batch join ΚσΒΡΝςΥ°±μ Merge into ΒΫ Β ±Υς“ΐ±μΘ§Ι©œ¬”Έ Ι”ΟΘΜ–‘ΡήΘΚœ¬”ΈΕ‘Υς“ΐ ±–ß–‘“Σ«σΗΏΘ§–η“ΣΩΦ¬« merge into ΡήΉΖ…œ…œ”ΈΒΡ batch œϊΖ―¥ΑΩΎΘΜ“Ή”Ο–‘ΘΚTable APIΘΩΜΙ « Action APIΘΩ”÷Μρ « SQL APIΘΩΫβΨωΖΫΑΗ

ΒΎ“Μ≤Ϋ

≤ΈΩΦ Delta Lake …ηΦΤ JoinRowProcessorΘΜάϊ”Ο Iceberg ΒΡ WAP Μζ÷Τ–¥ΝΌ ±Ωλ’’ΓΘΒΎΕΰ≤Ϋ

Ω…―Γ‘ώΧχΙΐ Cardinality-checkΘΜ–¥»κ ±Ω…“‘―Γ‘ώ÷Μ hashΘ§≤Μ≈≈–ρΓΘΒΎ»ΐ≤Ϋ

÷ß≥÷ DataframeAPIΘΜSpark 2.4 ÷ß≥÷ SQLΘΜSpark 3.0 Ι”Ο…γ«χΑφ±ΨΓΘ4. ≥ΓΨΑ»ΐΘΚΙψΗφ ΐΨίΖ÷ΈωΙψΗφ ΐΨί÷ς“Σ”–“‘œ¬ΦΗΗωΧΊΒψΘΚ

ΐΝΩΦΕΘΚ»’Ψυ«ß“Ύ PB ΐΨίΘ§ΒΞΧθ 2KΘΜ ΐΨί‘¥ΘΚSparkStreaming ‘ωΝΩ»κΚΰΘΜ ΐΨίΧΊΒψΘΚ±ξ«©≤ΜΆΘ‘ωΦ”Θ§schema ≤ΜΆΘ±δΜΜΘΜ Ι”ΟΖΫ ΫΘΚΫΜΜΞ Ϋ≤ι―·Ζ÷ΈωΓΘ”ωΒΫΒΡΧτ’Ϋ”κΕ‘”ΠΒΡΫβΨωΖΫΑΗΘΚ

Χτ’Ϋ“ΜΘΚSchema «ΕΧΉΗ¥‘”Θ§ΤΫΤΧΚσΫϋΆρΝ–Θ§“Μ–¥ΨΆ OOMΓΘΫβΨωΖΫΑΗΘΚΡ§»œΟΩΗω Parquet Page Size …η÷ΟΈΣ 1MΘ§–η“ΣΗυΨί Executor ΡΎ¥φΫχ–– Page Size …η÷ΟΓΘ

Χτ’ΫΕΰΘΚ30 Χλ ΐΨίΜυ±ΨΦ·»Κ≥≈±§ΓΘΫβΨωΖΫΑΗΘΚΧαΙ© Action Ϋχ––…ζΟϋ÷ήΤΎΙήάμΘ§ΈΡΒΒ«χΖ÷…ζΟϋ÷ήΤΎΚΆ ΐΨί…ζΟϋ÷ήΤΎΓΘ

Χτ’Ϋ»ΐΘΚΫΜΜΞ Ϋ≤ι―·ΓΘ

ΫβΨωΖΫΑΗΘΚ

1Θ©column projectionΘΜ2Θ©predicate push downΓΘ»ΐΓΔΈ¥ά¥ΙφΜ°Ε‘”ΎΈ¥ά¥ΒΡΙφΜ°÷ς“ΣΖ÷ΈΣΡΎΚΥ≤ύ”κΤΫΧ®≤ύΓΘ

1. ΡΎΚΥ≤ύ‘ΎΈ¥ά¥Θ§Έ“Ο«œΘΆϊ‘ΎΡΎΚΥ≤ύ”–“‘œ¬ΦΗΒψΙφΜ°ΘΚ

ΗϋΕύΒΡ ΐΨίΫ”»κ

‘ωΝΩ»κΚΰ÷ß≥÷ΘΜV2 Format ÷ß≥÷ΘΜRow Identity ÷ß≥÷ΓΘΗϋΩλΒΡ≤ι―·

Υς“ΐ÷ß≥÷ΘΜAlloxio Φ”ΥΌ≤ψ÷ß≥÷ΘΜMOR ”≈Μ·ΓΘΗϋΚΟΒΡ ΐΨί÷Έάμ

ΐΨί÷Έάμ ActionΘΜSQL Extension ÷ß≥÷ΘΜΗϋΚΟΒΡ‘Σ ΐΨίΙήάμΓΘ2. ΤΫΧ®≤ύ‘ΎΤΫΧ®≤ύΈ“Ο«”–“‘œ¬ΦΗΒψΙφΜ°ΘΚ

ΐΨί÷ΈάμΖΰΈώΜ·

‘Σ ΐΨί«εάμΖΰΈώΜ·ΘΜ ΐΨί÷ΈάμΖΰΈώΜ·ΓΘ‘ωΝΩ»κΚΰ÷ß≥÷

Spark œϊΖ― CDC »κΚΰΘΜFlink œϊΖ― CDC »κΚΰΓΘ÷Η±ξΦύΩΊΗφΨ·

–¥»κ ΐΨί÷Η±ξΘΜ–ΓΈΡΦΰΦύΩΊΚΆΗφΨ·ΓΘΥΡΓΔΉήΫαΨ≠Ιΐ¥σΝΩ…ζ≤ζ…œΒΡ”Π”Ο”κ ΒΦυΘ§Έ“Ο«ΒΟΒΫ»ΐΖΫΟφΒΡΉήΫαΘΚ

Ω…”Ο–‘ΘΚΆ®ΙΐΕύΗω“ΒΈώœΏΒΡ Β’ΫΘ§»Ζ»œ Iceberg Ψ≠ΒΟΤπ»’ΨυΑΌ“ΎΘ§…θ÷Ν«ß“ΎΒΡΩΦ―ιΓΘ“Ή”Ο–‘ΘΚ Ι”ΟΟ≈Φς±»ΫœΗΏΘ§–η“ΣΉωΗϋΕύΒΡΙΛΉς≤≈Ρή»Ο”ΟΜß Ι”ΟΤπά¥ΓΘ≥ΓΨΑ÷ß≥÷ΘΚΡΩ«Α÷ß≥÷ΒΡ»κΚΰ≥ΓΨΑ ΜΙΟΜ”– Hudi ΕύΘ§‘ωΝΩΕΝ»Γ’βΩι“≤±»Ϋœ»± ßΘ§–η“Σ¥σΦ“≈§ΝΠ≤ΙΤκΓΘΝμΆβΓΪΓΕApache Flink- Β ±ΦΤΥψ’ΐΒ± ±ΓΖΒγΉ” ι÷ΊΑθΖΔ≤ΦΘ§±Ψ ιΫΪ÷ζΡζ«αΥ… Get Apache Flink 1.13 Αφ±ΨΉν–¬ΧΊ’ςΘ§Ά§ ±ΜΙΑϋΚ§÷ΣΟϊ≥ß…ΧΕύ≥ΓΨΑ Flink Β’ΫΨ≠―ιΘ§―ß”Ο“ΜΧεΘ§Η…ΜθΕύΕύΘΓΩλΒψΜςœ¬ΖΫΝ¥Ϋ”Νλ»ΓΑ…ΓΪ

https://developer.aliyun.com/article/784856?spm=a2c6h.13148508.0.0.61644f0eskgxgo

ΜνΕ·ΆΤΦω

ΑΔάο‘ΤΜυ”Ύ Apache Flink ΙΙΫ®ΒΡΤσ“ΒΦΕ≤ζΤΖ- Β ±ΦΤΥψ Flink Αφœ÷ΩΣΤτœό ±ΜνΕ·ΘΚ

0‘Σ ‘”Ο Β ±ΦΤΥψ Flink »ΪΆ–ΙήΑφ±ΨΘ®ΑϋΡξΑϋ‘¬ΓΔ10CUΘ©Φ¥Ω…”–ΜζΜαΜώΒΟ Flink ΕάΦ“Ε®÷ΤT–τΘΜΝμΑϋ3Ηω‘¬ΦΑ“‘…œΜΙ”–85’έ”≈ΜίΘΓ

ΝΥΫβΜνΕ·œξ«ιΘΚhttps://www.aliyun.com/product/bigdata/sc

2021Ρξ3‘¬24»’Θ§÷ςΧβΈΣΓΕ ΐΨίΒΡ άΫγΘ§ άΫγΒΡ ΐΨίΓΖΒΡ–«ΜΖΩΤΦΦ2021¥ΚΦΨ–¬ΤΖΖΔ≤ΦΜα...

Ϋ®’Ψ ≤Ο¥ –ιΡβ÷ςΜζ ΙΜ”ΟΘΩ’β“ΣΩ¥¥νΫ®ΒΡ « ≤Ο¥άύ–ΆΒΡΆχ’ΨΓΘ±»»γΗω»Υ≤©ΩΆάύ–ΆΒΡΆχ...

«ΑΧαΧθΦΰ «κΡζ‘ΎΙΚ¬ρ«Α»Ζ±Θ“―Άξ≥…ΉΔ≤αΚΆ≥δ÷ΒΓΘœξœΗ≤ΌΉς«κ≤ΈΦϊ »γΚΈΉΔ≤αΙΪ”–‘ΤΙή...

‘ΎPython”ο―‘÷–”–»γœ¬3÷÷ΖΫΖ®ΘΚ ≥…‘±ΖΫΖ® άύΖΫΖ®(classmethod) Ψ≤Χ§ΖΫΖ®(staticm...

Docker…ζ≥…–¬ΨΒœώΑφ±ΨΒΡΝΫ÷÷ΖΫ Ϋ There are two ways Docker can generate new m...

–≈œΔΜ·2.0 ±¥ζΧα≥ωΩΣ’Ι÷«ΜέΫΧ”ΐ¥¥–¬ΖΔ’Ι––Ε·ΓΘ2019Ρξ2‘¬Θ§÷–Ι≤÷–―κΓΔΙζΈώ‘Κ”ΓΖΔ...

’Σ“Σ ‘ΣΒ©ΤΎΦδ Ε©ΒΓ¸ώœΏ Ηφ÷Σ ΆΤΥΆœΒΆ≥ ΈόΖ®’ΐ≥Θ ’ΖΔœϊœΔΘ§ΉςΈΣΆΤΥΆœΒΆ≥Έ§ΜΛ’Ώ...

±ΨΈΡ’ϊάμΉ‘÷±≤ΞΓΕHologres ΐΨίΒΦ»κ/ΒΦ≥ω ΒΦυ-ΆθΜΣΖε(ΦΧ»ε)ΓΖ ”ΤΒΝ¥Ϋ”: https:/...

ΓΨ51CTO.comΩλ“κΓΩ ΐΨίΩ… ”Μ·ΙΛΨΏ≤ΜΕœΖΔ’ΙΘ§ΧαΙ©Ηϋ«Ω¥σΒΡΙΠΡήΘ§Ά§ ±ΗΡ…ΤΩ…ΖΟΈ ...

¥” 10.0.0 ΑφΩΣ ΦΘ§“λ≤ΫΒϋ¥ζΤςΨΆ≥ωœ÷‘Ύ Node ÷–ΝΥΘ§‘Ύ±ΨΈΡ÷–Θ§Έ“Ο«ΫΪΧ÷¬έ“λ≤ΫΒϋ...