超级计算集群SCC(Super Computing Cluster)实例针对E-HPC多机并行计算需求,提供了低延时RDMA(Remote Direct Memory Access)网络互联。SCC实例无虚拟化损耗,同时提供VPC网络隔离能力,您可直接访问硬件资源。SCC实例适合仿真制造、生命科学、机器学习、大规模分子动力学和气象预报等应用场景。本文为您介绍如何创建SCC集群,并测试SCC集群的相关性能。

背景信息

超级计算集群SCC在弹性裸金属服务器基础上,加入高速RDMA互联支持,大幅提升网络性能,提高大规模集群加速比。因此SCC在提供高带宽、低延迟优质网络的同时,还具备弹性裸金属服务器的所有优点。更多信息,请参见超级计算集群概述。

SCC实例与普通ECS实例相比,配备了50 Gbps的RDMA网络,所以网络通信能力与普通ECS实例相比有明显差异。正常的SCC实例会显示如下网口信息,其中eth0为RDMA网口,lo为VPC网口。

E-HPC支持ecs.scchfg6.20xlarge、ecs.scch5s.16xlarge等SCC规格,更多信息,请参见产品规格。

创建SCC集群

登录弹性高性能计算控制台。

创建一个名为HPL.test的SCC集群。具体操作,请参见创建集群。

在配置参数时,您需要注意以下几点:计算节点:本示例中,选择ecs.scch5s.16xlarge实例规格。

软件配置:安装linpack 2018软件和intel-mpi 2018通信库。

创建一个名为hpltest的sudo用户。具体操作,请参见创建用户。

测试SCC集群的网络性能

在左侧导航栏,单击集群。

在集群页面,找到目标集群,单击远程连接。

在远程连接页面,输入集群用户名、登录密码和端口,单击ssh连接。

通过以下测试样例,测试RDMA网络的峰值带宽。

按照以下步骤,测试读带宽的峰值:

登录compute000节点,运行以下命令。

ib_read_bw -a -q 20 --report_gbits ##服务端compute000执行登录compute001节点,运行以下命令。

ib_read_bw -a -q 20 --report_gbits compute000 ##用户端compute001执行

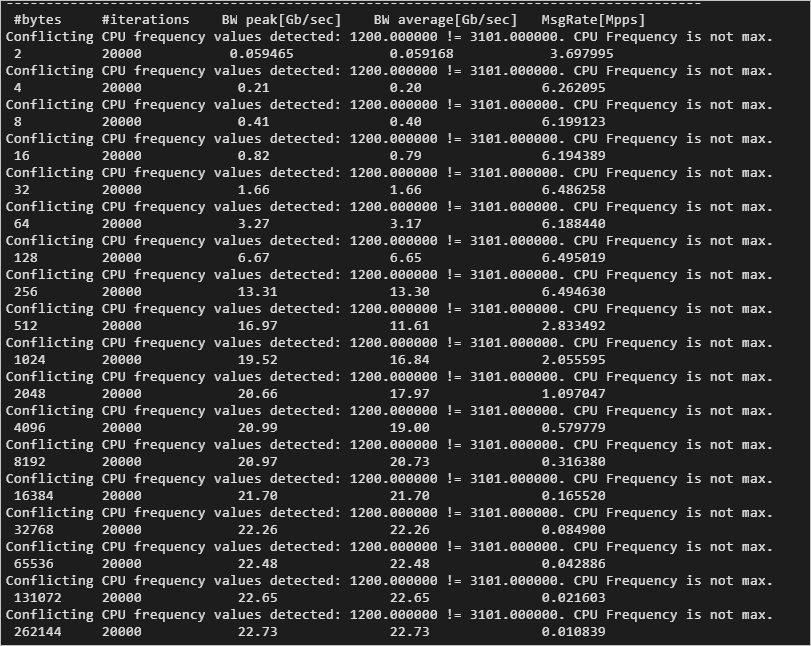

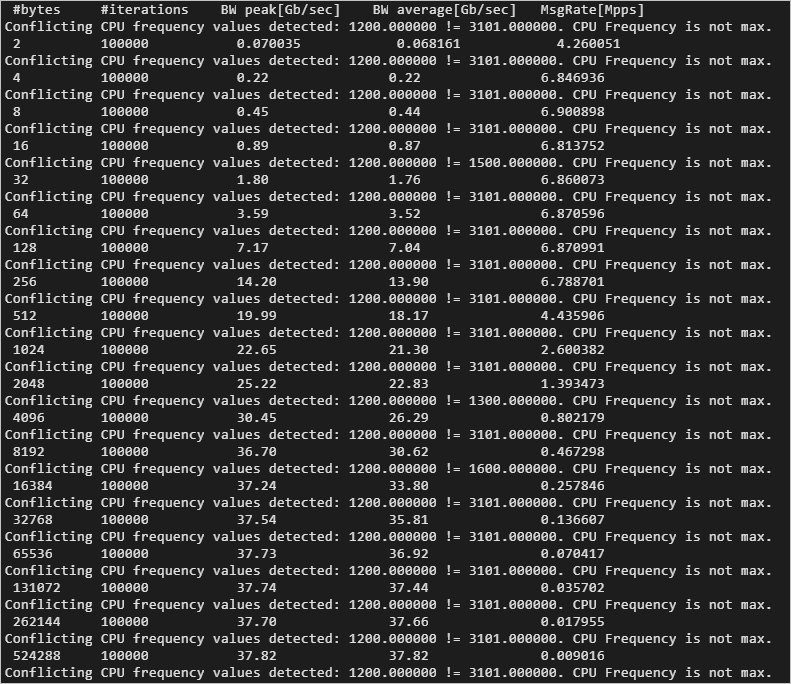

按照以下步骤,测试写带宽的峰值:

登录compute000节点,运行以下命令。

ib_write_bw -a -q 20 --report_gbits ##服务端compute000执行登录compute001节点,运行以下命令。

ib_write_bw -a -q 20 --report_gbits compute000 ##用户端compute001执行

通过以下测试样例,测试RDMA网络的延迟。

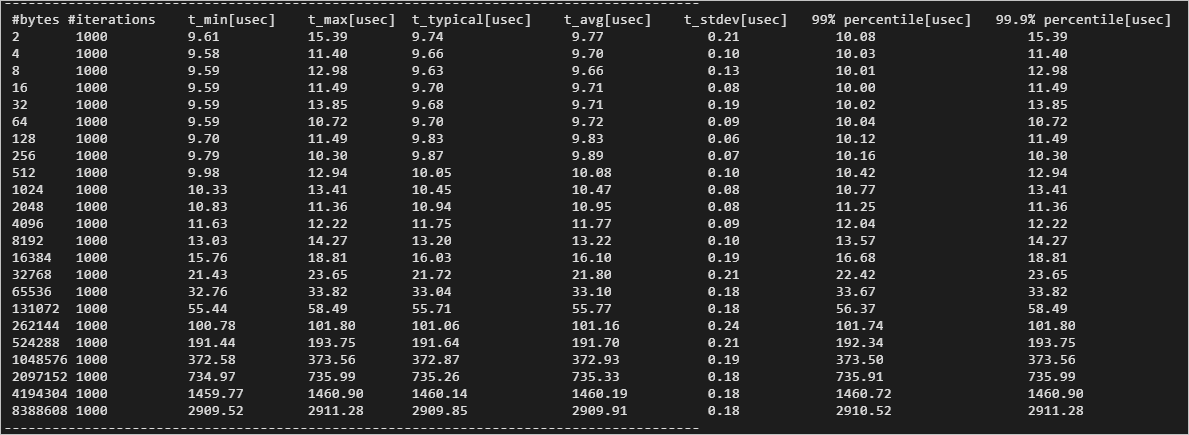

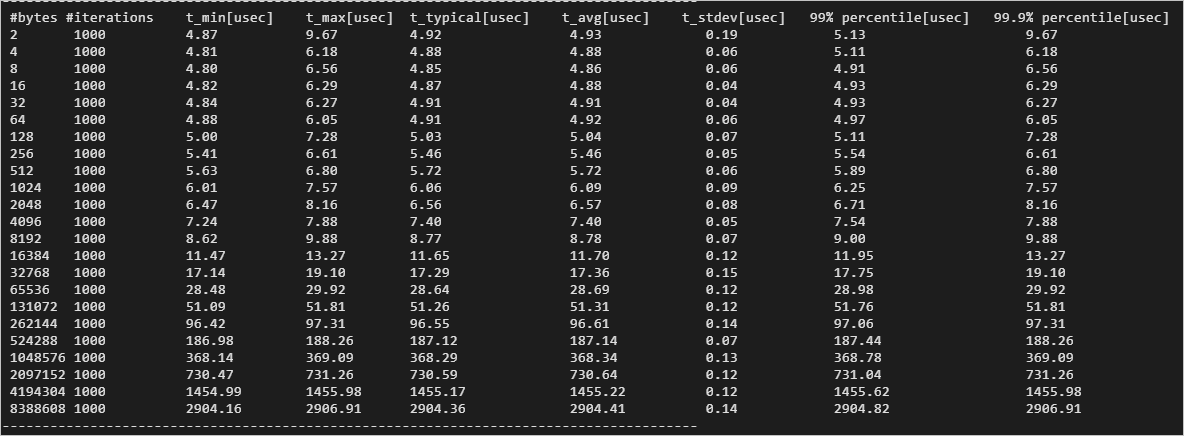

按照以下步骤,测试RDMA网络的读延迟:

登录compute000节点,运行以下命令。

ib_read_lat -a ##服务端compute000执行登录compute001节点,运行以下命令。

ib_read_lat -F -a compute000 ##用户端compute001执行

按照以下步骤,测试RDMA网络的写延迟:

登录compute000节点,运行以下命令。

ib_write_lat -a ##服务端compute000执行登录compute001节点,运行以下命令。

ib_write_lat -F -a compute000 ##用户端compute001执行

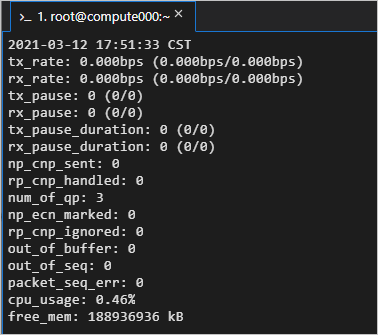

监测RDMA网络的实际带宽利用情况

在左侧导航栏,单击集群。

在集群页面,找到目标集群,单击远程连接。

在远程连接页面,输入root用户名、登录密码和端口,单击ssh连接。

运行以下命令监测RDMA网络的实际带宽利用情况。

rdma_monitor -s

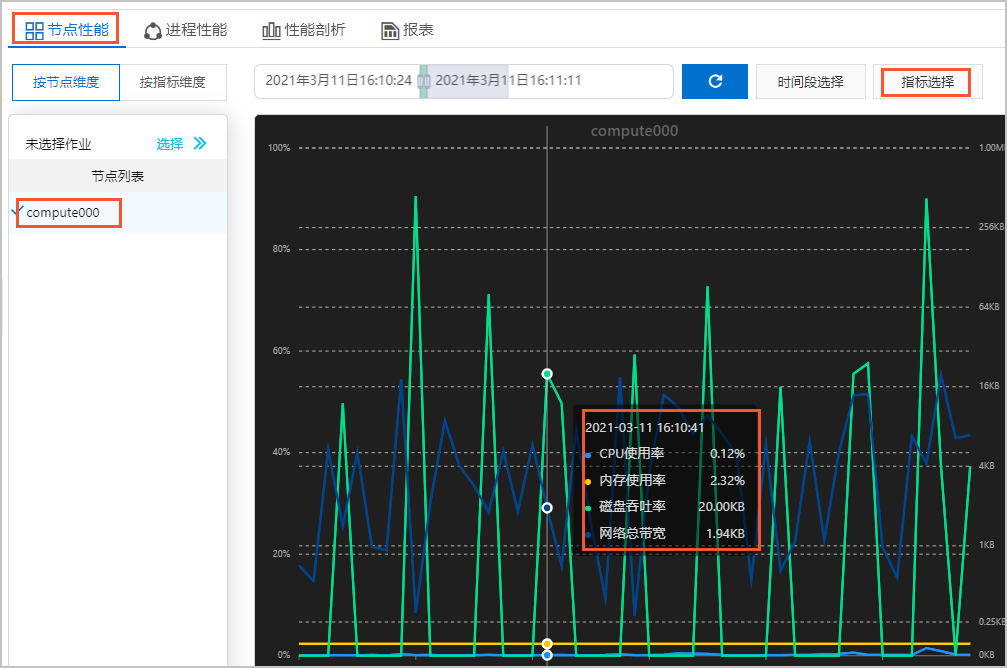

查看SCC集群节点的性能

在左侧导航栏,选择E-HPC优化器。

在集群列表选择目标集群。

在节点性能页签,选择对应的节点和指标即可查看集群节点的相关性能。