AI System AI系统对大模型的影响有多深?

原创AI System AI系统对大模型的影响有多深?要回答这个问题之前,不妨从下面这个问题开始入手思考。

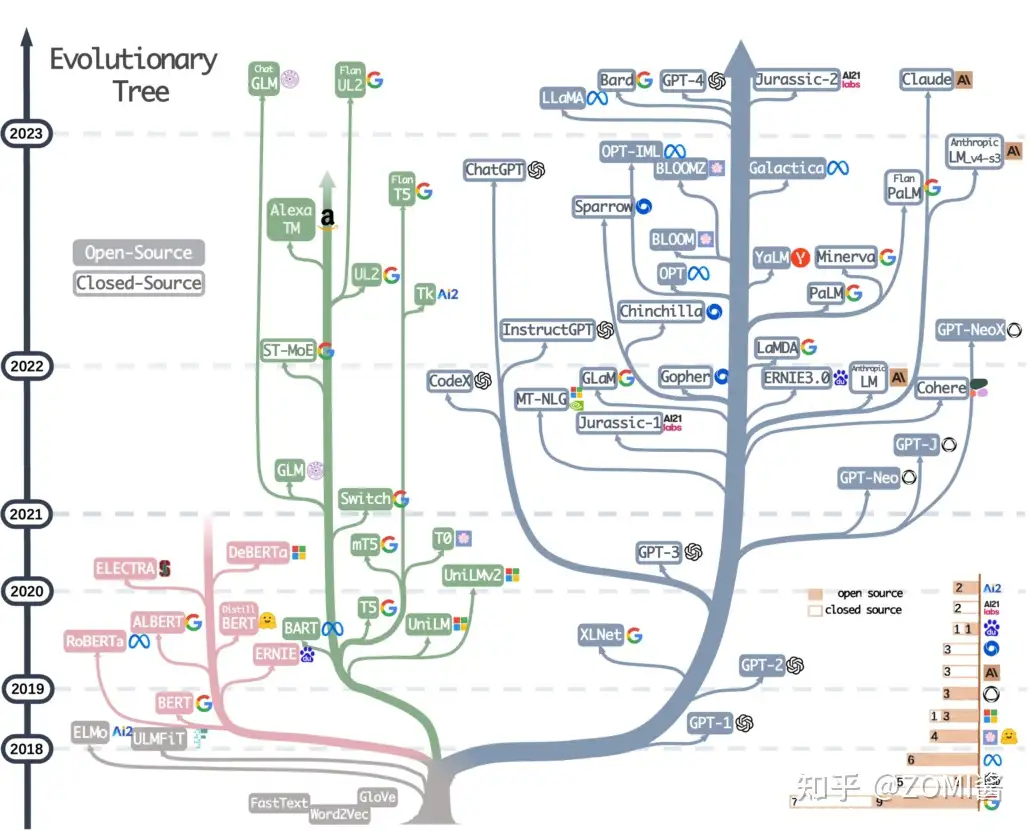

大模型进入了爆发期后,在 LLM 进化树中,BERT(Encoder-Only)、T5(Encoder-Decoder)、GPT(Decoder-Only)分别代表了不同的架构方向。那为什么在大模型时代,曾经风光无限的 BERT 家族 和 T5 家族会逐渐没落了?

从纯算法模型结构上,Google 的 T5 是比 GPT 更加优雅的神经网络模型结构, 但是由于 T5 的模型结构不是线性的,因为在 Decoder 和 Encoder 之间有复杂的连接关系(即对应的 Cross Attention 或者叫做 Cross Condition),导致 T5 在真正大规模堆叠的时候,实际上在工程领域,很难通过分布式并行高效的执行起来。因此,在目前已知的分布式并行优化上,T5 很难通过规模化扩展模型的规模,Scale 到千亿参数以上。

针对直接基于 Decoder-Only 实现的 GPT 模型,在工程领域实现分布式并行优化,会比 T5、BERT 等网络模型更加容易实现。或许不同的算法结构对于网络模型的具体效果上互有高低,但是在模型规模继续 Scale up 的大模型时代,工程上更容易实现分布式并行、更容易扩展、训练 Token 效率更高的模型,一定是更具备优势的,这就是AI 系统反过来影响算法发展,对算子作出的一种选择作用。

因此,我们正在迈进 AI 系统开始影响和决定大模型的发展方向的时代。也是称为计算机 AI 系统相关的工程人员最好的时代,我们可以切身地接触在之前难以想象的集群规模尺度上解决复杂的、最前沿的工程问题,且能为不同的网络模型算法,带来巨大的经济成本和时间成本收益。

目前预训练大模型成本居高( GPT-4 训练一次的成本超过 5000W 美金),再往上翻倍探索下一个 FLOPs 数量级也变得十分困难。因此百亿级别和千亿级别的 MoE 架构开始慢慢成为了大模型时代考虑的下一个主流方向,即如何用更低的成本,更快地训练更大的模型。这将是未来 AI 革命中的主流主题。

客观地预测,未来大模型算法研究也必然朝着 AI 系统的方向去探索:稀疏化(Sparse)将会是今明几年内,学术界和工业界主战场,训练速度每提升 5%,都将节省上千万人民币的训练成本,并在大模型竞赛中占据优势地位。

即使是稠密的大模型,也在探索诸如 GQA(Grouped Query Attention)等算法结构上的优化,推理阶段考虑如何使用 MHA 通过离线的方式转换成为 GQA,减少推理的计算量。这些算法优化并不是为了提升模型的使用效果,而是希望成倍的节省推理阶段 Inference 时的 KVCache 显存和计算峰值 Flops,从而使大模型可以在保存低时延下实现更高的吞吐性能。

因此,如果你是一个想在大模型时代有所建树的算法研究员,不懂 AI 系统将会是非常吃亏的事情。如果你来设计一个新的大模型算法, 一定需要在设计阶段就要考虑如下问题:

- - 新设计的网络模型结构算法是否更容易进行分布式并行计算?

- - 新设计的网络模型结构算法需要多久的时间才能训练出更好的效果?

- - 新设计的网络模型结构算法如何实现超长的记忆能力(长上下文 Sequence Length?

- - 新设计的网络模型结构算法如何训练和如何推理?

因此,如果你是一个想在大模型时代有所建树的系统研究员,不同 AI 系统将会是非常吃亏的事情。如果你来设计一个系统,满足未来的算法技术发展趋势,一定要在设计阶段开始就要考虑如下问题:

- - 网络模型结构算法如何实现各种并行时所需的通信量更低?

- - 网络模型结构算法如何优化实现更少计算量、 更少的显存需求、 更容易进行推理?

- - 如何设计编译器使得网络模型计算自动优化、实现通信量、计算量、显存占用更少?

- - 如何设计编译器使得网络模型结构算法能够适配到不同的AI 加速器上执行计算?

- - 如何设计 AI 计算集群的网络拓扑,减少网络拥塞,降低网络传输耗时,提升线性度?

换言之,在大模型时代,如果提出新的网络模型算法结构可能有 5% 的效果提升,但是引入了额外 50% 的训练成本,那这个新的网络模型算法一定是一个负优化算法,而且不一定能够实现出来,还要支撑各种消融试验和对比实验。50% 的训练成本,基于 Scaling Laws 可以在原模型上多增加 50% 的上下文长度,或者网络模型的规模Scale up 增大一半,可能带来的最终效果提升,远大于新设计出来的网络模型结构算法所提升的 5%。

AI系统对于新算法研究的重要性日益凸显,如今已不仅仅是算法研究的辅助工具,而是成为了其不可或缺的一部分。随着AI系统的不断发展和进步,其在大模型研究中的影响力也愈发显著。可以说,AI系统已经成为了大模型研究中不可或缺的重要力量。因此,对于AI系统的深入研究和应用,对于推动大模型研究的进步和发展具有十分重要的意义。

参考:

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。