UADA3D 突破激光雷达难题 | 引领无监督域自适应新趋势,助力点云三维目标检测突破!

UADA3D 突破激光雷达难题 | 引领无监督域自适应新趋势,助力点云三维目标检测突破!

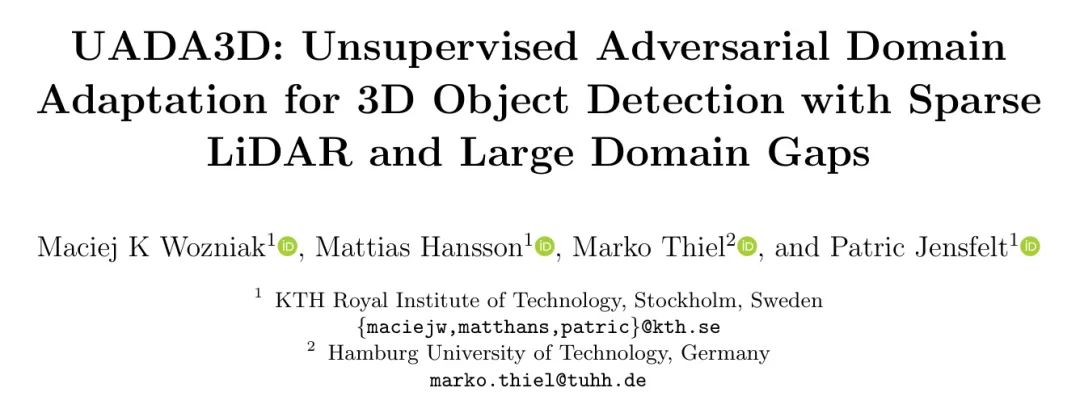

在这项研究中,作者针对基于激光雷达(LiDAR)的三维目标检测中现有无监督域自适应方法的一个空白进行了研究。这些方法主要集中在对成熟、高密度自动驾驶数据集之间的自适应。 作者关注更稀疏的点云,捕捉不同视角下的场景:不仅包括道路上车辆的视角,还包括人行道上移动机器人的视角,这些机器人会遇到截然不同的环境条件和传感器配置。 作者引入了用于三维目标检测的无监督对抗域自适应方法(UADA3D)。UADA3D不依赖于预训练的源模型或教师-学生架构。相反,它采用对抗性方法直接学习域不变特征。 作者在各种自适应场景中展示了其有效性,在自动驾驶汽车和移动机器人领域都取得了显著的改进。

1 Introduction

基于LiDAR的感知系统对于自动驾驶汽车[20]或移动机器人[41]的安全导航至关重要。一个关键挑战是在车辆环境中对物体进行可靠检测和分类[54]。最先进的(SOTA)三维目标检测方法在很大程度上依赖于用于训练的数据集的质量和多样性,同时也取决于这些数据集在推理过程中如何真实地反映现实世界条件。获取和标注此类数据仍然是一项重大的技术和实践挑战,既耗时又劳动密集。这在三维目标检测模型的大规模开发和部署中构成了一个主要障碍。

一个关键的减轻这些挑战的技术是领域自适应(DA)。DA解决了将训练于具有丰富标注数据源域的模型适配到目标域的问题,在目标域中,标注可能稀少(如在半监督DA中)或者完全不可用(如在无监督DA - UDA中)[8, 3, 36, 44]。UDA方法可以在无需标注新训练样本的情况下,显著提升模型在新环境、不熟悉环境或变化环境中的性能。在自动驾驶车辆的背景下,源域与目标域之间的不一致性,通常被称为领域偏移或领域差距,可能是由于天气条件的变化[22],物体大小的差异[48],不同的传感器设置和部署环境[54; 32; 30],以及从模拟环境过渡到真实世界环境[5]所引起的。

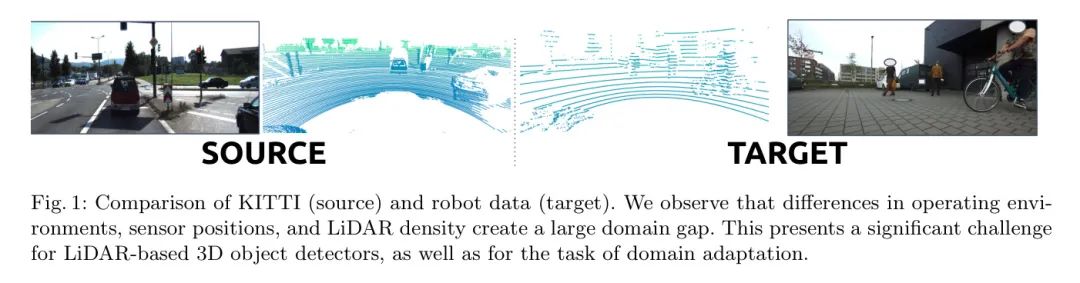

无监督域适应(UDA)在计算机视觉领域受到了相当多的关注。然而,近期针对基于激光雷达(LiDAR)的三维目标检测的UDA方法[29; 12; 48; 42; 4; 24]主要关注于汽车应用及相应密集激光雷达数据的 数据集,这些数据集具有128、64或32层[9; 39; 2; 52]。作者发现,在针对三维目标检测模型的UDA研究中,存在着一个值得注意的研究空白,那就是专门解决比与经典自动驾驶汽车相关的大域偏移的问题,例如最后一英里配送移动机器人。这些机器人在与自动驾驶汽车共享许多特性的环境中运行,理论上可以得益于广泛可用的数据集,但它们显示出显著的差异:激光雷达传感器的位置和分辨率不同,导致在地面平面更接近传感器的地方形成更稀疏的点云。此外,人行道环境与道路环境也有很大的不同。虽然存在相同的目标类别,但它们相对于传感器的分布和相对距离与从汽车视角看明显不同,导致每个目标的点密度不同,如图1所示,并在第4节进一步讨论。

在这项研究中,作者解决了在涉及稀疏激光雷达和大范围领域偏移的场景下的无监督领域适应(UDA)问题:1) 在广泛使用的汽车数据集之间,2) 对于仿真到现实的任务,以及3) 对于在使用16层激光雷达传感器的最后一英里配送机器人在人行道和室内操作时遇到的大范围领域偏移。

受到基于2D图像的对抗性域适应(DA)[8; 3; 65]的启发,作者提出了一种针对3D点云数据的新方法:三维目标检测的无监督对抗域适应(UADA3D)。作者的方法采用了基于类别的域判别器与梯度反转层(GRL)的对抗性适应,以促进学习域不变表示。域判别器被训练以最大化其区分目标域与源域的能力,而模型则被训练以最小化这种能力,从而实现域不变特征学习。

作者提出的这种方法在基于激光雷达的3D目标检测方面,相比于现有的无监督域适应(UDA)方法具有显著优势:UADA3D不需要预训练的源模型,避免了师生架构的复杂性,以及消除了伪标签固有的不确定性。相反,它直接学习在源域和目标域之间不变的特征。此外,作者的方法能够同时成功适应多个目标类别(例如车辆、行人和骑行者类别),这是其他最先进(SOTA)方法并不经常能够实现的。重要的是,这种方法特别适用于具有较大领域偏移的应用,如多个目标类别、不同的操作环境和稀疏的激光雷达数据。

作者的主要贡献如下:(i) 作者强调了现有无监督域自适应(UDA)方法在考虑远超出与传统自动驾驶汽车应用相关的典型域变化之外的重大域变化时的局限性(第2节);(ii) 作者介绍了UADA3D,一种基于3D LiDAR的无监督对抗域自适应方法,用于目标检测(第3节);(iii) 作者用两种广泛使用的目标检测模型测试了UADA3D,并在各种具有挑战性的无监督域自适应场景中实现了最先进(SOTA)的性能(第4节和第5节)。

2 Related Work

基于LiDAR的三维目标检测: 三维目标检测领域在这些年已经取得了显著的进展,近年来提出了基于图像[16, 47]、点云[37, 60, 61, 10, 66, 57, 67]和多模态融合[31, 1, 25, 28]的方法。PointNet [33]提出了一种从点集提取特征的输入不变方法。Voxelnet [67]和PointPillars [20]分别提出将点云分割成3D Voxel 网格和柱状结构。最近开发的Centerpoint [63]将 Voxel 或柱状 Backbone 网络与基于中心的检测Head相结合。IA-SSD [66]提出了一种单阶段的基于点的3D检测器,其性能与其他更慢的方法相当。

基于LiDAR的三维目标检测的无监督域自适应:众多研究项目专注于在自动驾驶场景中,适配128层到32层高分辨率LiDAR数据集之间的3D目标检测模型[48, 56, 58, 59, 35, 43, 50, 32, 19, 42, 24, 64, 15]。然而,对于将这些模型适配到更稀疏的LiDAR设置,如在小型机器人平台上常见的情形[38],却鲜少有人关注。特别值得一提的是,Peng等人[32]和王等人[49]专门研究了在64层和32层LiDAR之间的模型适配,以及反向适配。他们的结果显示,当将训练在64层LiDAR数据上的模型适配到更稀疏的32层目标域时,性能会急剧下降。在ST3D++[59]中也观察到了类似的模式,它利用伪标签为目标域生成标签。MS3D++ [42]利用多个预训练检测器以获得更准确的预测,但同样没有关注非常稀疏的数据。此外,程等人[4]展示了非常少的UDA方法能够在不同的目标类别上保持一致的绩效,而大多数方法只在Car/Vehicle类别之间进行适配,然而,他们并没有关注稀疏LiDAR或不同的操作环境。

近期的工作,如DTS [14],采用了具有特征 Level 图匹配的学生-教师架构,显示出在使用16层激光雷达时性能下降,尽管他们没有报告定量结果。激光雷达蒸馏(L.D.)[51]专门关注通过使用回归损失来最小化学生网络和教师网络预测的鸟瞰图(BEV)特征图之间的差异,以此适应模型到更稀疏的领域。然而,他们的评估仅针对自动驾驶数据集进行。虽然他们广泛讨论了使用人工下采样的16层激光雷达数据,但他们没有考虑到诸如激光雷达传感器位置(例如,大的高度偏移)、差异显著的领域(例如,人行道与街道)、以及多类别等因素。

上述讨论的大部分方法依赖于一种师生学习方法,这意味着它们需要在一个源领域上预训练的模型来将知识从教师传递给学生,以及/或者生成伪标签。相比之下,作者的方法采用了一种对抗性学习方法。因此,作者不需要一个预训练的教师模型来生成例如伪标签,这些伪标签不一定是 GT 的高质量替代品,甚至可能导致模型性能下降,正如作者在第5节后面所展示的那样。

对抗性领域适应(Adversarial Domain Adaptation):对抗性领域适应(ADA)依赖于一种判别性网络结构,该结构利用领域判别器来实现领域不变性[13; 23; 27; 65; 45]。梯度反转层(GRL)[8]反转了特征提取器和判别器之间的梯度。这种端到端的训练同时使用源领域和目标领域数据,跨领域对齐特征同时最小化源数据的检测损失。在此之后,Chen等人[3]引入了一种两阶段适应方法,结合了图像级和实例级的适应。Saito等人[34]提出了强适应和弱适应,强调局部目标特征的对齐。He和Zhang[11]在不同卷积层上使用多个GRL进行全局适应。Xu等人[55]在图像级和实例级领域分类之间引入了类别正则化,使用基于欧氏距离的正则化损失。Li等人[22]引入了AdvGRL,用自适应的

替换了常数超参数

,以解决具有挑战性的训练样本。ADA在图像空间的目标检测、分类或分割中找到了许多应用[3; 8; 65; 46; 27; 17]。

在作者的工作中,作者专注于基于激光雷达(LiDAR)的三维目标检测中的对抗性领域适应,这与二维方法有所不同。作者的方法通过数据增强和方法设计,解决了由不同点云密度和操作环境引起的空间数据处理独特挑战。作者特别通过使用由三维边界框 Mask 的特征的判别器来处理这一问题。从稀疏、不规则间隔的点云中提取这些特征,比从像素网格中提取要困难得多。这通常需要过渡到如图3所示的水平俯视图(Bird-Eye-View, BEV)特征空间。此外,处理点云意味着需要基于部分缺失、遮挡或不完整的数据进行预测(正如作者可以在补充材料的定性结果中观察到的),这是由低角分辨率引起的,可能导致即使距离物体很近,每个物体的点数也较少。在分割领域的无监督域适应(UDA)中,现有方法采用了边缘对齐的对抗性方法或非对抗性方法[62; 46; 17; 26; 7]。作者的方法利用条件对齐,作者发现这为基于激光雷达的三维目标检测带来了更优的性能(参见第5.1节进行比较)。

3 Method

Problem Formulation

假设

是一个点云,而

是通过特征提取网络

学习到的其特征表示。检测Head

使用这些特征来预测

,其中

是类别标签

和边界框

。

从源域

和目标域

中采样。目标是学习在域之间泛化的

和

,使得

。由于

,基于LiDAR的目标检测器的域适应任务是对齐边际概率分布

和

以及条件概率分布

和

。注意,在训练期间无法获得目标标签

,因此作者必须使用无监督域适应。

Method Overview

边缘适应,即对齐

,忽略了类别和位置标签,这可能导致不均匀和有偏见的适应。这可能降低目标域的判别能力。对齐

直接强调与特征相关的特定任务结果(类别标签和边界框)。通过关注

,作者假设适应过程也变得更加鲁棒,能够应对跨域特征分布的变化,专注于检测物体的关键任务。此外,在图4中,作者显示了由于激光雷达密度、位置和作业环境的不同,各个目标类别内点的分布在不同数据集之间存在显著差异,而车辆大小则略有不同,这取决于数据集的原产国(见图4(a)至4(c))。虽然作者选择使用条件对齐,但在第5.1节中,作者将作者的方法与不同的对齐策略进行了比较:边缘对齐和联合分布对齐。

图2提供了作者方法UADA3D的示意图。在每次迭代中,从源域

和目标域

中各提取一批样本

输入到特征提取器

。接下来,对每个样本提取特征,并将其输入到检测Head中,预测3D边界框(算法1中的第3-4行)。仅对源域中的标记样本计算目标检测损失(在补充材料中描述,算法1中的第6-7行)。概率分布对齐分支使用域判别器

(第9行)根据提取的特征

和预测的标签

来预测样本来自哪个域。对所有样本计算域损失

(第9行)。接下来,

通过判别器反向传播(第10行),并通过梯度反转层(GRL)用系数

在反向传播期间反转梯度,传播到检测Head和特征提取器(第11-12行)。这种对抗性训练方案旨在创建域不变特征。因此,作者的网络学习如何提取域不变特征,同时如何提供准确的预测。因此,作者寻求最佳的参数

,

, 和

,满足:

其中

是仅在标记源域上计算的检测损失(在附录材料中描述),

是为源域和目标域都计算的域损失。

是梯度反转层(GRL)的系数,关于其讨论将在第5.1节中进一步展开。

Feature Masking

_特征 Mask _ 在基于特定目标特征预测领域中起着至关重要的作用。 Mask 使模型能够专注于对应于每个实例的特征,从而提高领域预测的相关性和准确性。在图3中,作者展示了如何从点云

提取的特征被 Mask 并用于领域预测。类别的领域判别器

的输入是

,其中

是被 Mask 的特征,

是预测的边界框,

表示 ConCat 。为了获得被 Mask 的特征

,作者用每个预测的边界框

Mask 特征图

,生成相应的被 Mask 特征

。最后,作者将

与边界框

ConCat ,并送入相应的类别判别器

。

Conditional Distribution Alignment

图2和图3中显示的条件分布对齐模块的任务是减小源域的条件分布

与目标域的

之间的差异。正如作者在第3.2节中强调的,在图4中展示并在第4.1节中进一步讨论,作者可以看到不同类别目标在不同域中呈现出的较大差异。因此,作者没有使用一个判别器,而是使用了

个类别特定的域判别器

,对应于车辆、行人和骑行者类别。条件分布对齐模块通过最小二乘损失函数进行训练:

其中

是标签的数量,

对应实例

的类别置信度,而

表示逐元素相乘。损失会反向传播到判别器中(算法1第9行)。接下来,

通过梯度反转层(GRL)反向传播到检测Head

和特征提取器

。

Data Augmentation

激光雷达领域之间的差异包括不同的密度和物体大小。作者采用了下采样这种方法,这是一种常用的增强手段,因为通过将源数据的激光雷达层减少到16或32,可以在一定程度上弥补领域差距,以更好地匹配目标领域激光雷达数据,这一点在[53, 6]中有所强调。激光雷达-CS [6],Waymo [39],以及nuScenes [2]数据集包含的车辆大小与美国发现的大型车辆大小相对应,而作者的机器人和KITTI [9]是在欧洲收集的,那里的车辆普遍较小。在源领域应用随机目标缩放(ROS)[59]来解决这种车辆大小偏差。尽管之前基于激光雷达的3D目标检测的UDA方法通常只对单一目标类别应用领域适应,作者认为这是一个多类别问题。因此,作者为三个类别选择了不同缩放区间的ROS,具体描述在补充材料中。

4 Experiments Setup

作者比较了在大量UDA场景下,使用作者的方法UADA3D的IA-SSD [66]和Centerpoint [63]的性能,与其他SOTA无监督域适应方法(ST3D++ [59],DTS [14],L.D. [51],和MS3D++ [42])进行对比。在IA-SSD中,自适应判别器网络由全连接层组成,这些层在降采样点特征上操作。在Centerpoint中,判别器利用来自鸟瞰图(BEV)特征图的输入进行2D卷积。这两个网络最显著的区分是点基表示和视图表示,分别由多层感知机(MLPs)和2D卷积处理。这两种模型在域间进行适应的能力展示了作者解决方案的模块性和对不同方法的适应性。使用UADA3D,Centerpoint的训练周期为40,而IA-SSD为80周期,都采用一次循环的Adam [18]优化器,学习率分别为

和

。_GRL_系数被设置为固定值

。对于所有的SOTA方法,作者用40(Centerpoint)和80(IA-SSD)周期训练源域模型和最优模型,然后进行40周期的适应。有关源模型训练和超参数的详细信息将在补充材料中提供。

Datasets

作者使用了五个数据集:LiDAR-CS [6] 提供了多种LiDAR分辨率(作者使用了VLD-64 "CS64",VLD-32 "CS32" 和 VLP-16 "CS16"),KITTI [9] "

"(使用了HDL-64E),Waymo [39] "W"(HDL-64E),nuScenes [2] "

"(VLD-32)以及最后一个里程配送机器人 "

"(使用了VLP-16)在欧洲不同地点收集的数据,具体描述在补充材料中。

首先,作者专注于自动驾驶数据集之间的UDA问题,从密集型到稀疏型激光雷达,因为这是其他SOTA方法表现最差的地方。尽管这些传感器操作方式相似,但由于点云密度以及激光雷达的方位角和俯仰角的差异,问题便产生了。其次,作者适应作者的机器人数据,这尤其具有挑战性,因为移动机器人上不同的激光雷达位置和密度,以及操作环境(人行道与街道)的差异。最后,作者比较了自动驾驶数据集之间从稀疏域到密集域的适应性能。

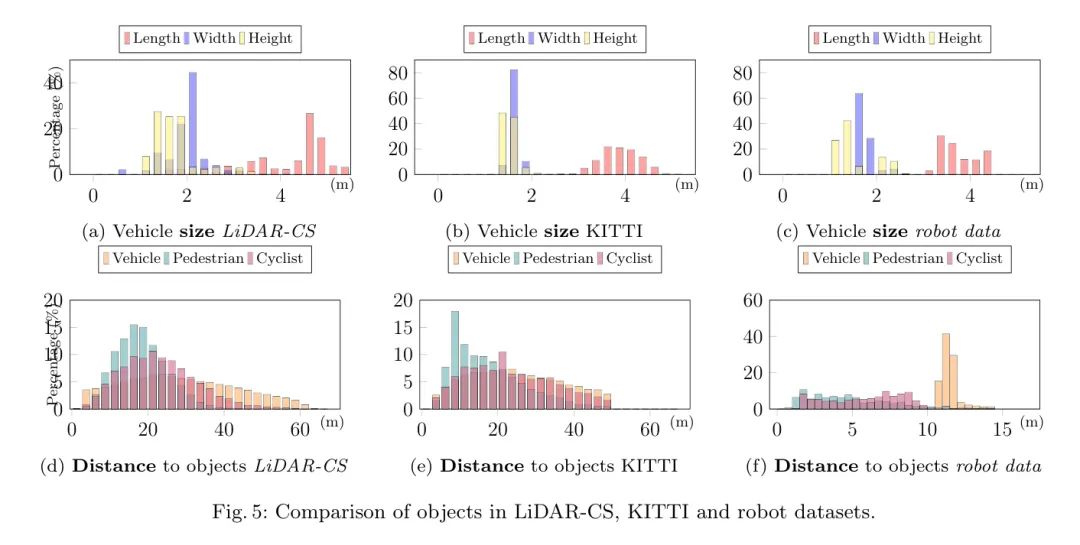

在图5中,作者可以看到自动驾驶数据集与机器人数据之间的差距有多大,尤其是在物体距离上(nuScenes和Waymo与LiDAR-CS和KITTI显示出类似的分布)。如图5f所示的在机器人数据中遇到的物体距离表明,该数据集只包含距离15m以内的物体,大多数行人和自行车距离小于10m,所有车辆在10-15m范围内,因为机器人是在人行道上行驶。相比之下,在自动驾驶汽车数据集的图5d和图5e中,很多物体距离在20-30m之间。因此,每个物体的平均点数(图4)在这些数据集之间存在很大差异。这导致这些领域之间的实例有显著不同。虽然不同的车辆大小通常在3D领域适应方法[59]中得到处理,但据作者所知,其他域自适应(UDA)研究之前尚未检查过每个物体的不同点数。

KITTI数据集的局限性在于其标签仅限于前摄像头视野(FOV)内,而其他数据集在360度FOV内都有标签。这给领域适应带来了重大挑战,通常导致研究者在适应KITTI数据集,而不是从它们适应,当这样做时,结果只带来性能的微小提升甚至降低[51]。

Evaluation metrics

作者报告了

和

,_差距缩小_ 以及

的变化。

是对三个类别:车辆、行人和骑车人的平均精度的平均值。_差距缩小_[61]计算为

,这表明作者与在目标域(oracle)上训练的模型的接近程度。

5 Results

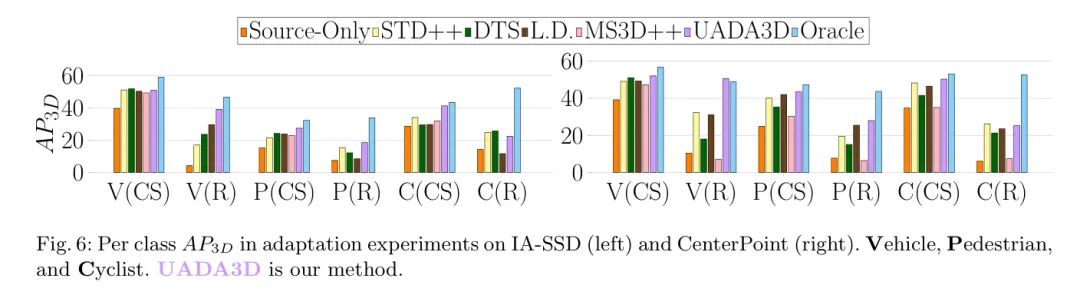

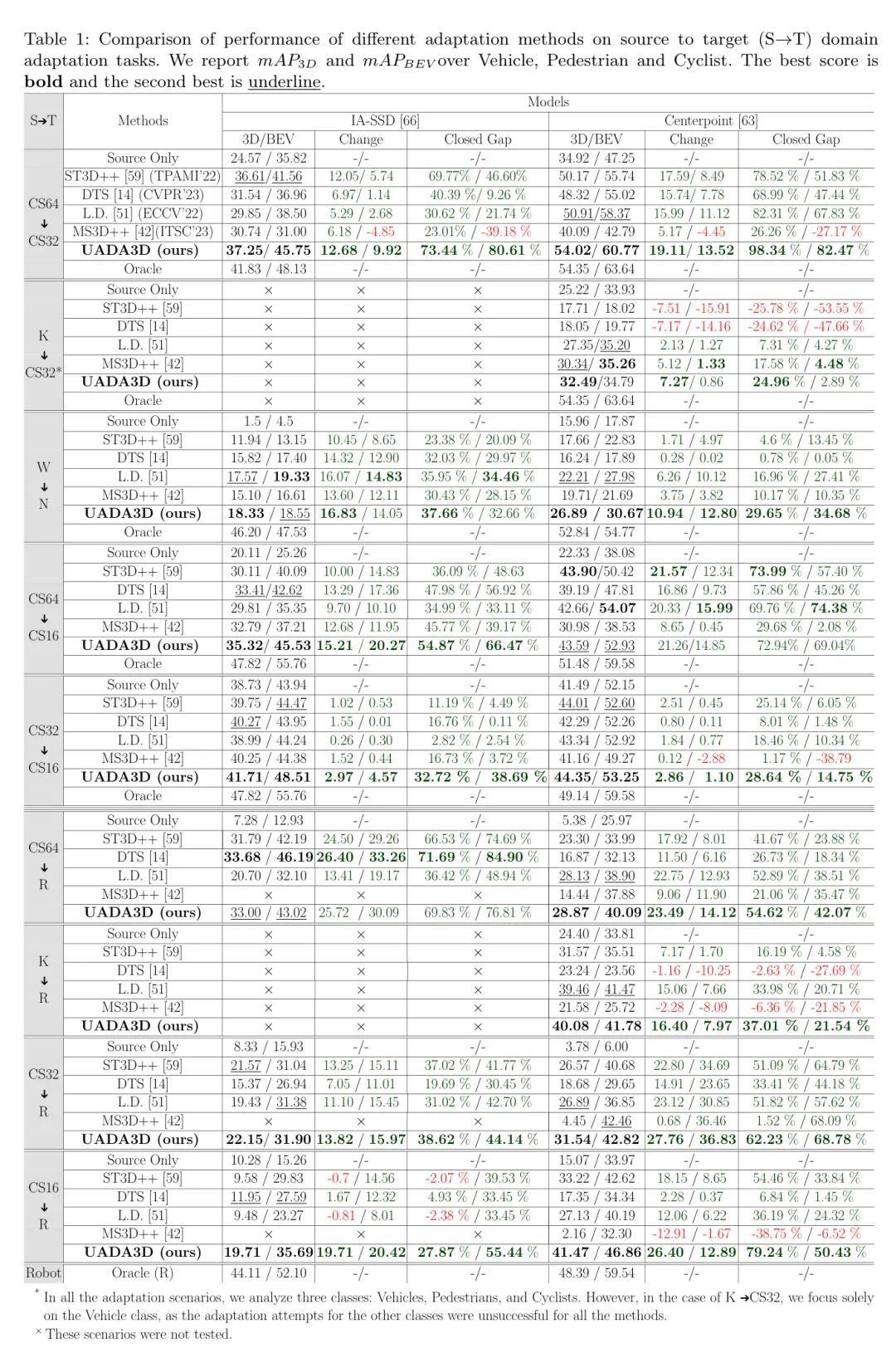

在表1和表2中,作者将在大量的源数据(S)与目标数据(T)之间的适应场景(进一步的测试包含在补充材料中)上,将作者的方法与现有技术水平(SOTA)进行比较。在表1中,作者重点关注两种模型:Centerpoint [63] 和 IA-SSD [66] 在9种不同的密集到稀疏场景下的表现。作者的方法 UADA3D 在大多数情况下都超过了其他SOTA方法,取得了更高的改进,尤其是在面临更大的领域差距时(例如将模型适应到移动机器人或W

N)。通过分析“变化”和“缩小差距”这两列,作者可以观察到,与IA-SSD相比,Centerpoint通常显示出更高的适应性,并且在

和

上有着实质性的更高提升。这可能是由于对于IA-SSD,作者必须固定特定数量的采样点(在补充材料中解释),这使得模型在适应不同的激光雷达密度和模式时灵活性降低。此外,尽管其他SOTA方法可能在个别类别(仅在向_R_适应时的骑车人)上胜过UADA3D,但在其他类别中表现较差(图6)。这表明UADA3D在不同检测器和类别之间提供了更好的泛化能力。

作者观察到,当在自动驾驶数据集(Waymo、KITTI、nuScenes)、模拟数据(LiDAR-CS)和机器人数据(R)之间进行适应时,作者的方法能有效处理多样的领域偏移。如第3节所述,UADA3D不需要像其他所有方法那样依赖预训练的教师模型。相反,作者可以直接训练领域适应的模型,利用生成域不变特征的GRL功能。这使得作者的方法能够在 未标注 的目标数据上成功训练高性能模型,而不依赖于伪标签。从表1中作者可以看到,在向更具挑战性的场景(例如 K

R)进行适应的测试中,一些方法的表现甚至比仅源数据方法还要糟糕,无法生成准确的伪标签或提炼教师知识。此外,值得注意的是,无论领域差距是大(例如,K

R, W

N)还是小(例如,CS32

CS16),在适应任务上,UADA3D的性能永远不会低于仅源数据模型。对于机器人环境适应的问题,许多方法的表现不如仅使用源数据,这表明适应机器人的环境具有独特的挑战。然而,尽管如此,在这些情况下闭合差距似乎比W

N或K

CS32之间的域差距更容易。这可能是由于前者的数据集范围和规模较大,以及KITTI的有限视场角在后者的原因。

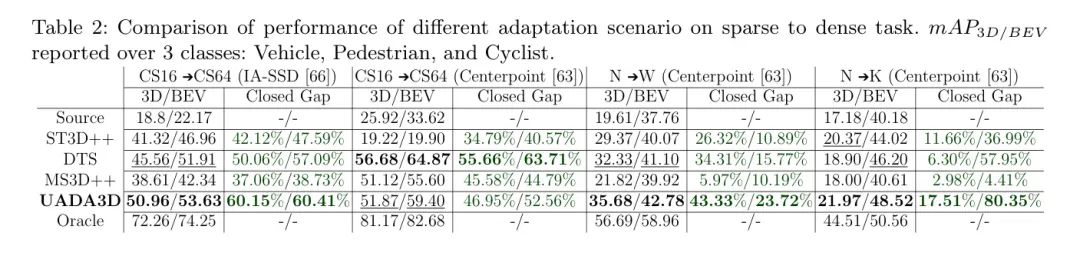

在表2中,作者比较了方法在从稀疏到密集情况下的性能。UADA3D在4个任务中的3个表现最佳,在一个任务中排名第二,这与从密集到稀疏的结果一致。所有方法在从稀疏到密集数据的适应上都表现出色,这表明目标数据与源数据相比,信息更为丰富。这支持了作者的假设,即从密集到稀疏的适应更具挑战性。作者的方法在两种情况下都表现出色:从稀疏到密集以及从密集到稀疏。而一些现有技术水平(SOTA)的方法,如L.D. [51],只允许从密集激光雷达(LiDAR)适应到稀疏,突显了作者方法的泛用性。

Ablation Studies

作者探讨了各种因素对作者方法性能的影响。首先,作者提出了哪种概率分布对齐对UADA3D最有利的问题。接下来,作者研究了判别器设计的影响,并分析了梯度反转层(GRL)的参数。最后,作者整合了其他自学习组件以进一步强化作者的方法。更多的细节,包括消融研究和超参数研究,可以在附录材料中找到。

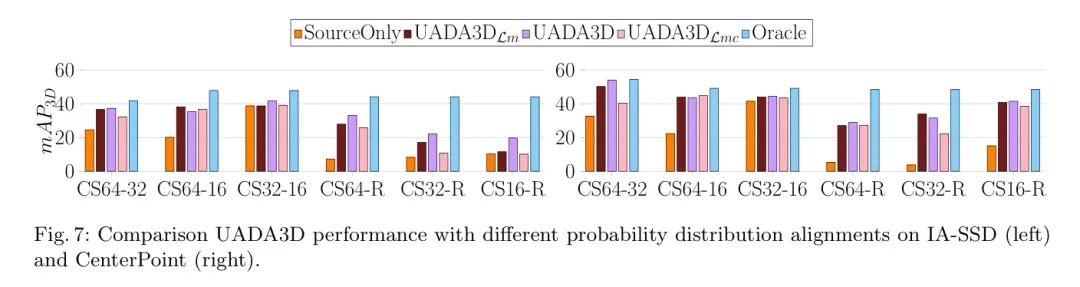

概率分布对齐: 在这些消融研究中,作者探讨了其他概率分布对齐策略的有效性,如图7所示。在采用边缘分布对齐的UADA3D(即UADA3D

)中,鉴别器的梯度只回传到具有损失

的特征提取器上,其中

,这里

对于源域是0,对于目标域是1,

表示边缘鉴别器网络。在UADA3D(即UADA3D

)中,鉴别器的梯度通过整个模型回传到检测Head上。UADA3D

结合了边缘对齐和条件对齐,

,其中

在方程(2)中给出。UADA3D

直接使用特征图来预测域并计算损失,而UADA3D使用带有类别标签和边界框的 Mask 特征。条件概率分布对齐一致地产生高质量的结果,但在某些情况下它并不是最佳选择。由于边缘概率分布

存在显著差异,特别是在自动驾驶汽车的跨传感器适配中,UADA3D

提供了可比较的结果。虽然UADA3D

和UADA3D

有时优于UADA3D,但在某些场景下,例如IA-SSD适配到

时,它们的表现就不尽如人意。因此,作者选择条件对齐作为作者首选的方法。

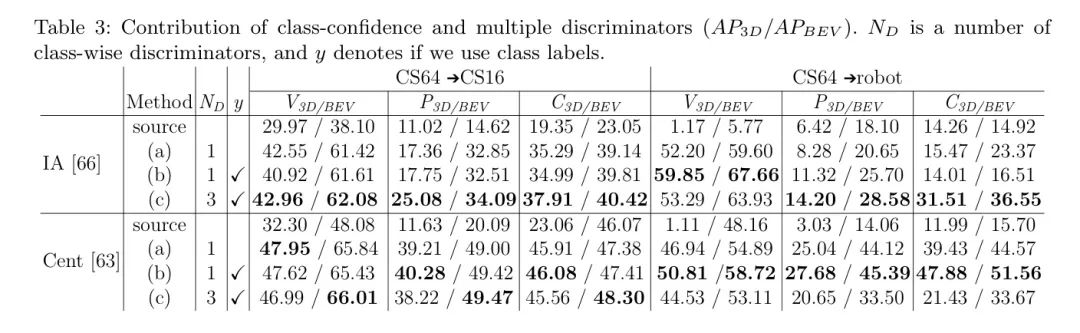

判别器设计:在表3中,作者探讨了不同的判别器设计:(a) 单领域判别器,输入为

,不包含任何标签信息;(b) 单领域判别器,其输出与最大预测类别置信度

相乘;以及(c) 默认的UADA3D设置,包含三个领域判别器。(a)和(b)在某些情况下获得了更高的适应得分,特别是在Centerpoint CS64

R上,但在IA-SSD上却比(c)差。当比较(a)和(b)时,作者可以看到乘以

(b)的影响相当大。Centerpoint在使用一个判别器时比IA-SSD获得了更好的性能,这很可能是由于BEV特征相比于点特征的更容易转移性。这也体现在IA-SSD的

得分上,对于情况(a)和(b),

的提高比

更多。由于模型复杂度更高,IA-SSD似乎从使用多个类别条件判别器(c)中获得了最大的优势。虽然IA-SSD在(c)设置下表现最好,而Centerpoint在(b)设置下表现最好,为了保持一致性,作者选择选项(c)作为作者方法的默认选项。

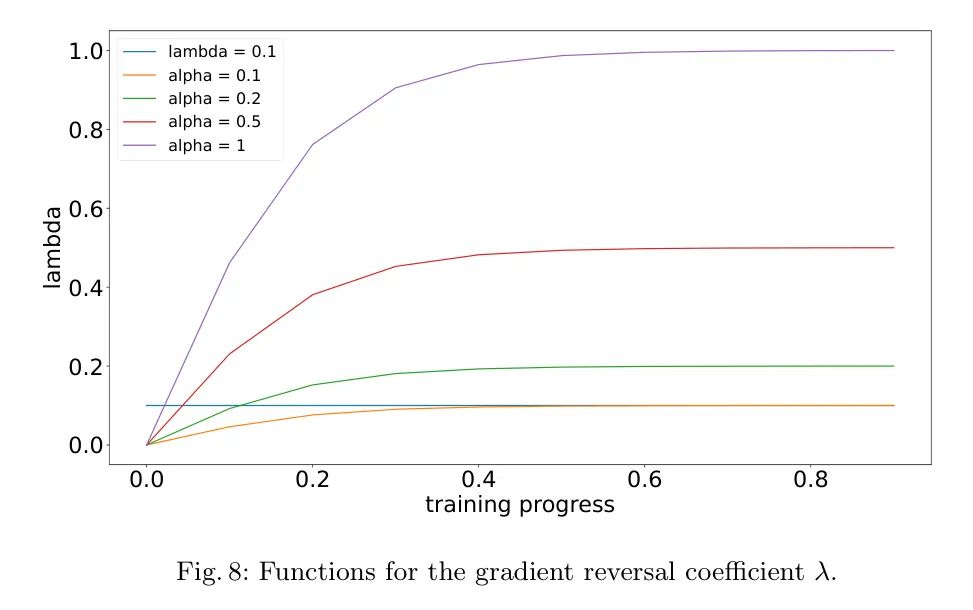

梯度反转系数: 作者在UADA3D和UADA3D

上测试了两种不同的_GRL_-系数

策略。首先,作者测试了一个常数

,这遵循了大多数在2D目标检测中对抗性UDA策略的设置[3, 34]。其次,作者遵循其他方法[8, 22],其中

随训练的增加而增加,根据以下公式:

,其中

是决定最终

的缩放因子,

,

是从开始0到结束1的训练进度。测试了

值为1、0.5、0.2、0.1。这种方式下,在前几次迭代中梯度反转较低,并逐渐接近

。鉴于作者没有使用预训练模型,这种方法使得在训练初期,方法能够集中在目标检测任务上,因为判别器损失最初会显著较小。在表5中,作者可以观察到较小的

值会带来更好的适应性能。对于车辆和骑车人的最佳得分是在常数

下取得的,而动态

在

下分别为行人取得了最佳得分。两种

和

在所有三个类别中都获得了较好的平均分数,差异最小。然而,作者选择在实验中使用常数

,因为它表现出略好的性能并降低了复杂性。

集成附加的自学习组件:作者想要了解其他自学习组件如何能进一步改进UADA3D。作者将UADA3D(U)与预训练的源模型(PM)、伪标签(PSL)[59]、模型集成(ME)[42]以及BEV空间中的模拟区域(MK)[51]相结合。在表5中,作者展示了在W

N任务上对Centerpoint [63]进行适应的结果。作者可以看到,作者的方法可以从附加的自学习组件中进一步受益,并进一步缩小领域差距。作者可以看出,PSL对作者的方法改进最大,但仅使用PM可能会略微降低UADA3D的性能。为了添加这些方法,作者需要预训练的源模型,而UADA3D并不需要这些模型。因此,作者将在未来的工作中考虑添加这些功能,而无需预训练模型。

6 Conclusions and Limitations

在本文中,作者介绍了UADA3D,这是一种针对具有挑战性的无监督域自适应(UDA)场景的新方法,特别关注于稀疏的激光雷达数据和移动机器人。通过使用梯度反转的对抗性训练,UADA3D有效地导航各种环境,确保精确的目标检测,并在各种域自适应场景中取得最先进的表现。这种方式还可以将自动驾驶领域的大量现有数据集用于移动机器人。然而,领域之间的差距依然存在,特别是在如W(Waymo)

N(nuScenes)或K(KITTI)

R(obot)这样的场景中,改进受到限制。未来的工作可以探索在多模态场景之间进行适应,例如相机和激光雷达,雷达和激光雷达,或增加更多的自训练组件。

Appendix 0.A Experimental setup

作者在两台配备了Intel Core i7-12700KF(12核心,20线程)5.00 GHz CPU 和 NVIDIA GeForce RTX 3090(24 GB)GPU的台式电脑上进行了实验。作者使用了批大小为8。对于UADA3D,这导致了源数据中的4个标记帧和目标数据中的4个 未标注 帧。在作者的实现中,作者使用了OpenPCDet库[40]。作者的代码将很快公开可用。尽管很难准确估计包括超参数搜索、消融研究等在内的这个项目花费了多少GPU小时,但作者可以估计获得主要结果(主论文中的表1)所需的小时数。请注意,一个IA-SSD周期所需的时间少于一个Centerpoint周期,因为IA-SSD是一个更高效的检测器。

Appendix 0.B Implementation Details

Detailed implementation of UADA3D

条件模块的任务是减小源域的条件标签分布

与目标域的

之间的差异。标签空间

包括类别标签

和3D边界框

。特征空间

包括点特征

(IA-SSD)或2D BEV伪图像

(Centerpoint)。Centerpoint中的域判别器

采用2D卷积层,其尺寸为

,而IA-SSD使用维数为

的MLP。激活函数使用LeakyReLU,并在最后使用sigmoid层进行域预测。基于0.A中展示的实验,Centerpoint选择了3的核大小。注意,作者进行的是类别的域预测,因此作者有

个判别器,对应于类别数量(在作者的案例中

,但可以轻松修改)。

Detailed implementation of UADA3D

主要角色

与边缘特征判别器的作用是尽量减小源域的边缘特征分布

与目标域的边缘特征分布

之间的差异。在这里,

和

分别代表从两个不同域中由检测 Backbone 网络提取的特征。这种方法确保提取出域不变特征。

边缘对齐模块的损失函数是通过二进制交叉熵定义的。

IA-SSD [66] 中基于点的检测 Backbone 输出的结果是

个点特征,这些特征具有特征维度

及其对应的编码。可以采用点状判别器来识别这些点所来自的分布。所提出的边际判别器

的输入是通过集合抽象和下采样层获得的点状中心特征。判别器由5个全连接层(512,256,128,64,32,1)组成,这些层将特征维度从

降低到 1。激活层中使用 LeakyReLU,并使用最终的 sigmoid 层进行域预测。

Centerpoint [63]中的主干网络使用稀疏卷积提取基于 Voxel 的特征,并将其展平成2D鸟瞰图(BEV)特征。因此,基于视图的边缘判别器的输入由特征维度为

的伪图像给出,其空间维度为

和

,定义了2D BEV网格。由于在IA-SSD中,对高度下采样的点云进行2D卷积比MLP在计算上更为耗时,因此2D边缘判别器使用了一个3层CNN,将特征维度从

降低到1(256,256,128,1),使用的核大小为3,步长为1。与点对点情况相同,

的损失函数通过交叉熵定义。

Detectors' loss functions

作者的模型的损失定义为网络的损失

和判别器的损失。虽然在主论文中作者解释了判别器损失的工作原理,在本节中作者想要提供更多关于在作者测试的两个模型中使用的

的见解。作者遵循了Centerpoint [63] 和 IA-SSD [66] 的作者们提供的描述以及作者在实验中采用它们的源代码。更多详情,请参考原始论文。

Centerpoint [63]:在初始阶段,检测Head的主要功能是确定物体中心的基本特征。这个过程包括细化子 Voxel 位置

,测量物体距离地面的高度

,评估3D尺寸

,以及使用

计算偏航旋转角度。子 Voxel 细化

旨在减少由 Voxel 化和主干步幅引起的量化误差,而高度测量

确保了精确的3D定位并恢复在地图视图投影中省略的升高细节。偏航方向通过对其正弦和余弦成分的连续回归进行评估。与边界框尺寸一起,这些属性提供了一个全面的3D边界框轮廓。每个特征都通过其各自的处理头进行处理。在训练阶段,使用L1回归损失进行监督训练时,使用了 GT 中心,并且对尺寸进行对数回归以更好地适应不同的框形状。在推理期间,这些特征从每个目标的峰值位置的密集回归头输出中提取。

在第二阶段,预测了与类别无关的置信度得分和边界框的细化。作者使用由边界框与相应真实边界框的3D IoU引导的得分目标

:

在公式中,

是目标

的最终预测置信度,而

和

分别是目标

的第一阶段和第二阶段的置信度。

IA-SSD [66]: IA-SSD的总损失由以下给出:

中心点预测损失,用

表示,旨在准确估计朝向实例中心的偏移量

。此外,它还包括一个正则化组成部分,以减少预测中心点时的不确定性。这是通过考虑周围元素的整体影响,聚集每个实例的所有投票,并关注每个实例的平均目标位置

来实现的。因此,中心点预测损失的表达式如下:

表示从点

到中心点的真实偏移量。

是一个指示函数,用于确定这个点是否用于估计实例中心。

是用于预测实例中心的点的数量。

类感知损失函数,用

表示,定义如下:

在这里,

表示类别的数量,

代表一个独热标签,而

表示预测的逻辑值。这个公式是分类任务中使用的二元交叉熵损失函数的典型形式,其中每个类别都是独立评估的。

最终,使用加权的交叉熵损失来计算

:

在这里,软点 Mask

被应用于前景点的损失项中,有效地给予靠近中心的点更高的概率。值得注意的是,在推理过程中并不需要边界框。相反,作者在下采样后保留了得分最高的点,假设模型已经训练得很好。

Detectors' specific settings and ablation

作者对这两个检测器进行了不同的超参数研究,以便为作者所比较的方法训练最佳的仅源域和最优模型。

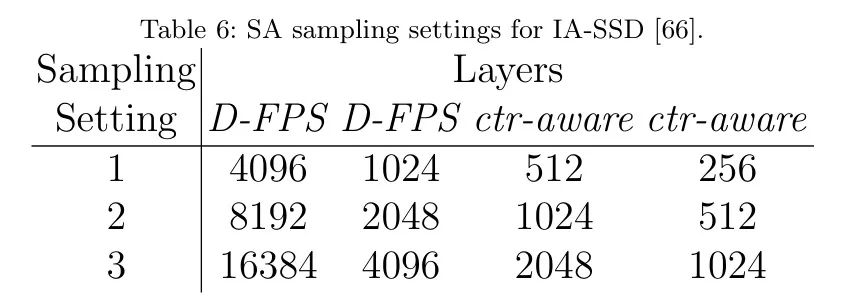

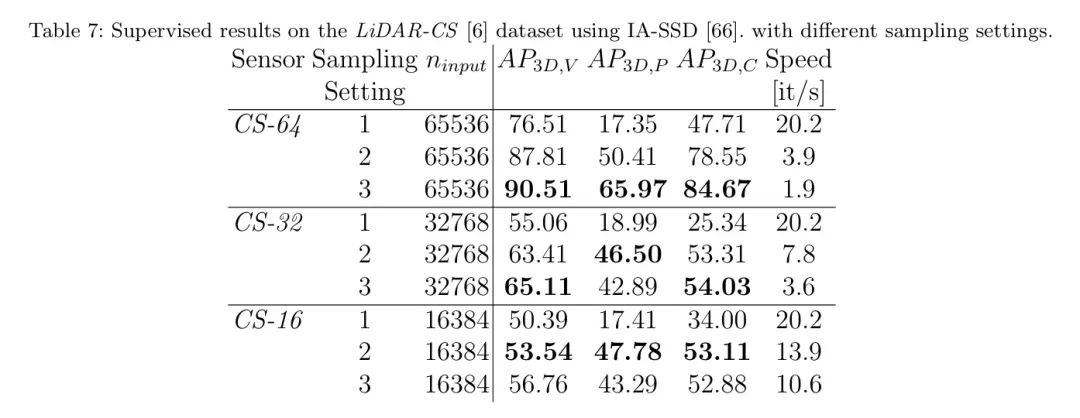

IA-SSD采样设置: 为了找到适合由64层、32层和16层激光雷达提供的数据密度的采样设置,对IA-SSD检测器的有监督训练进行了三种不同的采样设置测试。首先,作者为_KITTI_数据集提出的采样设置,其中点从4096逐渐下采样到256点。其次,从8192到512点的中间设置,也采用逐步下采样。最后,作者为_Waymo_[39]提出的设置,其中下采样从16384逐渐进行到1024点。带有中间采样层的三种测试设置在表6中展示。

IA-SSD [66]中四个采样层的点数是根据实验设置的(见表7)。作者为包括IA-SSD在内的所有运行选择了中间设置:8192、2048、1024和512。这是在检测准确性和速度之间作出的折中。输入点云在遵循作者在Waymo [39] 数据集上的实现后,使用随机采样方法下采样至65536点云密度,该数据集具有类似的点云密度,_CS-32_ 下采样至32768,而 CS-16 和 Robot 选择16384点。

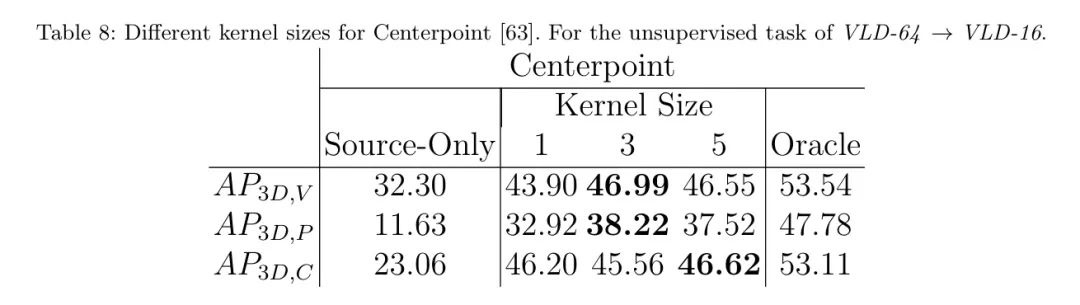

中心点核尺寸: 对于二维目标检测模型,通常使用核尺寸为3,但由于在执行适应性转换时,_BEV_特征与图像特征的问题不同,因此测试了不同的核尺寸。在Centerpoint [63]的判别器层中测试了1、3和5的核尺寸。结果见表8。

在表8中可以看出,使用5和3的核大小所获得的结果几乎相同。然而,更大的核大小会导致GPU使用率更高。在采用核大小为5的模型进行训练时,当批处理大小为8时,GPU使用率略低于所使用的GPU可用24 GB的内存。因此,选择核大小为3以避免内存过载。《Centerpoint》[63]的实现使用了标准 Voxel 大小,在

和

方向为0.1米,在

方向为0.15米。

Gradient Reversal Layer

在消融研究中,作者对UADA3D和UADA3D

上的_GRL_-系数

测试了两种不同的策略。首先,测试了一个固定的

,这遵循了在2D目标检测中大多数对抗性UDA策略所使用的设置[3, 34]。其次,作者遵循其他方法[8, 22],其中

根据以下方式在训练过程中增加:

其中

是一个决定最终

的缩放因子,

且

是从开始0到结束1的训练进度。测试了

值为

的情况。不同

值在训练过程中的

参数如图8所示。关于

对模型性能影响的数值结果在5.1节消融研究中提供。

Appendix 0.C LiDAR sensors details

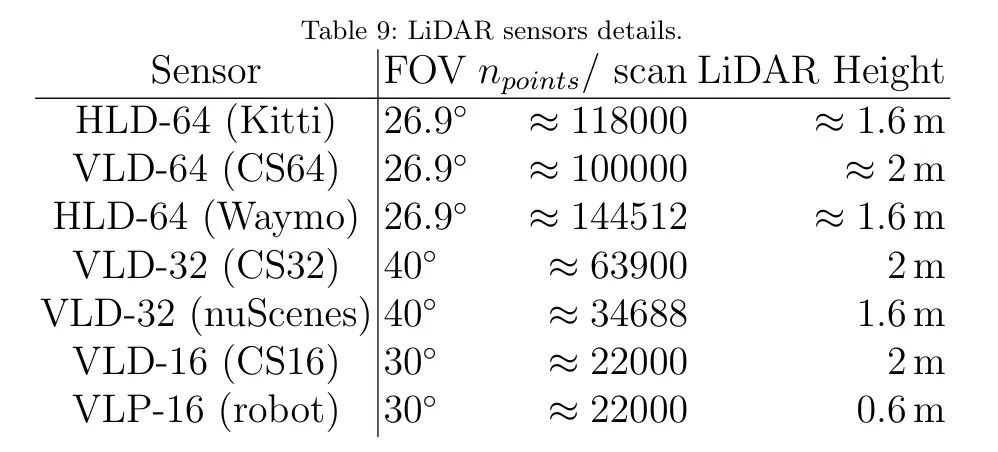

在表9中,作者比较了不同激光雷达(LiDARs)的特性,以及它们在不同数据集中的每次扫描的点数和地面以上的高度。作者所测试的各种场景清楚地显示了作者的方法以及不同无监督域适应(UDA)方法在面对稀疏数据和大域差距时的鲁棒性。全面的数据分析在主论文(第4节)中提供。

Appendix 0.D Data Augmentation

Height shift

正如第4.1节所强调的,不同数据集之间在激光雷达安装高度上有一个明显的区别。数据集中的激光雷达数据是以传感器安装位置为中心的,见表9。遵循之前在三维目标检测领域进行无监督域适应(UDA)的工作[58],所提出的方法与激光雷达高度偏移结合使用。

这种转换确保了源数据集和目标数据集的地平面处于相同的激光雷达高度

。在适应过程中同时使用这些平移后的数据集,并且任何测试或推理都是使用这些平移后的点云进行的。

Random Object Scaling

随机目标缩放(ROS)对 GT 边界框及其对应点应用随机的缩放因子。在 ego-车辆坐标系中的每个目标点

被转换到局部目标坐标系中。

在该文本中,

表示物体的中心坐标,而

是 ego 坐标与物体坐标之间的旋转矩阵。随后,每个物体点会被一个从均匀随机分布中抽取的随机缩放因子

进行缩放:

随后,每个物体被转换回 ego-vehicle 帧中。每个边界框的长度

、宽度

和高度

也相应地按照比例

进行缩放。

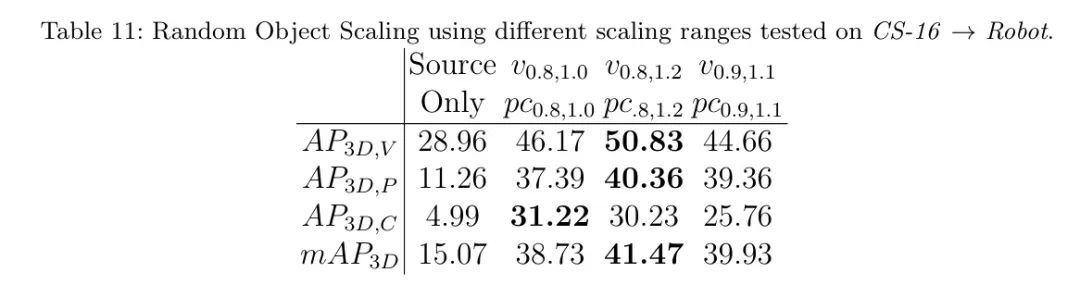

遵循先前的工作[48, 35, 58],实验中包含了源数据中的目标缩放,以考虑不同的车辆大小。正如第4.1节所检查的,LiDAR-CS中的车辆大小之间存在很大差异,这对应于通常在美国发现的大型车辆和机器人在欧洲遇到的小型车辆。具体来说,使用了ST3D[58]中的ROS,其中目标及其相应的边界框根据选定的缩放区间内的均匀噪声进行缩放。虽然在基于LiDAR的三维目标检测上的先前UDA方法通常仅将领域适应应用于单一目标类别,作者认为这是一个多类别问题。因此,表10中展示了ROS用于所有三个类别(车辆、行人和自行车手)的不同缩放区间。表11展示了不同缩放区间的结果。作者可以看到,对于车辆最佳的设置是

,对于行人和自行车手是

,因此,作者为所有实验选择了这个设置。

Additional augmentation details

除了上述所有增强方法外,所有方法都使用了不依赖真实边界框的标准激光雷达(_LiDAR_)增强技术进行训练。这些增强包括沿

和

方向随机进行世界翻转,围绕

轴在

范围内进行随机世界旋转,以及在

范围内进行随机世界缩放。

Appendix 0.E Loss analysis

作者网络的损失由两个部分组成:检测损失和判别器损失。当作者用

优化判别器时,作者通过梯度反转层将这个损失反向传播到网络的其他部分。因此,尽管判别器的目标是最小化

,但特征提取器和检测Head则从最大化

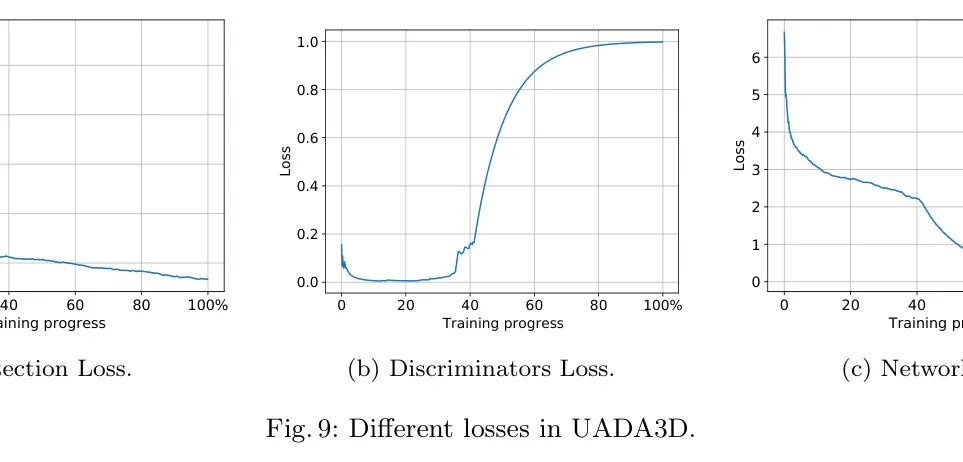

中受益。换句话说,网络旨在创建对于目标检测任务而言既领域不变又有效的特征。作者可以在图9中观察到这些损失。最初,作者可以看到随着损失降低并接近0,判别器能够区分不同领域。然而,在大约30%的训练后,网络开始产生更加不变的特征。在大约40%的训练后,网络已经学会生成不变特征,导致条件判别器损失迅速增加。这些特征对于检测仍然是有益的,使得检测损失降低,并且整体损失迅速减少,直到条件判别器损失再次达到平稳。

Appendix 0.F Additional experiments

Additional scenarios

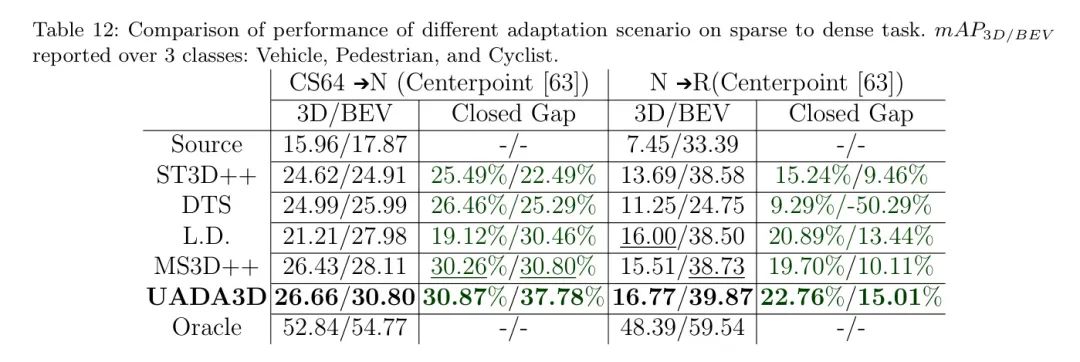

在表12中,作者展示了Centerpoint在CS64

N(从模拟到真实)和N

R(从自动驾驶数据到机器人)的适应性的额外比较,这些是作者在主论文中使用的主流方法。作者可以看到,在这种情境下,UADA3D再次取得了最佳表现。

Comparisons with other SOTA methods

为了节省篇幅,作者的论文集中讨论了四种最先进的无监督领域自适应(UDA)方法。具体而言,作者的关注点在于那些体现了原始和开创性方法(ST3D++),或者明确专注于并测试于非常稀疏数据(DTS和L.D.)的方法。由于MS3D++使用了检测器的集成,作者假设它可能在具有挑战性的场景中具有优势。MS3D++也是少数几种报告了在汽车和行人类别之间进行适应的方法之一。下面作者将展示与其他最先进方法的比较。作者重点关注Waymo、KITTI和nuScenes数据集,因为这些方法不支持适应自定义数据集。

ReDB:作者也与ReDB(ICCV '23)[4]进行了比较,这是少数几个像作者一样考虑适应3个类别的方法之一。作者可以看到,在W

N上,ReBD在车辆、行人和自行车上的

分别达到了32.12/28.56、22.54/19.11和31.19/26.32,而UADA3D在Centerpoint适应上的表现分别为37.84/32.55、23.49/21.23和30.68/26.80。作者可以看到,在自行车适应上作者的表现略逊一筹,但在其他所有类别和整体性能上作者都超过了ReDB。当比较N

K适应时,作者观察到了类似的行为,然而在这里区别在于车辆类别,ReDB在BEV指标上表现更好,但在AP3D上表现较差,其总体性能为46.17/20.27,而UADA3D在

上达到了48.52/21.97。因此,作者可以看出作者的方法在不同类别之间具有更好的泛化能力。

Bi3D: Bi3D (CVPR '23) [64] 是一种仅关注汽车类别的半监督学习方法。作者在W

N的转换中仍然比他们获得了更高的

。

适应:UADA3D 37.84/32.55 对比 Bi3D 35.29/30.81(使用1%的目标样本标签)。然而,在N

K上,UADA3D达到65.24/25.34,而Bi3D达到60.11/33.48,因此在

指标上比作者表现更好。但是,正如所怀疑的,如果作者将目标样本标签的百分比增加到5%,Bi3D进一步提高了其性能,因为作者的方法是完全无监督的(在训练过程中没有目标标签)。

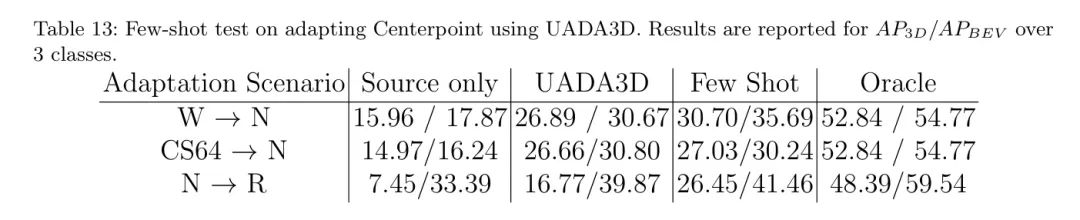

Few shot learning

受到其他研究的启发,作者尝试使用目标数据中的少量标签,以观察这是否能进一步改善作者的结果。在表13中,作者展示了三种情境下的结果。有趣的是,作者观察到一些改进,尤其是在向机器人数据的适应方面,其他数据集也有轻微的提升,尽管不如前者明显。这可能是因为机器人数据比nuScenes数据要小。值得注意的是,作者在行人和骑车人类别中观察到了特别高的改进。此外,作者发现添加W

N比CS64

N带来了更大的改进。值得注意的是,在使用这种少样本方法时,作者仅用20个标记的目标样例就实现了这些结果。

Appendix 0.G Mobile Robot

Robot Setup

所使用的捕获机器人数据的移动机器人是在汉堡工业大学开发的一款轮式最后一英里配送机器人(见图10)。它配备了英特尔 Core i7-7600U 2x2.80 GHz CPU 和具有64个张量核心的 NVIDIA Volta GPU。其传感器包括两个前后朝向的_Stereolabs ZED2_立体相机,四个向下方向的_英特尔 RealSense D435_立体相机以及一个16通道的_Velodyne Puck_(VLP-16)激光雷达。由于本研究关注基于激光雷达的检测,因此在本研究中仅使用激光雷达传感器进行检测。

Robot Data

训练数据是在校园及其周边地区收集的。在训练和测试期间,数据是从这两个地点随机抽取的。作者的数据集包括户外(大学的人行道、小型校园道路或停车场)和室内(大学建筑和仓库)场景的序列。在这些区域中,大多数目标类别是行人和骑自行车的人。还有许多车辆,大多数停在路边或在大学校园内穿行。由于数据是在类似于此类机器人预期使用场景中收集的,因此它可以被视为在实际操作中遇到数据的准确表示。数据使用开源标注软件SUSTechPoints [21]进行标记。在作者的训练/测试划分中,作者使用了与KITTI [9]数据上相似的扫描数量。作者使用了7000次扫描进行训练,3500次用于测试。

与本文一起,作者计划发布作者在场景中使用的机器人数据。完整的数据库是另一个项目的一部分,并将很快公布。除了本项目中使用的激光雷达数据和类别标签外,完整的数据集还将包括来自RGBD相机、朝地面的立体相机、惯性测量单元(IMU)、轮式里程计和RTK GNSS的数据。这一系列多样的传感器将提供一个全面的角度来观察机器人对其环境的感知,为机器人感知能力的细微方面提供宝贵的洞见。

Appendix 0.H Qualitative results

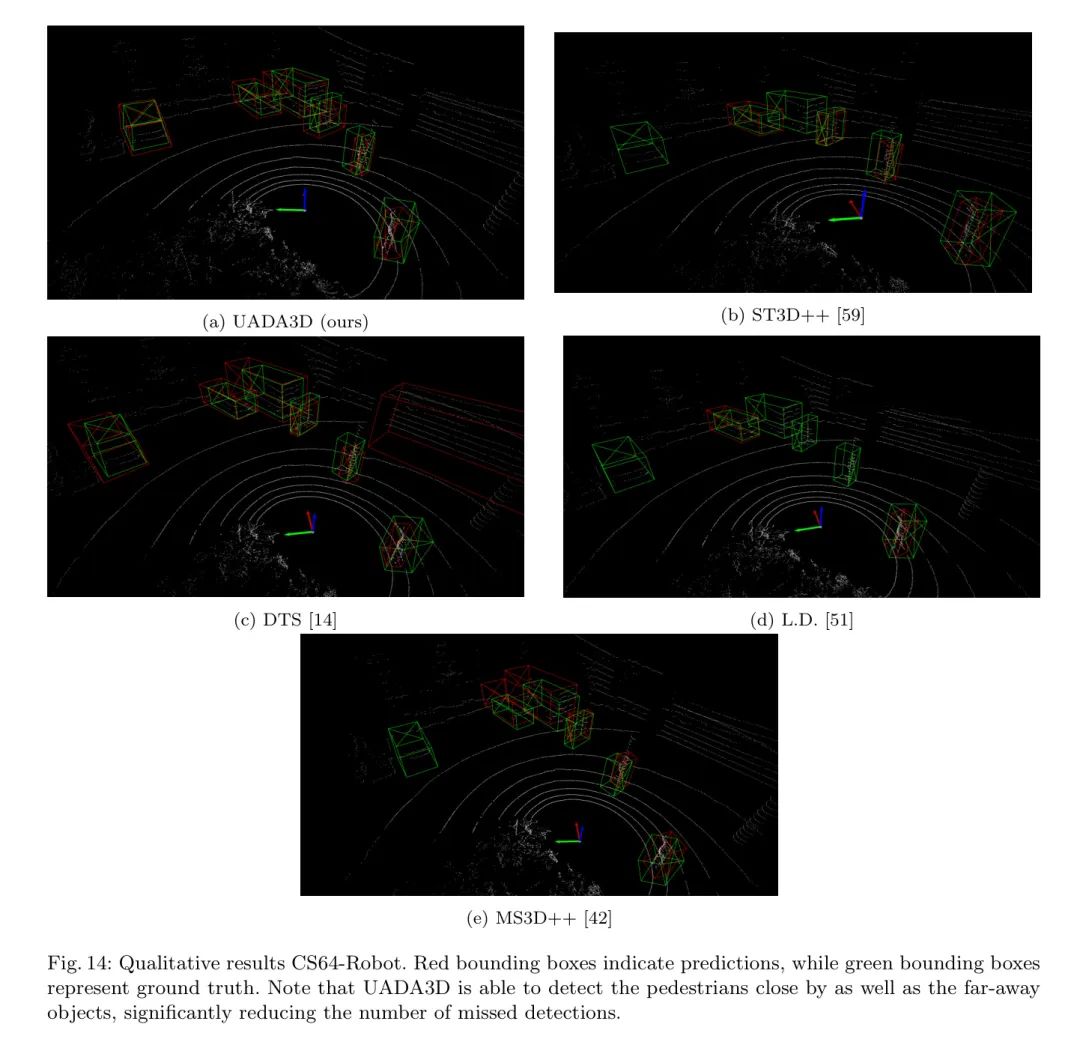

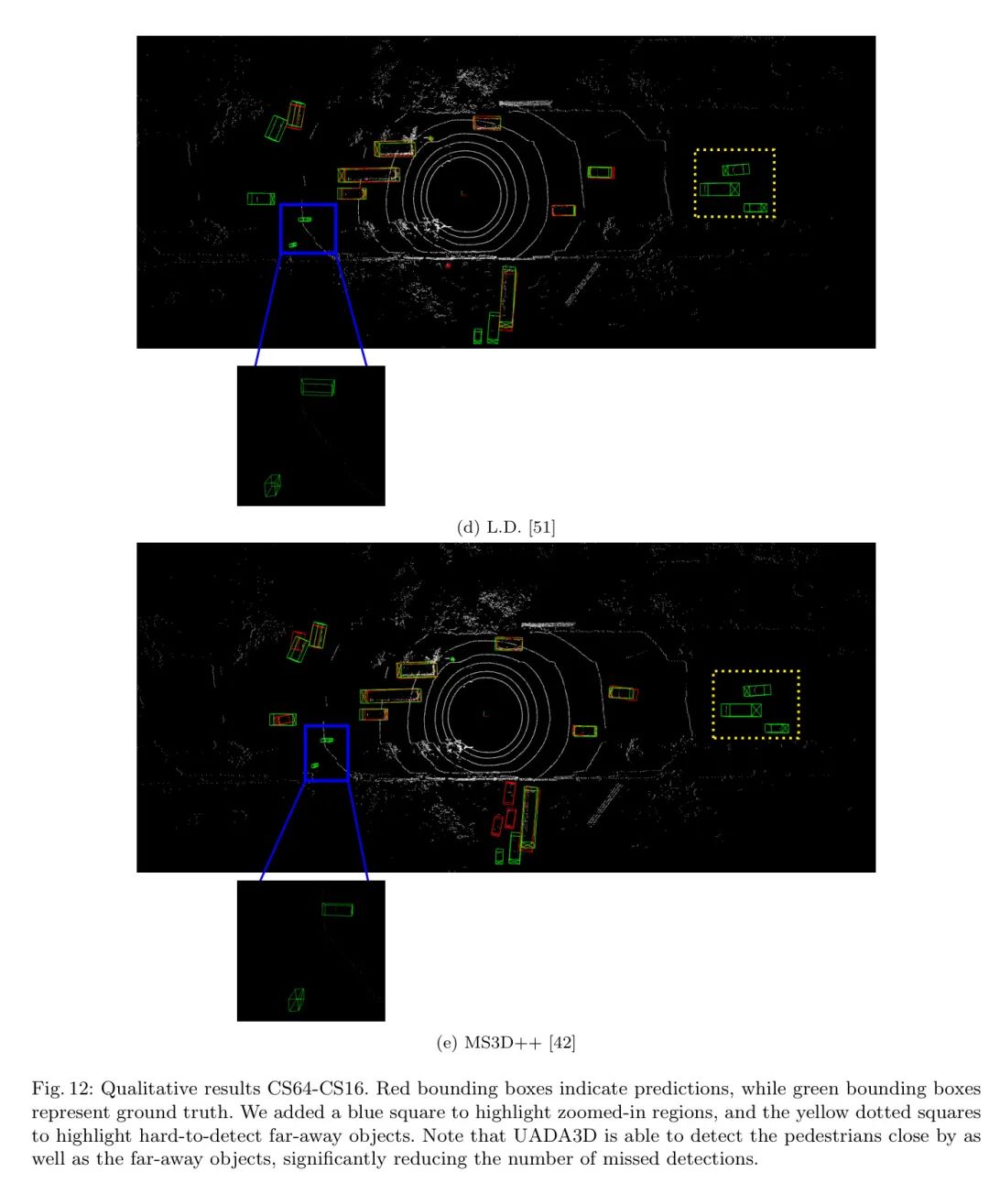

作者的方法,UADA3D,证明了能够准确训练模型识别物体,无论它们之间的距离和领域如何。这种增强的检测能力对所有三类:车辆、行人和骑行者都有效。作者的方法显著提高了模型识别远距离、近距离以及严重遮挡物体的能力。在接下来的图表中,红色边界框指示预测,而绿色边界框代表真实值。作者添加了蓝色方块来突出放大的区域,以及黄色虚线方块来突出难以检测的远距离物体。如图11至13所示,大多数对比模型往往会漏掉远距离或部分遮挡的物体,同时没有产生很多误报。此外,它们也往往漏掉较小的非车辆物体。而UADA3D则在这些具有挑战性的场景中大幅增强了模型的鲁棒性,确保不会忽略这些物体。作者的方法不仅检测到近距离和远距离的车辆(图11至13),还能检测到难以看到的行人和骑行者(图11和图12中的放大区域,以及图11中用黄色框圈出的一个实例)。此外,在图14中,展示了在机器人数据上的结果,作者显示了UADA3D的全面适应能力,即使领域差距非常大(从自动驾驶车辆领域到移动机器人领域),作者仍然成功识别了场景中的每一个物体。这突显了作者的方法在多样化和高要求的现实世界应用中的有效性。