遗忘:深度学习中的双刃剑?最新《深度学习中的遗忘》的研究综述

遗忘:深度学习中的双刃剑?最新《深度学习中的遗忘》的研究综述

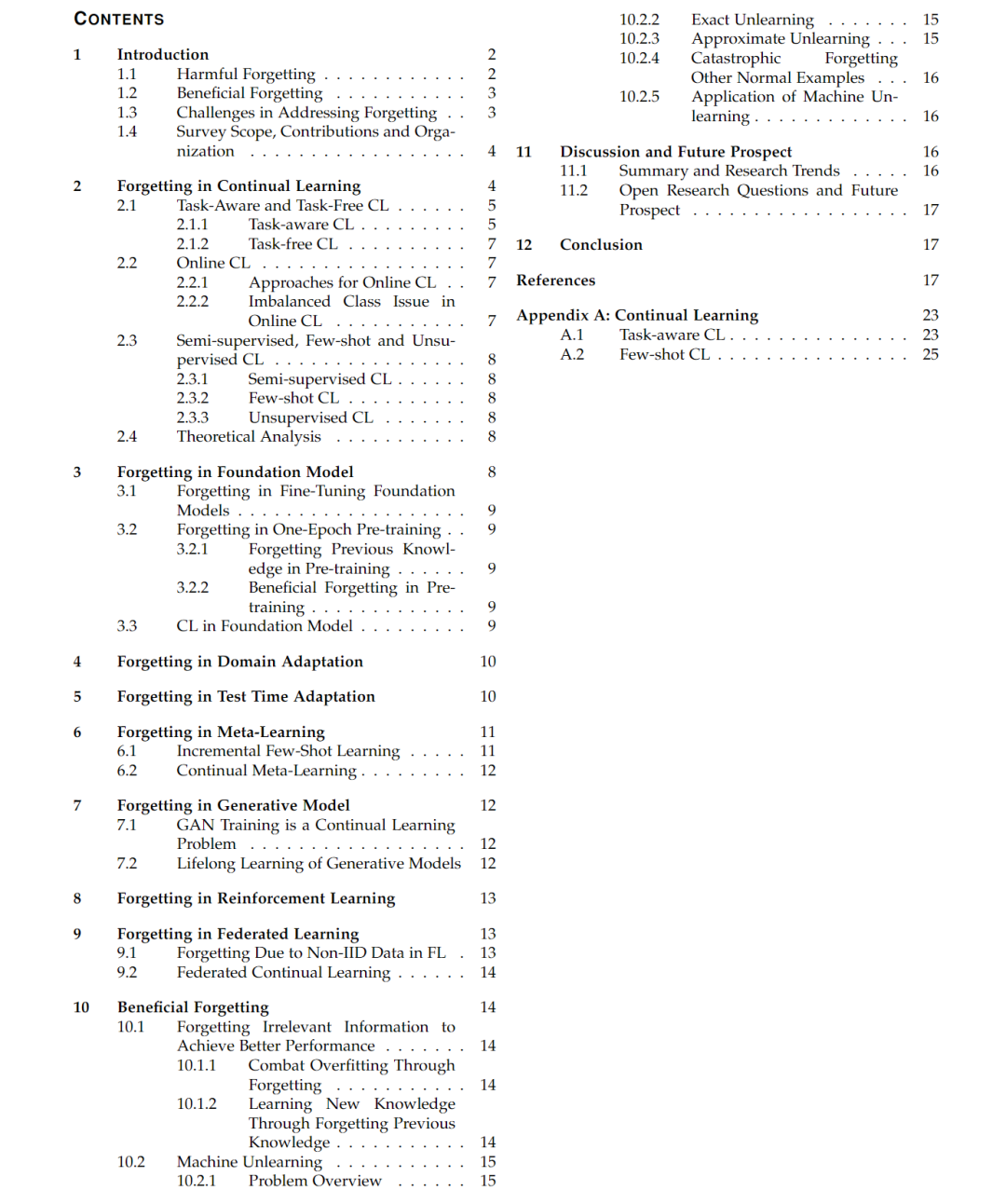

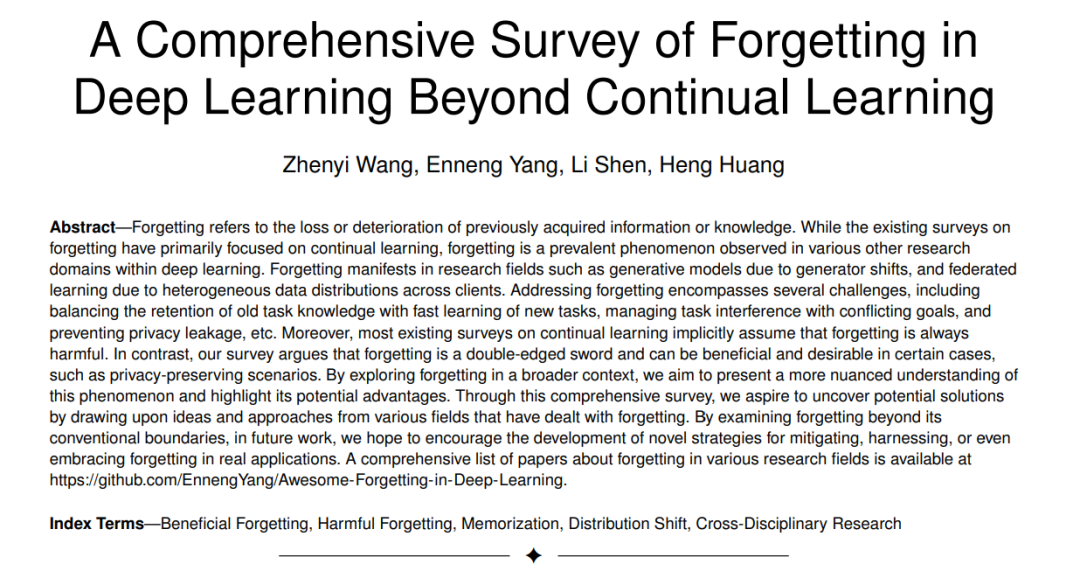

?本文介绍一篇《深度学习中的遗忘》的研究综述: 论文标题:A Comprehensive Survey of Forgetting in Deep Learning Beyond Continual Learning 综述论文地址:https://arxiv.org/abs/2307.09218 完整论文列表:https://github.com/EnnengYang/Awesome-Forgetting-in-Deep-Learning ?

「遗忘(Forgetting)是指之前获得的信息或知识的丢失或退化」。现有的关于遗忘的综述主要集中在持续学习上,然而,「遗忘也是深度学习的其他研究领域中普遍观察到的现象」。例如,遗忘在生成模型中由于生成器偏移而表现出来,在联邦学习中由于客户端之间数据分布异构而表现出来。解决遗忘包括几个挑战:平衡旧任务知识的保留与新任务的快速学习、管理具有冲突目标的任务干扰、以及防止隐私泄漏等。此外,大多数现有的关于持续学习的综述都默认遗忘总是有害的。相反,作者认为「遗忘是一把双刃剑,在某些情况下(如隐私保护场景)可能是有益的和可取的」。通过在更广泛的背景下探索遗忘,本综述旨在提供对这一现象的更细微的理解,并强调其潜在的优势。通过这项全面的综述,作者希望通过借鉴来自各种处理遗忘的领域的思想和方法来发现潜在的解决方案。通过超越传统的遗忘边界的分析,本综述希望在未来的工作中鼓励开发新的策略来减轻、利用甚至接受在实际应用中的遗忘。

什么是遗忘?

遗忘是指机器学习系统中先前获取的信息或知识随着时间的推移而退化的现象。在神经网络的早期,重点关注的是静态数据集上的训练模型,因此在这些设置中,遗忘并不是一个重要问题。「灾难性遗忘」的概念首先由McCloskey和Cohen在1989年正式提出。他们证明,在不同任务上顺序训练的神经网络在学习新任务时往往会忘记以前学习的任务。这一观察结果强调了解决序列学习场景中遗忘问题的必要性。后来,解决遗忘问题被正式称为持续学习(continual learning,简称'CL')。如今,遗忘不仅在持续学习领域而且在更广泛的机器学习社区中引起了极大的关注,这已经发展成为整个机器学习领域的一个必需考虑问题。

遗忘总是有害的吗?

在这篇综述中,作者根据具体的应用场景,将深度学习中的遗忘分为两类:「有害遗忘和有益遗忘」。当我们希望机器学习模型在适应新任务、领域或环境的同时保留以前学到的知识时,就会发生有害的遗忘。在这种情况下,防止和减少知识遗忘非常重要。相反,当模型包含可能导致隐私泄露的私人信息或当不相关信息阻碍新任务的学习时,就会出现有益的遗忘。在这些情况下,遗忘变得可取,因为它有助于保护隐私并通过丢弃不必要的信息来促进有效学习。

深度学习中「有害」的遗忘(Harmful Forgetting)

有害遗忘不仅在持续学习中被发现,而且在其他各个研究领域也被观察到,包括基础模型、域适应、测试时适应、元学习、生成模型、强化学习和联邦学习(foundation model, domain adaptation, test-time adaptation, meta-learning, generative model, reinforcement learning and federated learning)。现有的综述主要关注持续学习背景下的遗忘,他们常常忽视对其他相关研究领域的全面分析。这篇综述旨在通过概述不同学习场景中的遗忘(涵盖上述研究领域)来填补这一空白。

为了便于清晰和比较与遗忘相关的各种设置,下表中对有害遗忘进行了全面分析,并突出了不同设置之间的区别:

「问题设置」 | 「目标」 | 「遗忘的来源」 |

|---|---|---|

持续学习 | 学习非平稳数据分布而不忘记之前的知识 | 训练期间数据分布漂移 |

基础模型 | 大规模未标记数据的无监督学习 | 数据分布在预训练和微调中发生了变化 |

域适应 | 适应目标域,同时保持源域的性能 | 目标域随时间顺序移动 |

测试时适应 | 减少训练和测试之间的分布差距 | 适应测试过程中的测试数据分布 |

元学习 | 学习适应新任务的知识 | 增量元学习新类/任务分布变化 |

生成模型 | 学习一个生成器来近似真实的数据分布 | 生成器漂移/数据分布漂移 |

强化学习 | 最大化累积奖励 | 状态,行动,奖励和状态动态转换 |

联邦学习 | 不共享数据的去中心化训练 | 模型平均;非独立同分布数据;数据分布的转换 |

综述论文里第2-9章分别详细阐述了上表中每个领域中如何解决遗忘,感兴趣的读者可阅读原文细节。

深度学习中「有益」的遗忘(Beneficial Forgetting)

虽然大多数现存的研究工作普遍认为遗忘是有害的,但已经有工作认识到「在已学习的神经网络中忘记某些知识是有利的」。有益遗忘在两个主要场景中被证明是友好的:(1)选择性遗忘(selective forgetting),它有助于减轻过拟合和丢弃无用信息以提高模型泛化,以及(2)机器遗忘(machine unlearning),它可以防止数据隐私泄露。

- 首先,过拟合(overfitting)一直是机器学习中的一个基本问题,当模型记住训练数据,但难以推广到新的、看不见的测试数据时,就会发生这种情况。为了增强泛化性,避免记忆,而是专注于学习输入数据和标签之间的真实关系,这对模型是有利的。此外,以前获得的知识可能对于未来新信息的学习而言是无关或者无益。在这种情况下,有必要丢弃保留在模型内存中的无关信息。通过释放模型内部的容量,它变得更容易接受获取新知识。

- 另一方面,机器学习模型用户不仅可以请求从数据库中删除他们的训练数据,还可以请求删除预训练模型本身内的任何痕迹,从而行使被遗忘的权利。为了解决这个问题,研究人员探索了机器遗忘(machine unlearning)的概念,它允许故意忘记不需要的私人训练数据。此外,某些隐私攻击利用机器学习模型的记忆效应从预训练的模型中提取私人信息。例如,成员推理攻击(Membership inference attacks)可以确定数据点是否属于与预训练模型关联的训练数据。由于神经网络的记忆效应,这些隐私攻击在实践中能够成功。在这种情况下,故意忘记私人知识有利于保护隐私和防止信息泄露。

为了便于比较,下表中提供了有益遗忘的比较分析,包含了上述不同的设置以供参考:

「问题设置」 | 「目标」 |

|---|---|

减轻过拟合 | 通过选择性遗忘减轻训练数据的记忆 |

去偏或忘记无关信息 | 忘记有偏见的信息以获得更好的表现,或删除不相关的信息以学习新任务 |

机器遗忘 | 忘记一些指定的训练数据以保护用户隐私 |

综述论文里第10章详细阐述了上表中每个方向如何实现遗忘,感兴趣的读者可阅读原文细节。

解决遗忘的「挑战」

解决遗忘问题面临着许多挑战,不同研究领域的挑战各不相同。这些挑战包括:

- 「数据可用性」:数据可用性在各种情况下都是一个重大挑战,并且使解决遗忘的任务变得非常复杂。一方面,在学习新任务时,由于存储限制或数据隐私问题,先前任务数据的可用性可能会受到限制。这一挑战在持续学习、元学习、领域适应、生成模型和强化学习中普遍存在,其中访问过去的任务数据对于减少遗忘和利用先验知识至关重要。另一方面,某些场景禁止使用原始数据。例如,在联邦学习中,仅将预训练模型的参数传输到中央服务器,而不共享底层训练数据。

- 「资源约束」:资源有限的环境,例如内存和计算受到限制的环境,给有效解决遗忘带来了挑战。在在线持续学习和元学习中,数据或任务通常只处理一次,这些挑战尤其明显。此外,智能体(或学习者)对过去数据和经验的访问有限,这限制了强化先前学习任务的机会。对过去数据的有限接触使得记住知识和有效减少遗忘变得困难。此外,在线学习通常在内存或计算能力有限的资源受限环境中运行。这些限制为解决在线环境中的遗忘问题带来了额外的障碍。

- 「适应新的环境/分布」: 在持续学习、基础模型、强化学习、域适应、测试时适应、元学习和生成模型等各个领域中,目标环境或数据分布可能会随着时间而变化。智能体(或学习者)有必要适应这些新的环境或场景。这种适应可以在训练阶段或测试阶段发生。然而,当智能体(或学习者)适应新的场景和环境时,就会出现遗忘的挑战。由于数据分布的变化,智能体往往会丢失先前获得的知识或早期任务的性能。

- 「任务干扰/不一致」:不同任务之间的冲突和不相容的目标可能会导致任务干扰,给防止遗忘带来挑战。这个问题在各种情况下都可以观察到,包括持续学习和联邦学习。在持续学习中,连续观察的任务可能具有相互冲突的目标,使得网络很难在多个任务之间平衡其性能。当网络学习新任务时,这些相互冲突的目标的干扰可能会加剧遗忘问题。同样,在联邦学习中,由于客户端之间的异构数据分布,在不同客户端上训练的模型可能会表现出不一致。这些不一致可能会导致任务或客户干扰,进一步加剧遗忘问题。

- 「防止隐私泄露」:在某些情况下,保留旧知识可能会引起隐私问题,因为它可能会无意中暴露私人信息。因此,必须解决这些隐私风险并防止敏感数据的意外泄露。在这种情况下,目标转向忘记或擦除训练数据的痕迹,而不是记住它们,从而保护用户隐私。这一特定挑战是在机器遗忘领域遇到的,该领域的重点是开发有效忘记或删除机器学习模型中的训练数据痕迹的技术。

讨论与未来展望

总结和研究趋势

- 「关于遗忘的跨学科研究」:跨学科研究对于推进机器学习学科至关重要。各个领域通过跨学科研究提供了宝贵的见解和创新。这种探索既包括应用持续学习技术来解决其他研究领域的挑战,也包括应用各个领域的技术来解决持续学习中的问题。这些跨学科研究工作为不同研究领域的进步铺平了道路。在未来的工作中,预计积极促进不同研究领域的合作和促进思想交流对于克服学科障碍至关重要。

- 「机器学习中的故意遗忘」:在最近的研究中,故意遗忘已成为增强模型性能和解决数据隐私问题的一种有前景的方法。一方面,故意遗忘在消除模型训练期间有偏见和不相关的信息方面被证明是有价值的,从而减轻过拟合并提高泛化能力。另一方面,在机器遗忘的背景下,遗忘在删除私人数据以保护数据隐私方面发挥着至关重要的作用。

- 「理论分析的增长趋势」:最近,出现了一种新兴趋势,即进行理论分析,以深入研究不同研究领域对遗忘的理解和分析。这些理论分析旨在提供更有价值的见解并揭示发生遗忘的基本原理。

- 「应用基础模型解决遗忘问题」:基础模型在解决各个研究领域的遗忘方面表现出了巨大的潜力,使其成为一个活跃且有前途的研究方向。

开放研究问题和未来展望

接下来,该综述展望了未来研究的几个潜在研究方向。

- 「遗忘的深入理论分析」:现有方法大多是经验性的,缺乏理论保证和综合分析。因此,迫切需要跨不同学习领域进行更彻底的理论分析。未来的研究工作应该旨在通过纳入严格的遗忘理论分析来弥合这一差距。

- 「可信的遗忘」:现有的大多数关于遗忘的研究主要集中在其对模型性能的影响,而忽略了其他关键方面,例如鲁棒性、公平性、透明度等。为了弥补这一研究差距,未来的研究应该投入更多的努力来分析和理解遗忘对这些可信属性的影响。

- 「记忆和遗忘之间的适当权衡」: 在记住先前的知识和保护隐私之间取得平衡是一个关键的研究问题。记住更多以前的知识会增加记住私人信息的风险,从而可能损害隐私。相反,优先考虑隐私保护可能会导致牺牲之前任务的性能。在记忆和遗忘之间实现适当的平衡对于有效应对这一挑战至关重要。未来的研究应侧重于开发能够有效管理知识保留的方法和技术,同时确保隐私保护,从而在两者之间取得最佳平衡。

总结

这篇综述从「有害的遗忘」和「有益的遗忘」两个角度讨论了深度学习中多个领域普遍存在的「遗忘」问题,以及对应的缓解遗忘或主动遗忘的策略。对深度学习中的「遗忘」问题感兴趣的读者可进一步阅读论文细节:

综述论文地址:https://arxiv.org/abs/2307.09218 完整论文列表:https://github.com/EnnengYang/Awesome-Forgetting-in-Deep-Learning 论文结构: