一个epoch打天下-理论基础:短期突触可塑 建模动态环境的最优性

一个epoch打天下-理论基础:短期突触可塑 建模动态环境的最优性

paper:Optimality of short-term synaptic plasticity in modelling certain dynamic environments

关键点:

a formal analysis that concluded that the Bayesian generative model of the future observations given the past ones requires for its optimality a mechanism equivalent to ST-STDP

严格推导了将一类常见动态环境建模为新型ML和理论神经科学算法的最佳解决方案,即神经弹性聚类。我们已经指定它需要HebbianSTP来实现其最优性,并且我们已经证明了它与皮质计算的合理等价性。因此,通过这些计算,以数学方式描述的典型皮层神经回路可以维持预测和推断动态环境的贝叶斯生成模型

连续性意味着最近的观察可以作为对未来的预测,而随机性意味着进一步完善该预测将无济于事。正因为如此,ST?STDP对特定物体近期未被遮挡像素的短期突触记忆,结合代表其物体类别的长期权重,是该物体类别未来像素的最优模型。

一个基于事件的算法的实现,该算法适用于神经形态硬件,在实践中展示并结合了许多先前假设的神经形态计算的优势。

在一定程度上规避了深度学习的一个臭名昭著的局限性,即其有效性受到训练集的广度和规模的限制

摘要:

生物神经元及其用于神经形态人工智能(AI)的计算机仿真使用非常节能的机制,例如基于脉冲的通信和局部突触可塑性。目前尚不清楚这些神经元机制是仅提供效率还是构成生物智能优势的基础。在这里,我们严格证明,实际上,贝叶斯最优预测和推断随机但连续变化的环境(一种常见的自然环境)依赖于短期尖峰时间依赖性可塑性,这是生物突触的标志。此外,这种通过可塑性进行的动态贝叶斯推理使模拟中的大脑皮层回路能够识别以前看不见的、高度扭曲的动态刺激。

引人注目的是,这还引入了一种生物建模的AI,这是第一个克服深度学习的多重限制并在视觉任务中优于人工神经网络的AI。类皮质网络是尖峰脉冲和基于事件的,仅在小的、狭窄的和静态的训练数据集上以无监督和局部可塑性进行训练,但比深度神经网络更好地识别看不见的、转换的和动态的数据。激活,通过对转换数据的监督反向传播进行训练。这些结果将短期可塑性与高级皮层功能联系起来,表明自然智能对自然环境的最优性,并将神经形态人工智能从单纯的效率转变为计算至上。

介绍:

即使是最成功的人工神经网络(ANN)算法,中枢神经系统(CNS)中神经网络的基本操作原理及其计算模型1?3也不是功能的一部分。生物神经元的一个关键方面是它们通过使用动作电位(即刻板电压尖峰)进行通信,动作电位在它们的时间中携带信息。此外,为了处理和学习这种时间信息,突触(即神经元之间的连接)配备了可塑性机制,可动态改变突触功效,即强度,具体取决于突触后和/或突触前尖峰的时间。例如,脉冲时间依赖可塑性(STDP)是一种Hebbian,即关联可塑性,其中成对的突触前和突触后脉冲会根据脉冲对的顺序和延迟引起突触强度的变化。4–6塑料变化可以是长期的也可以是短期的。短期可塑性(STP)7–9已被证明可作为一种信号过滤机制,10通过与STDP相互作用,11、12将学习重点放在输入的选择性时间尺度上,以实现长期短期记忆,13并作为生成模型的调节机制。14这种生物物理机制已被电子物理学模拟以实现神经形态计算系统。硅尖峰神经元、突触和神经形态处理器具有极高的能效15?19,并且在与生物神经元接口等任务中显示出特别的前景,包括学习解释大脑活动的芯片。20、21

但人脑不仅在效率方面远远超过当前的人工神经网络,而且在要求苛刻的任务中的最终表现也远远超过当前的人工神经网络。确定这种计算优势的来源是神经科学的一个重要目标,也可能导致更好的人工智能。然而,大脑中尖峰神经元和突触的许多特性,特别是那些基于时间的机制,例如尖峰激活本身,还有STDP、STP、时变突触后电位等,在一类单独的计算模型中进行了研究,即尖峰神经网络(SNN),1并且只是稀疏松散地嵌入到最先进的AI中。

因此,有理由推测大脑基于脉冲的计算机制也可能是其性能优势的部分原因。事实上,有证据表明大脑强大的计算能力来自具有基于脉冲的可塑性的简单神经回路。例如,大脑在维护环境的统计最优内部模型方面得到了充分证明。22–30尖峰神经元可以产生此类贝叶斯模型,而STDP可以形成和更新它们以解释新的观察结果。31这种结构的结构SNN被认为是大脑neocortex中的规范主题,即模式。32它们通过STDP的功能类似于在线聚类或期望最大化,31它们的模型可应用于机器学习(ML)的常见基准测试任务.33这种将突触可塑性等低级生物物理学与高级皮层功能联系起来,并将生物回路嵌入贝叶斯推理等严格框架中的理论建模和模拟结果是基础性的,但也非常稀缺。本文的第一个目标是产生这样的见解,揭示STP与皮质贝叶斯计算的联系。

第二个目标是证明具有来自SNN的生物或神经形态机制的模型可以优于不使用这些机制的AI模型,从而可以解释自然智能的一些剩余独特性。有证据表明,这在某些情况下是可能的。已经提出了SNN独有功能的建议,1、12、14包括模型34,最近的实验证实灵长类动物大脑中的单个尖峰神经元,即使是其中的一个隔室,也可以计算传统上被认为需要多层神经网络的功能传统的人工在神经网络(ANN)。然而,具体而言,到目前为止,受大脑启发的SNN在机器智能任务中可实现的准确性一直落后于ANN,36?39并且对SNN原生属性的理论理解很少

因此,不仅SNN机制在AI准确性方面的优势仍然是假设性的,而且还不清楚这些机制是否是大脑优于AI的原因。

在这篇文章中,我们表明,在一个常见的问题设置中即具有随机但连续动态的环境的预测和推理不仅SNN和皮质模型的生物计算机制实现了一个解决方案,它们确实是理论上最优的模型,并且可以胜过缺乏这些神经形态机制的深度学习训练的人工神经网络。作为其中的一部分,我们揭示了STP之前未描述的作用。我们还展示了皮层电路图案可以对非平稳输入分布执行贝叶斯推理,并且可以在严重失真的情况下识别以前看不见的动态变换刺激。

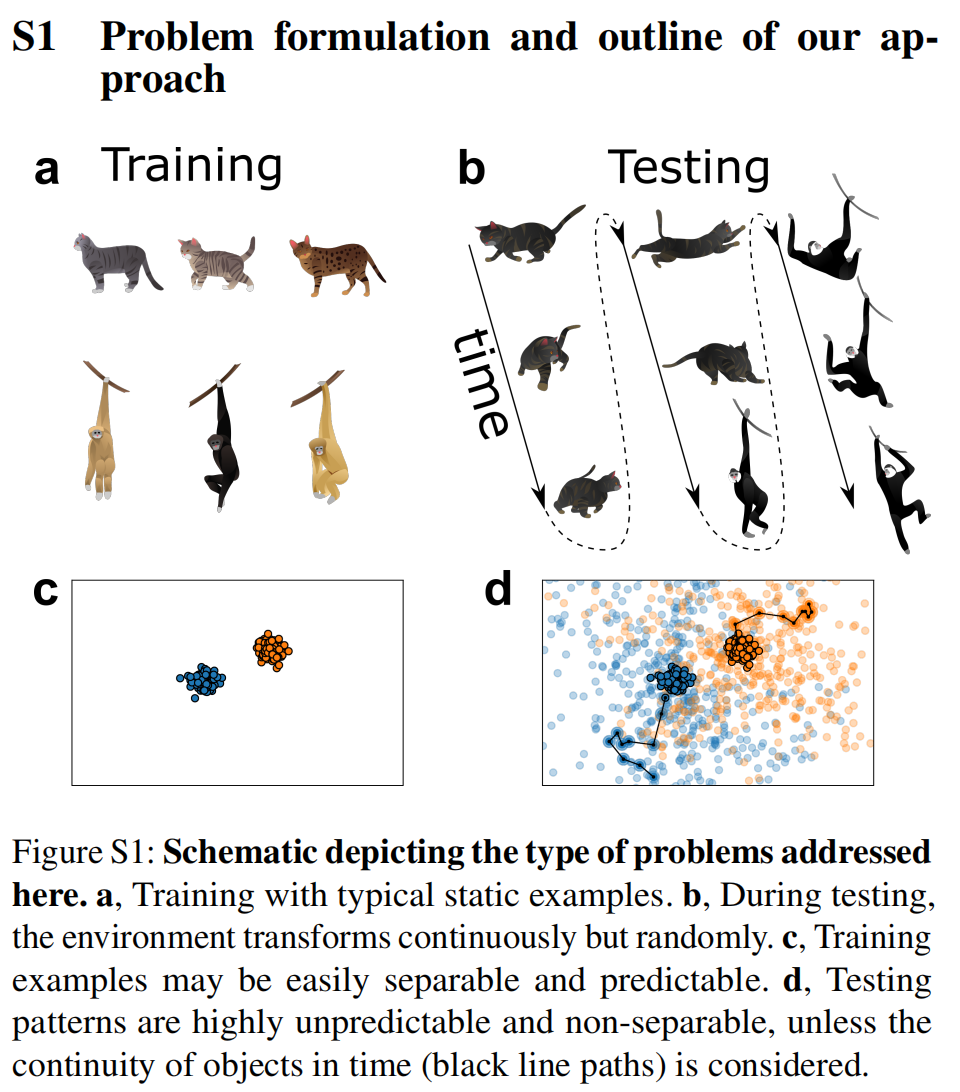

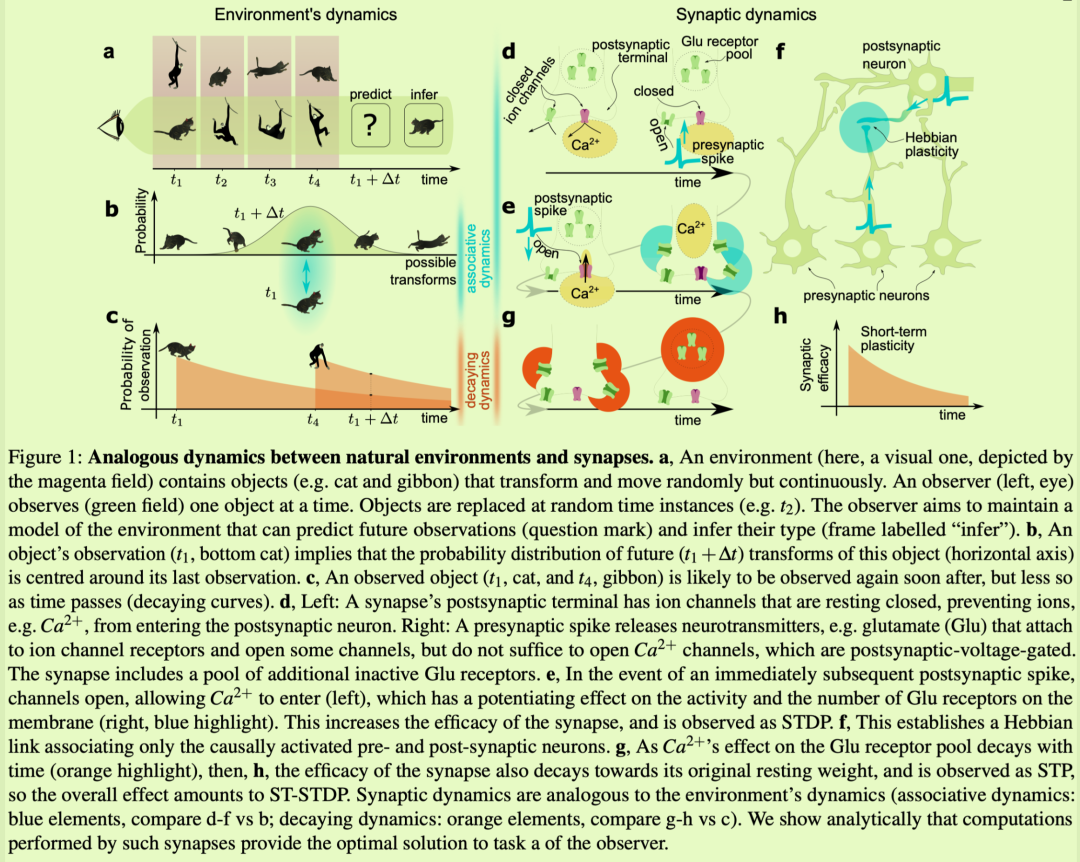

在接下来的部分中,首先,我们提供了一个直觉,说明为什么以短期STDP(ST?STDP)形式出现的STP可以在动态环境建模中发挥作用。随后,推导出该任务的理论上的最佳解决方案,没有任何参考突触可塑性。结果是贝叶斯推理的解决方案,具有与“神经弹性聚类”算法等效的解释。理论部分最后展示了这种弹性集群与在其突触处具有ST?STDP的皮质微电路模型之间的等价性,从而证实了最初的直觉。接下来,在尖峰模拟中,我们演示了使用STP的类皮质模型的操作,而它是通过变换图像来刺激的。最后,我们将其性能与ANN进行比较。ST?STDP反映了自然环境的动态我们将环境建模为一组对象,每个对象属于K类中的一个。每个对象都可以以随机或未知但时间连续的方式进行变换。为了预测未来的转换并推断它们的类别,观察者观察环境。每个时间实例只观察到一个对象,观察者随机切换到不同的对象(图1a)在没有关于物体动力学的额外先验知识的情况下,未来对潜在变形物体的观察分布在其最近的观察周围(图1b;另请参见方法部分和补充信息,S2部分)。此外,时间和空间的连续性意味着观察到的物体很可能会在之后立即再次被观察到,但是随着物体相对于观察者在空间中移动,根据函数f(t),这种可能性会随着时间衰减为零(图.1c和补充信息,S1节)。该模型相当笼统,因为它的主要假设仅仅是环境是连续的,具有随机或未知的动态。此外,没有假设特定的感官领域,即转换对象的范围可能从场景理解任务中的视觉模式到运动控制中身体状态的本体感受表示,

It can be seen that these common dynamics of natural environments bear significant analogies to the dynamics involved in short-term STDP (ST-STDP), i.e. a particular type of STP. That is a realization of STDP with short-term effects,41–43 并且已被提议作为生物神经网络中工作记忆的机制。44,45它在长期增强的早期阶段被观察到。一系列成对的突触前尖峰和突触后尖峰可导致突触效能持续增加。46–48然而,当给予的刺激较少时,诱发的变化是短期的。

这种突触功效的短期增加是由一系列生物物理事件介导的(见图1,dh)。突触前动作电位释放兴奋性神经递质,例如谷氨酸(Glu),它附着在突触后末端离子通道的受体上,从而打开一些通道(图1d)。然而,带有N?甲基?D?天冬氨酸(NMDA)受体的钙通道是电压门控的,49即只有当Glu附着时突触后电压增加时它们才会打开。在突触前突触达到这一点后不久就会出现突触后尖峰,因此钙确实会进入突触后细胞。钙与蛋白激酶相互作用,增加突触后膜上Glu受体的活性和数量 (图1e)。这被观察为赫布增强(图1f)。效果是短期的,因为Glu受体会恢复到静止状态。皮层短期功效变化的衰减率的时间常数可以短至几十毫秒,50也可以长达1.6分钟。43

请注意,通过ST?STDP的赫布方面形成的联想记忆类似于环境中的联想动态,即对象的最新形式与其最可能的未来形式的关联(图1,蓝色元素)。在第二个类比中,这种增强的瞬态性可用于计算,以反映再次观察同一物体的瞬态下降概率(图1,橙色元素)。事实上,我们进行了一项正式分析,得出的结论是,在给定过去观测值的情况下,未来观测值的贝叶斯生成模型需要一种等同于ST?STDP的机制来实现其最优性。

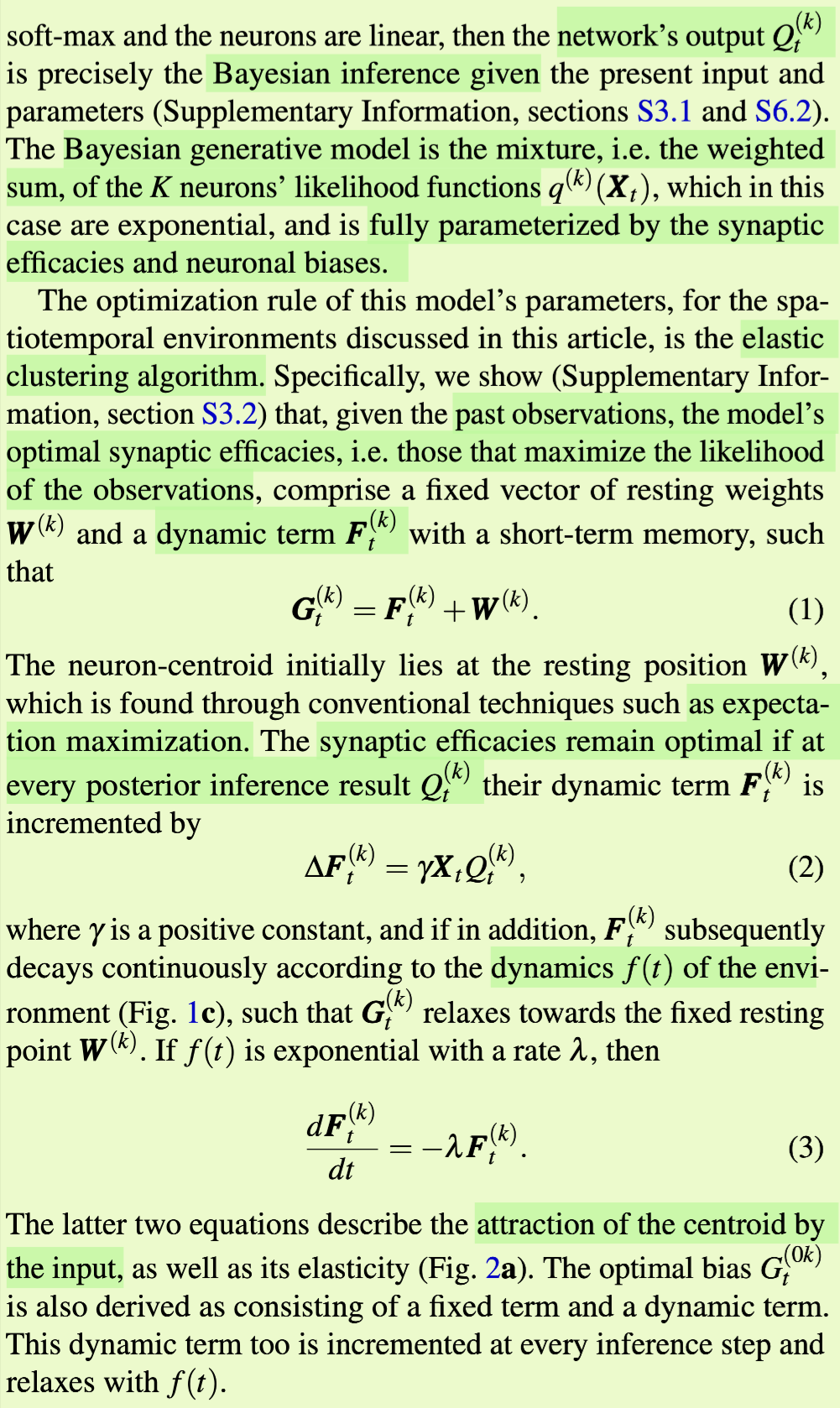

神经弹性聚类算法

我们的正式推导开始于从上一节关于环境的假设中获得对未来观察的概率分布的历史相关描述。

接下来是定义一个参数化的生成模型,该模型将适合该分布数据。最终,我们通过分析最小化模型与数据的差异,找到给定过去观察的模型的最大似然最优参数。我们在补充信息中提供了完整的推导,并在方法部分提供了摘要。我们表明,派生的生成模型等效于神经回路的典型皮层模式,ST?STDP对其进行了自适应优化(补充信息,第S6.2节),并且在几何上可解释为一种新颖且直观的聚类算法,基于具有弹性位置的质心(图2a和补充信息,S5节)。具体来说,如果输入样本Xt具有n个特征,则为K个类中的每一个分配一个质心,由具有n个输入突触的神经元表示。

与生物机制的等价性

值得注意的是,从机器学习理论推导中出现的解决方案(方程式1?3)实际上是突触功效的ST?STDP规则(参见补充信息,第S6.2节),正如我们接下来解释的那样。在这种直接等效中,方程式决定了突触效能向量的变化,从而描述了突触可塑性规则。具体来说,该规则规定了(突触前)输入对功效的吸引力,而且(k)与(突触后)输出Q(方程式2)成比例,因此它是生物学上合理的赫布可塑性规则。我们还表明,如果输入变量被编码为二元泊松过程,例如在速率编码的背景下(SNN中输入编码和生物经元之间通信的主要策略31、33、51–53时间依赖)突触更新规则作为贝叶斯算法的一部分出现(补充信息,S6.1节)。得到的解决方案然后将Hebb规则进一步指定为尖峰时间相关规则,即STDP,取决于突触前和突触后尖峰之间的时间间隔τ。最后,突触效应的松弛动力学f(t)对静息权重W(k)的影响,例如方程式。3,表明可塑性是短期的,即STP,从而方程充分描述了ST?STDP(见图2b)。这表明,对于这些动态环境,最佳模型依赖于特定可塑性机制的存在,揭示了突触动力学与大脑环境内部模型之间可能存在的直接联系。重要的是,这种突触机制以前没有与传统的ML或具有连续激活的神经元相关联。我们的整体理论基础将STP整合到这些框架中。请注意,偏置参数Gt的dy(0k)动力学捕捉了神经元内在兴奋性的演变,这是一种在许多实验中观察到的依赖于使用的可塑性

值得注意的是,我们表明推导出的最佳模型可以通过皮层中常见的网络结构实现,尽管是随机的,包括在生物学上也合理的神经元 (补充信息,第S6.3节)。特别是,soft?max概率推理输出由随机指数尖峰神经元计算,组装在一个强大的微电路结构中,该结构在新皮层层中很常见,32即具有横向抑制的软赢家通吃(WTA)电路。31,33,58随机指数尖峰行为与真实神经元的记录活动非常一致。59使用类似的技术,31该网络的输出尖峰可以显示为来自后验分布的样本,以输入为条件和它的过去。等式的参数更新。此尖峰实现中的2是基于事件的,它们发生在每个输出尖峰时,并且它们取决于来自先前输入尖峰的延迟τ。最后,为了完成模型的生物真实性,即使是初始的静止权重W(k)也可以在ST?STDP激活之前通过标准的长期STDP31获得。

随机指数神经元的替代模型,以及计算神经科学模拟和神经形态硬件电路中的常见选择,由于其有效的简单性,是泄漏集成和发射(LIF)模型。我们展示了由LIF神经元构建的WTA电路,如果它通过等式1?3的相同ST?STDP规则实现弹性聚类,则该网络维护随机连续环境的近似模型(补充信息,第S4、S6节).

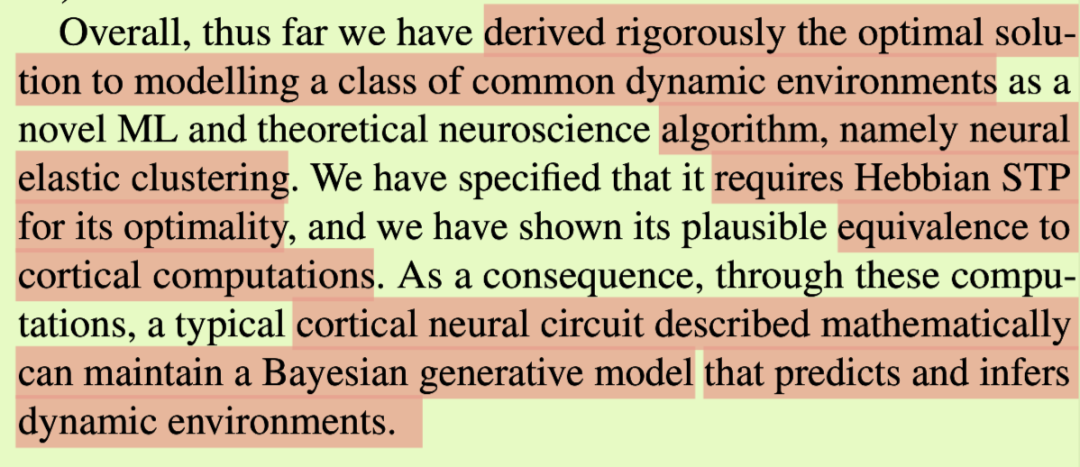

总体而言,到目前为止,我们已经严格推导了将一类常见动态环境建模为新型ML和理论神经科学算法的最佳解决方案,即神经弹性聚类。我们已经指定它需要HebbianSTP来实现其最优性,并且我们已经证明了它与皮质计算的合理等价性。因此,通过这些计算,以数学方式描述的典型皮层神经回路可以维持预测和推断动态环境的贝叶斯生成模型。

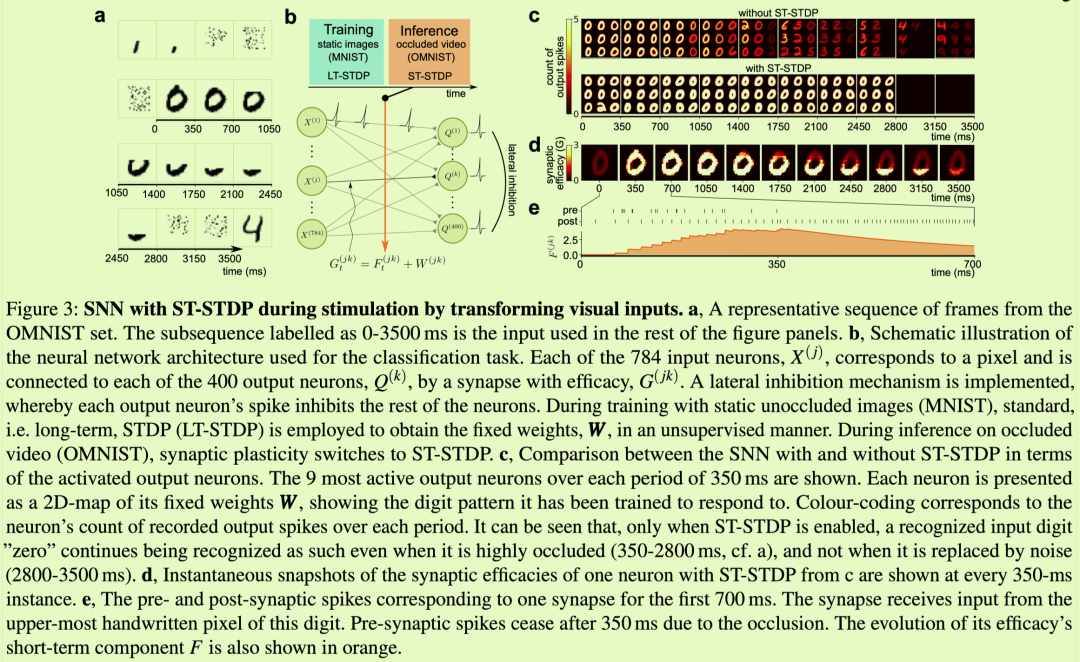

应用于识别转换视觉输入

我们现在将在模拟中展示ST?STDP对皮质样电

路功能的影响。重要的是,我们将展示我们对皮层神经微电路脉冲模型的模拟也为AI带来了令人惊讶的实际优势,这可以克服其他神经AI方法的关键局限性。我们将此SNN应用于识别一系列逐渐遮挡的MNIST(OMNIST)手写数字的帧的任务(参见方法部分)。至关重要的是,网络在此任务上进行了测试,而没有事先暴露于时间视觉序列或被遮挡的数字,而仅暴露于静态和未转换的MNIST数字。皮质微电路图案用于处理动态变换和扭曲的感觉输入的这种潜在功能以前没有得到证明。

。。。。。。

连续性意味着最近的观察可以作为对未来的预测,而随机性意味着进一步完善该预测将无济于事。正因为如此,ST?STDP对特定物体近期未被遮挡像素的短期突触记忆,结合代表其物体类别的长期权重,是该物体类别未来像素的最优模型。

。。。。。

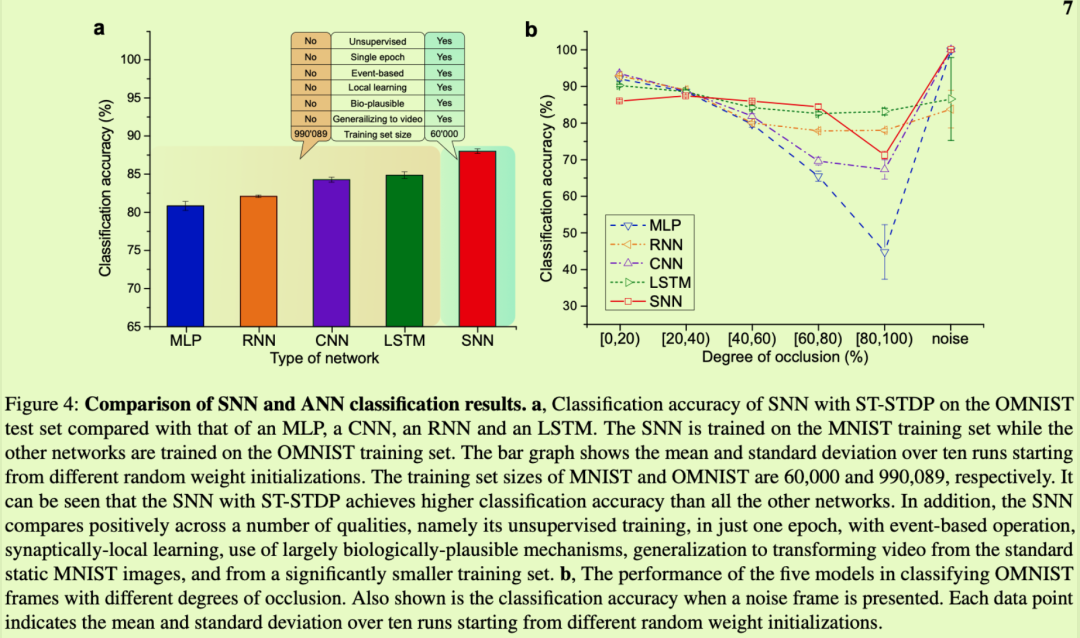

与人工神经网络的比较

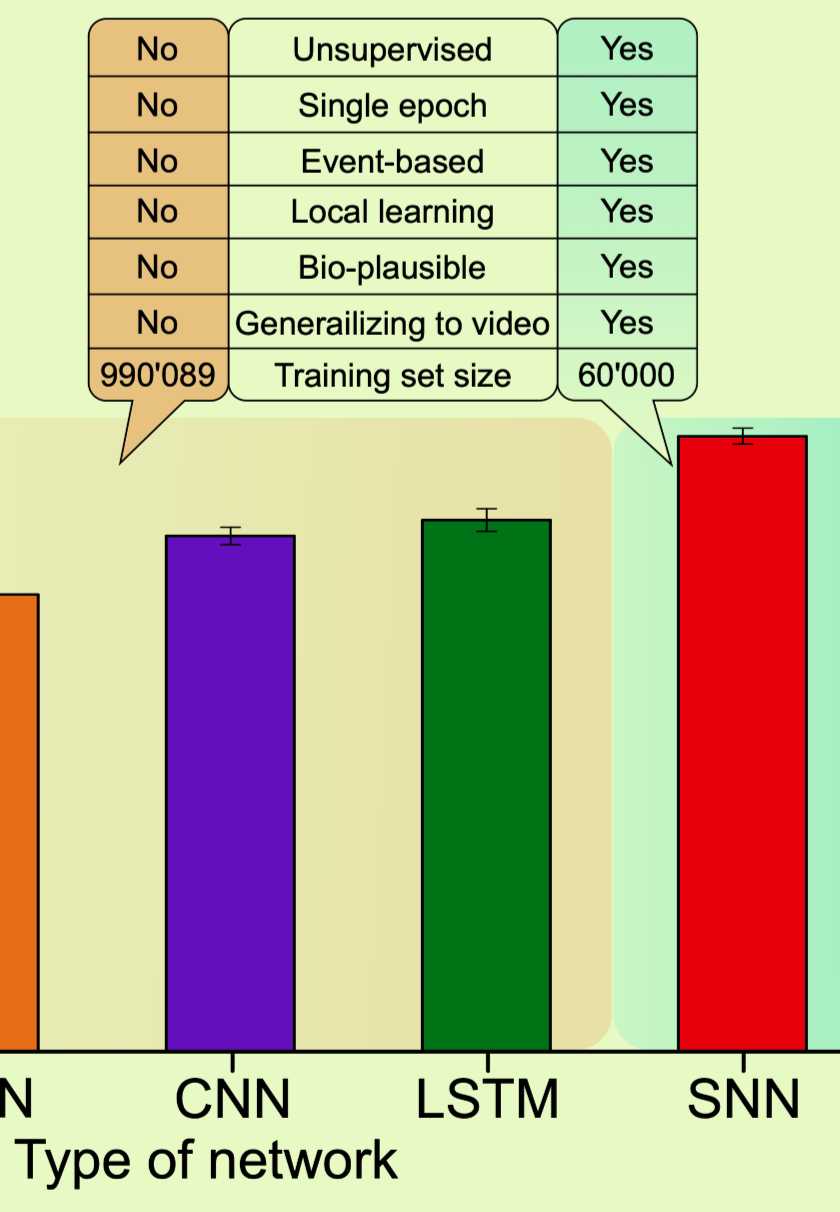

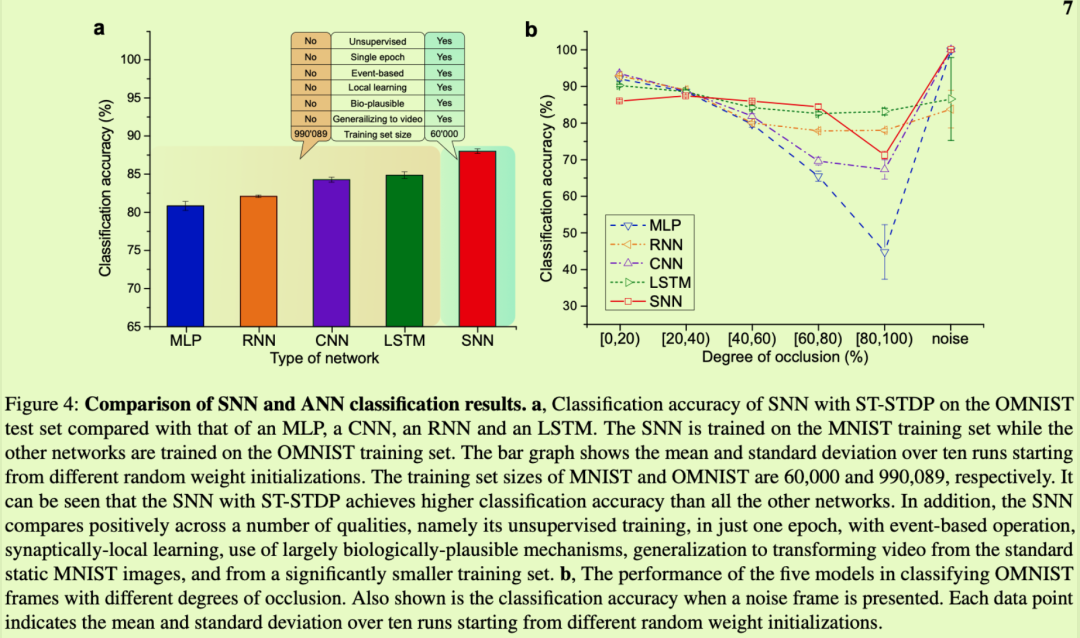

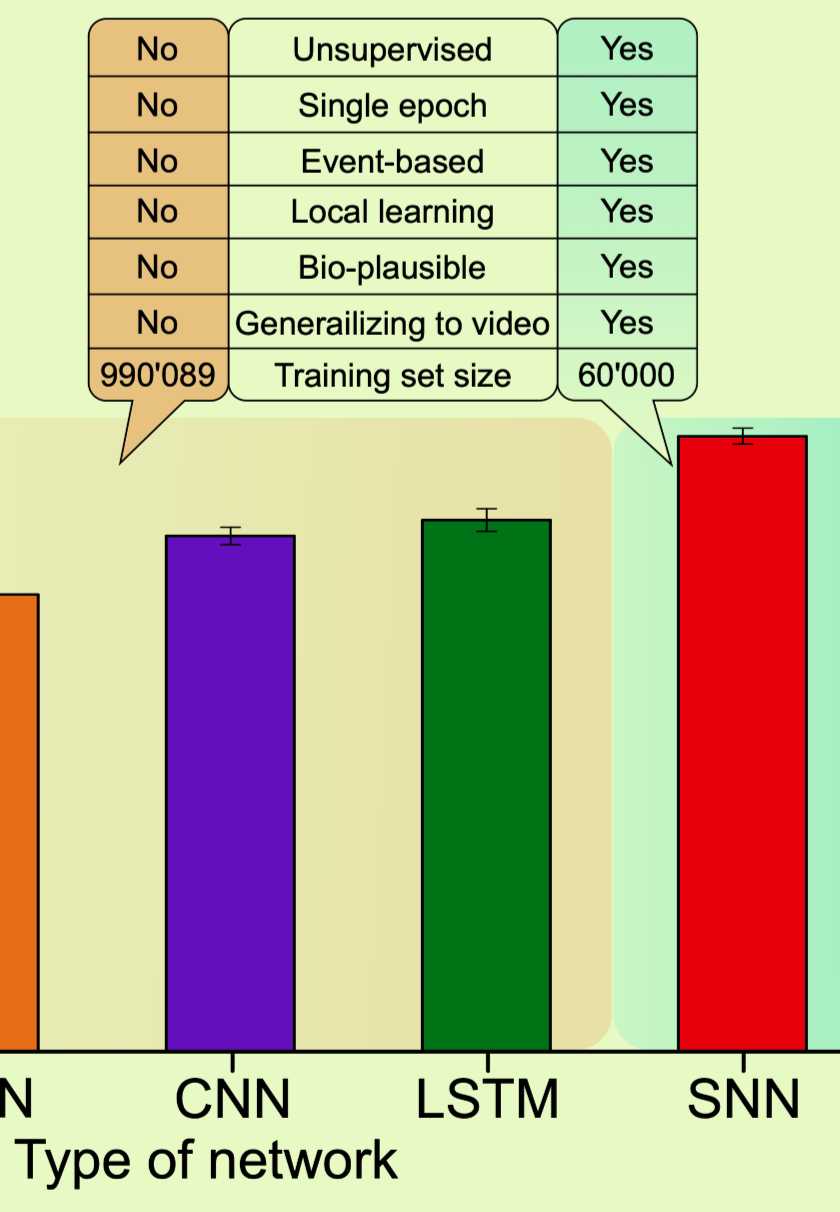

与更传统的ML和推理相比,神经形态算法通常会牺牲一些准确性,但我们现在将证明,这种SNN实际上在广泛的ML环境中是一种相当有竞争力的算法,并且在这个特定任务中,它不仅在准确性上优于强大的ANN模型,但在所有相关方面。我们将其与通过误差反向传播训练的ANN进行比较,特别是多层感知器(MLP)、卷积神经网络(CNN)、递归神经网络(RNN)和长短期记忆(LSTM)单元。每个网络的性能取决于其大小,因此我们使用的ANN的可训练参数至少与SNN一样多(参见方法部分)。

RNN和LSTM也有望利用OMNIST数据中存在的轻微时间规律性。这些循环网络的任务比仅在静态MNIST数据上训练的SNN的任务更容易。然而,即使是这些网络,即使它们在多个时期的完整OMNIST训练序列上进行了训练,并通过时间反向传播,它们也达到了82.01%±0.17%和84.78%±4.21%的准确度,这仍然低于SNN的性能,即使SNN仅在一个epoch内以无监督和本地方式在MNIST的60,000张静态图像上进行训练(图4a)。

OMNIST数据序列具有一定程度的随机性,特别是在每个数字序列的持续时间、随机噪声帧以及数字的随机顺序方面,因此无法精确地学习这些序列。

SNN通过突触的在线适应和STP的短期记忆来实现对随机变化的导航。

它比循环ANN更好地处理这些变化,因为每个神经元在其突触中配备的不是一个而是多个独立的短期记忆,而不是RNN和LSTM网络中每个神经元的单个短期记忆.因此,STP实现了输入特征特定的,即在这种情况下像素特定的存储器(参见补充信息,S9节)。结果,具有ST?STDP的最近活跃的神经元在其突触状态中随时间向前传播,不仅刚刚观察到与其偏好刺激相似的输入信息,而且还观察到该输入刚刚具有的特定特征。这种特异性允许每个神经元继续识别跨帧持续存在的对象,即使这些对象转换成与存储在长期权重中的像素不同的像素(参见补充信息,图S2)。此外,它可以防止错误识别突然引入的不同对象,例如嘈杂的帧,就好像它是仍在短期记忆中的先前对象的延续。重要的是要注意,SNN中STP的时间常数是所有神经元和突触的单个超参数,而RNN和LSTM有多个时间常数,每个循环连接一个。此外,虽然SNN的时间常数只是手动调整,但RNN和LSTM时间常数是通过时间反向传播客观优化的,表明SNN的优势不在于其时间常数参数的选择,而在于独特的模型结构。在补充信息的S12节中,我们进一步阐述了LSTM和ST?STDP中的短期记忆之间的对比。

噪声是数据集的一个关键方面,它使该SNN比LSTM更适合该任务。在OMNIST中,我们放宽了理论假设,对象形状及其变换中除了噪声之外几乎没有随机性,因为引入遮挡的变换是可重复的并且相当小。噪声的作用是在我们的理论问题设置假设的输入对象形状中引入一些随机性,它对结果至关重要,以及每个数字的随机持续时间和连续性。这种转换中缺乏随机性使得OMNIST成为ST?STDP可以应用的更容易的问题之一,如果不存在噪声,其他模型也可以表现良好,例如LSTM在非噪声帧中的准确性(图4b)).这个遮挡问题仍然被选中,因为它的视觉简单性,它对计算机视觉领域的重要性,以及它比具有真正随机变形的数字的假设数据集更强的真实性。在对象(例如数字)实际上随机变换和变形的更一般和更自然的场景中,在不添加噪声的情况下已经满足使问题最好由STP解决的假设。同样,在可能的转换未知的任务中,例如在训练期间时间数据不可用的问题中,ST?STDP的准确性优势变得更加强大。我们的结果证明了这一点,尽管仅在MNIST上进行了训练,但SNN是OMNIST上最准确的模型,并且当MLP和CNN也仅在MNIST上进行训练时,其优势进一步增强。事实上,与在OMNIST训练序列上训练的LSTM的精度比较对于SNN来说是不公平的,因为SNN被要求解决一个不同且更难的任务,即从静态MNIST集进行概括的任务。尽管如此,它的性能还是最好的。

图4总结了ML相关基准测试的结果。

但是,应该记住,仅仅我们的算法在ML基准测试中的准确性优势并不能概括本文的全部范围。我们描述的定性优势可能更有趣,并在图4a的插图中进行了总结。同样重要的是,这里报告的结果也与理论ML、神经科学和神经形态计算有关,我们将在下一节中进一步讨论这些

讨论

我们的结果以单一机制为中心,但具有多重含义。它们涵盖了从一类ML问题的最优解的理论推导,到突触可塑性的新作用,大脑皮层电路模型中动态贝叶斯推理的新推导理论,模拟显示扭曲和变化的感觉输入的处理这样的生物微电路模型,一个满足神经形态计算需求的新数据集,一个简单的ML解决方案,用于在某些类型的遮挡下进行视觉识别,以及一个基于事件的算法的实现,该算法适用于神经形态硬件,在实践中展示并结合了许多先前假设的神经形态计算的优势。

更具体地说,我们已经从理论上和实验上证明,到目前为止,SNN独有的某些属性对于随机但不断变化的环境的最佳处理是必需的,就像自然环境通常那样。

这表明大脑中基于尖峰的操作可以为其提供统计上最佳的动态环境内部模型,并且可能是大脑在与自然环境交互时相对于机器的计算优势的部分原因。应该注意的是,虽然尖峰活动本身可能对大脑和ML有其自身的优势,但我们特定情况下的最优性并非来自尖峰本身,而是来自随之而来的突触动力学。这种时间反应由突触周围事件是SNN的一个标志,并且在传统的ANN模型中不存在,但正如我们所展示的,它们可以独立于尖峰进行建模。我们还表明,皮层神经微电路模型能够通过贝叶斯计算从静态到转换和新颖的感觉输入进行概括,这可以使此类电路对显着的输入失真具有鲁棒性。我们将赫布短期可塑性确定为这种理论和实践最优性的关键机制。这表明从神经元的低级生物物理学到高级皮层功能之间存在以前未探索的联系,并揭示了STP的新功能作用。此外,我们首次在实践中表明,仅使用尖峰和局部无监督可塑性,皮质建模网络的性能在特定任务中可以超过通常强大的传统ANN。

除了其生物学意义之外,该算法还是一种新的神经形态ML方法,用于对动态环境进行建模。

结合我们在此强调的具有连续和随机动力学的环境的理论问题设置,它提出了神经形态计算最能解决的一类应用。此外,我们严格的证明形式化并验证了神经形态学界的普遍观点,即神经形态计算最适用于自然动力学问题。重要的是,我们的神经形态方法不同于目前占主导地位的神经AI深度学习技术。弹性聚类和ST?STDP通过在线适应临时本地信息来运行,而不是在单独的先前阶段使用包罗万象的数据集进行的通常的全局训练。这在一定程度上规避了深度学习的一个臭名昭著的局限性,即其有效性受到训练集的广度和规模的限制。这在我们的实验中得到了证明,SNN只对静态和未转换的图像进行训练,仅在一个epoch内,并且使用较少的示例。此外,SNN的训练阶段不仅时间短,而且不包含视觉动态的示例。这些定性优势,即强泛化、使用局部学习规则学习且无监督、依赖较小的训练数据集、事件驱动和在线自适应,长期以来一直是神经形态计算的主要目标之一,也是传统人工智能和机器学习研究的重点。在这里,我们证明至少在某些情况下,这些长期存在的神经形态目标实际上是同时实现的,而且不会牺牲准确性。

我们必须注意,此处未使用的广泛的深度学习技术可以提高ANN在此任务上的性能,因此它们最终可以胜过该SNN,假设也没有对SNN添加任何改进。我们工作的另一个局限性是任务选择的细节被定制成难以用传统的ANN方案解决。

一方面,这种特殊性提供了一个具体有益的神经形态计算应用程序,神经形态研究人员对这些应用程序的示例有很高的需求。另一方面,它再次证实,有必要进一步研究生物学上合理的AI方法,以扩大其适用性。然而,如此简单且生物学上合理的网络能够在如此苛刻的任务中挑战人工神经网络,这是非常了不起的。这是第一个演示,其中监督、非本地学习、时间序列训练和包括被遮挡的示例、非尖峰神经激活、更大的训练集、多个训练时期和神经元层、CNN的卷积以及门控机制LSTM并不足以立即大大优于具有STDP和纯神经形态特性的简单尖峰电路,它甚至没有在实际测试的OMNIST任务上进行训练,而是在标准MNIST图像上进行训练。这个令人惊讶的结果是由于输入变化的随机性。随机动力学在自然界中很常见,并以实验中使用的输入序列为例即使应用了有监督的反向传播,也无法以离线方式从示例序列中学习,但可以通过在线自适应性捕获。

对OMNIST等任务的传统ML技术的改进不仅在假设上是可能的,而且实际上我们的理论推导也表明了这一点。我们的理论表明,添加到传统算法以在具有随机连续动态的环境中实现最佳性能的机制是HebbianSTP本身。具体来说,虽然我们在这里关注生物学上合理的理论和实现,但在ML系统中,在线无监督弹性聚类的优势也可以与反向传播训练的深度SNN或ANN相结合。当然,STP和ST?STDP通常只与尖峰活动相关。尽管如此,我们的理论确实规定了一种HebbianSTP替代方案,它可以在没有尖峰的情况下实现神经弹性聚类。此外,弹性神经元的初始位置和静止位置(图2a)不必通过STDP以生物学上合理的方式学习,并且该理论并不排除弹性神经元来自深层网络的隐藏层。在这种情况下,可以使用通过反向传播对深度神经网络进行监督训练来获得网络的初始状态,而在推理过程中可以将无监督和类似于局部ST?STDP的神经形态方案添加到网络层中,因为?在随机但连续转换的环境中适应动态数据。这可能会改善网络的性能,增加其生物学相关性,并将神经形态概念实际整合到ANN中。这种方法可能有助于神经网络从静态训练设置泛化到动态环境,例如从图像到视频,从简短的音频片段到鸡尾酒会听觉设置中的录音,从单个键入的句子到更长的演变文本等。这些很容易实现的后续步骤可以将ST?STDP和弹性集群的优势应用于比第一个演示的应用程序更大的AI问题

这是故意受到生物学合理性的限制。因此,本文的一个成果是从理论上将STP(一种典型的SNN机制)引入具有非尖峰激活的网络和作为弹性聚类算法的传统ML。

因此,即使该SNN在OMNIST上的性能最终可能会被监督深度神经网络超越,SNN领域的机制对于皮层电路和AI的重要性仍然是一个关键信息。

与ML相反,可能不存在与反向传播的全局监督训练的生物类似物。因此,类似于神经弹性聚类的适应性,结合自然感觉输入的时间连续性,可能在使中枢神经系统即使在仅存在无监督和突触局部学习的情况下也能稳健地执行方面发挥积极作用,如我们的数学模型和模拟。

总而言之,这里报告的结果源于对生物物理学与世界时空结构和因果结构之间类比的系统识别。我们建议将此作为一种策略,可以揭示更多针对其环境优化大脑的原则。

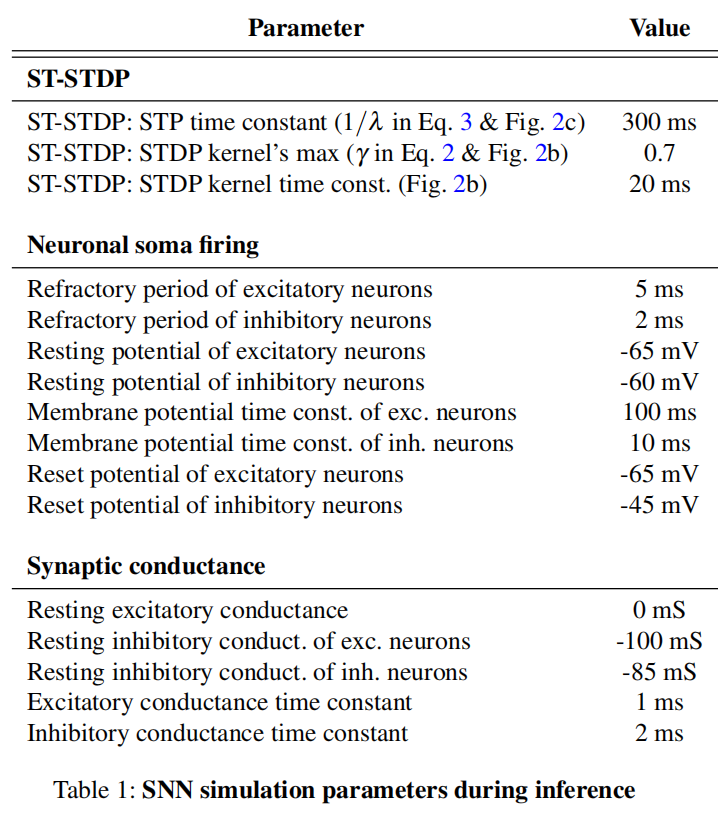

具体方法部分请参考原论文

完整论文请阅读原文