使用Python实现强化学习算法

当谈论强化学习时,我们在讨论一种机器学习方法,其目标是教会智能体(agent)在与环境的交互中学习最优的行为策略,以最大化累积奖励。在本文中,我们将介绍强化学习的基本概念,并使用 Python 和 OpenAI 的 Gym 库来实现一个简单的强化学习算法:Q-learning。

1. 什么是强化学习?

强化学习是一种机器学习范式,其中智能体通过与环境的交互学习最佳行为策略。它与监督学习不同,因为它不依赖于标记的数据,而是通过试错和奖励来学习。在强化学习中,智能体采取行动并观察环境的反馈,然后根据反馈调整其行为,以最大化长期奖励。

2. Q-learning 算法简介

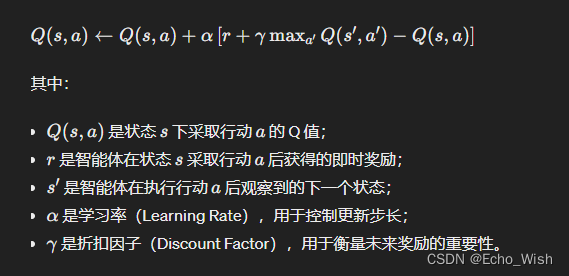

Q-learning 是一种基于值的强化学习算法,用于学习行动价值函数(Action-Value Function),即 Q 函数。该函数衡量在给定状态下采取特定行动的预期回报。

Q-learning 的基本原理是通过不断更新 Q 函数来学习最优策略。具体而言,Q-learning 使用贝尔曼方程(Bellman Equation)来更新 Q 值:

3. 使用 Python 和 Gym 实现 Q-learning

现在让我们使用 Python 和 OpenAI 的 Gym 库来实现一个简单的 Q-learning 算法,以解决 OpenAI Gym 中的经典问题:CartPole。

3.1 安装 Gym

首先,我们需要安装 Gym 库:

pip install gym3.2 实现 Q-learning 算法

接下来,我们将实现 Q-learning 算法来解决 CartPole 问题。

import gym

import numpy as np

# 创建 CartPole 环境

env = gym.make('CartPole-v1')

# 初始化 Q 表

num_states = env.observation_space.shape[0]

num_actions = env.action_space.n

Q = np.zeros((num_states, num_actions))

# 设置超参数

alpha = 0.1 # 学习率

gamma = 0.99 # 折扣因子

epsilon = 0.1 # 探索率

# 定义 Q-learning 函数

def q_learning(env, num_episodes):

for episode in range(num_episodes):

state = env.reset()

done = False

while not done:

# 选择行动

if np.random.rand() < epsilon:

action = env.action_space.sample() # 随机探索

else:

action = np.argmax(Q[state, :]) # 根据 Q 表选择最佳行动

# 执行行动并观察结果

next_state, reward, done, _ = env.step(action)

# 更新 Q 值

Q[state, action] += alpha * (reward + gamma * np.max(Q[next_state, :]) - Q[state, action])

# 更新状态

state = next_state

# 输出每个回合的奖励

print(f"Episode {episode + 1}: Total Reward = {reward}")

return Q

# 运行 Q-learning 算法

trained_Q = q_learning(env, num_episodes=1000)

# 输出训练后的 Q 表

print("Trained Q-table:")

print(trained_Q)在上述代码中,我们首先创建了 CartPole 环境,并初始化了 Q 表。然后,我们定义了 Q-learning 函数,通过与环境的交互来更新 Q 表。最后,我们运行 Q-learning 算法并输出训练后的 Q 表。

4. 总结

在本文中,我们介绍了强化学习的基本概念和 Q-learning 算法,并使用 Python 和 OpenAI Gym 库实现了一个简单的 Q-learning 算法来解决 CartPole 问题。希望这篇教程能够帮助你理解强化学习的工作原理和实现方法!