微软 | WizardLM-2被紧急撤回,有内幕?

微软 | WizardLM-2被紧急撤回,有内幕?

更多干货,第一时间送达

|未来几天,请务必尽情享受劳动者的快乐!?

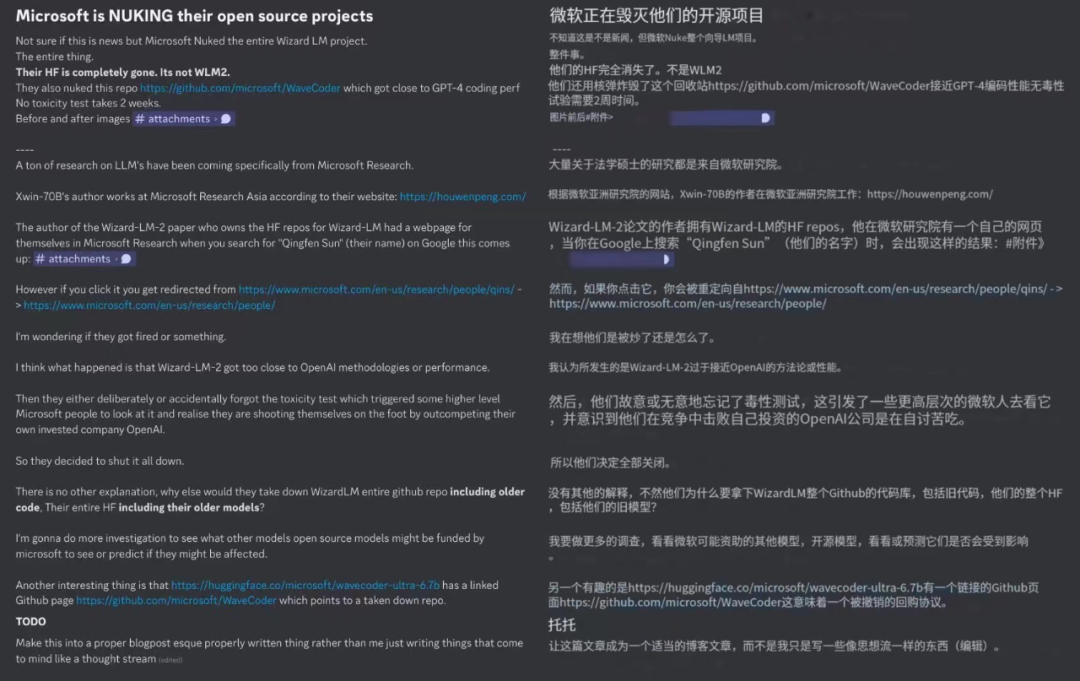

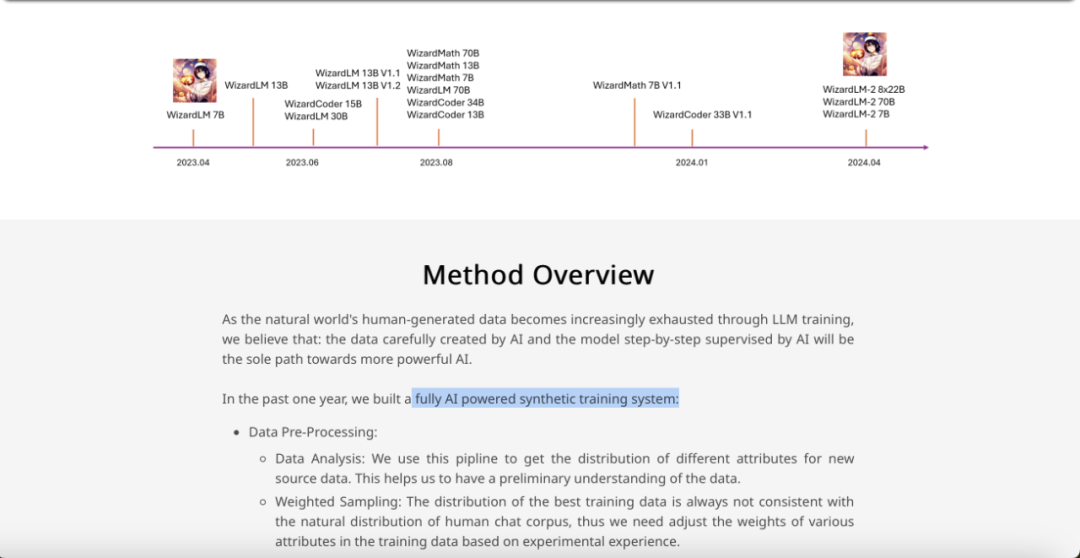

前段时间,微软搞了个乌龙:隆重地开源了 WizardLM-2,又在不久后撤回得干干净净。

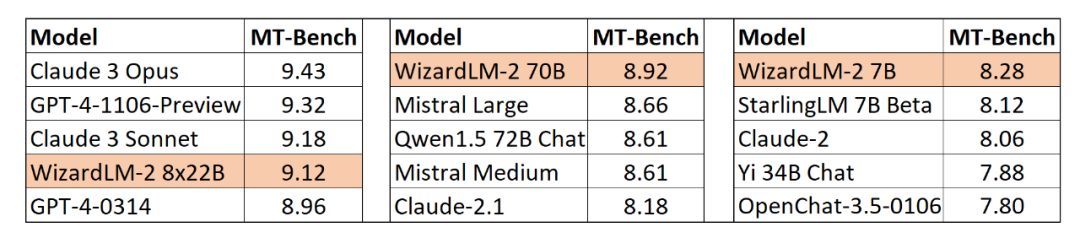

据现在可以查到的 WizardLM-2 发布信息,这是一个「真正媲美 GPT-4」的开源大模型,在复杂聊天、多语言、推理和代理方面的性能得到了提高。

该系列包括三个模型:WizardLM-2 8x22B、WizardLM-2 70B 和 WizardLM-2 7B。其中:

- WizardLM-2 8x22B 是最先进的模型,也是对高度复杂任务进行内部评估后得出的最佳开源 LLM。

- WizardLM-2 70B 具备顶级推理能力,是同等规模的首选;

- WizardLM-2 7B 是速度最快的,其性能可与现有的 10 倍大的开源领先模型相媲美。

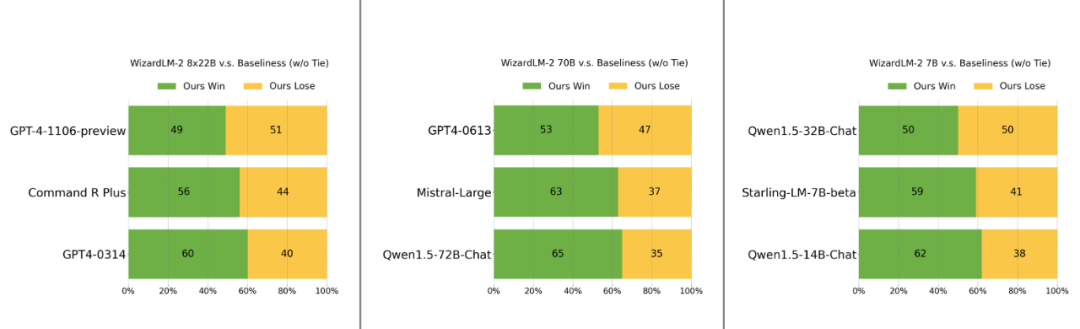

此外,通过人类偏好评估,WizardLM-28x22B 的能力「只是稍微落后于 GPT-4-1106 预览版,但明显强于 CommandRPlus 和 GPT4-0314。」

它会和 LLaMa 3 一样,成为又一开源里程碑吗?

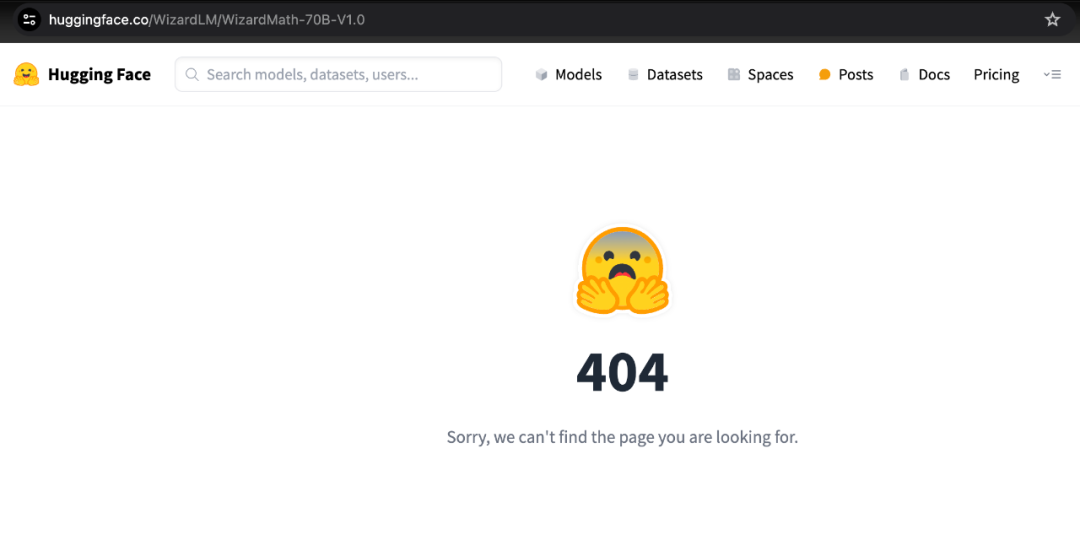

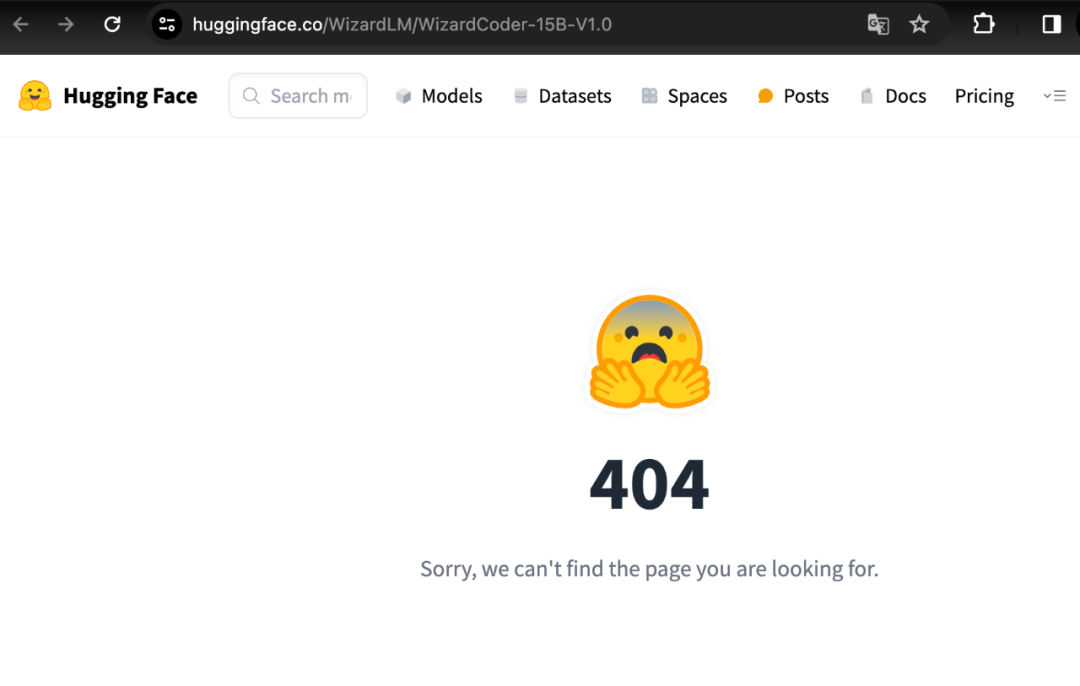

当大家忙着下载模型的时候,团队却突然撤回了一切:博客、GitHub、HuggingFace 全部 404。

图源:https://wizardlm.github.io/WizardLM2/

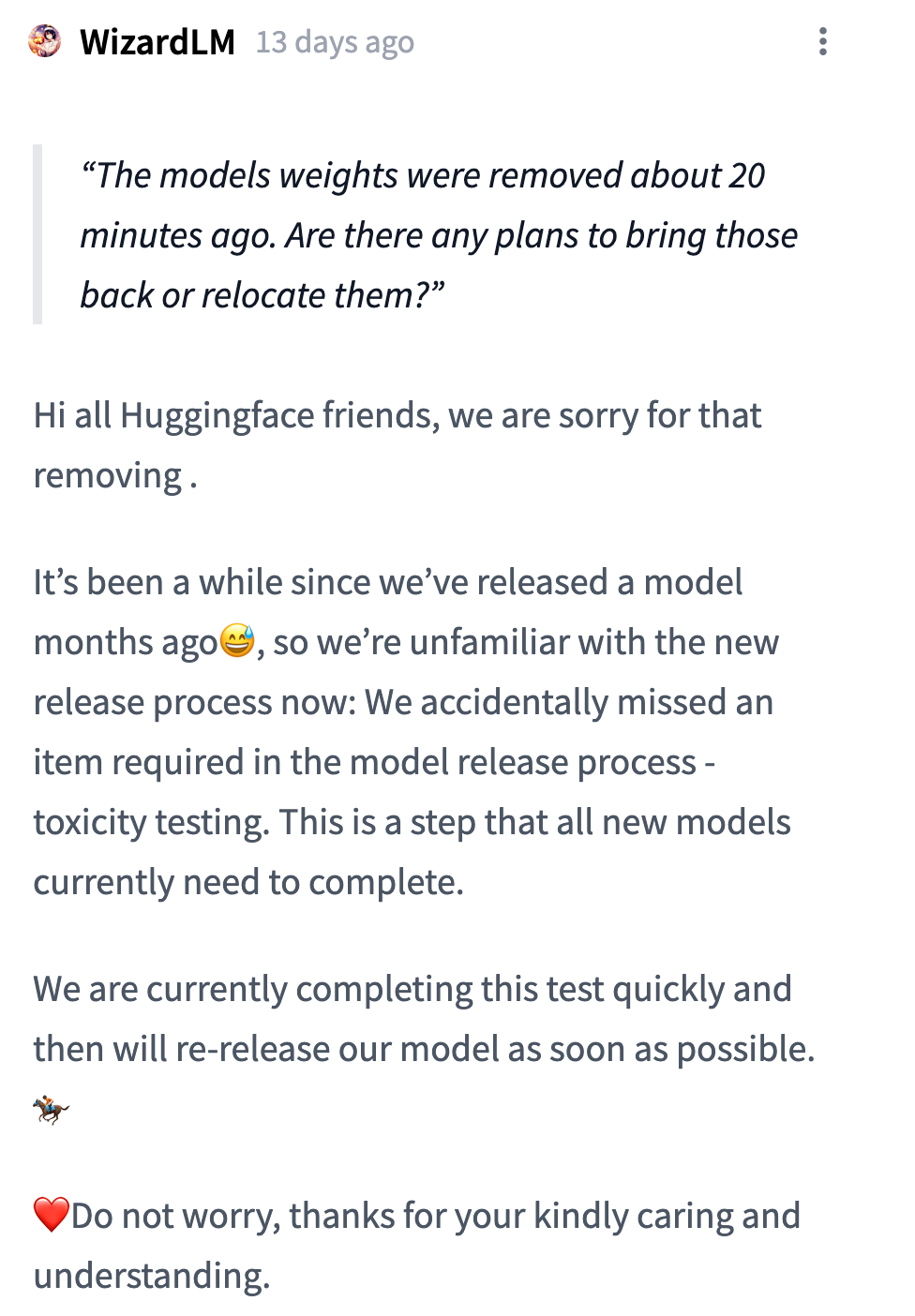

团队的解释是:

所有 Huggingface 的朋友们,大家好!很抱歉,我们删除了模型。我们已经有一段时间没有发布几个月前的模型了,所以我们现在不熟悉新的发布流程:我们不小心遗漏了模型发布流程中的一个必要项目 — 毒性测试。这是目前所有新模型都需要完成的一个步骤。 我们目前正在快速完成这项测试,然后将尽快重新发布我们的模型。不用担心,感谢关心和理解。

但 AI 社区对 WizardLM-2 的关注和讨论没有停止,疑点有几个:

第一,被删掉的开源项目不只是 WizardLM-2,该团队所有的 Wizard 系列工作都不见了,包括此前的 WizardMath 和 WizardCoder。

第二,有人质疑,删除模型权重的同时,为何连博客也删除呢?如果是只是缺少测试部分,没必要撤回得干干净净。

团队的解释是:「根据相关规定。」具体什么规定?目前没人知道。

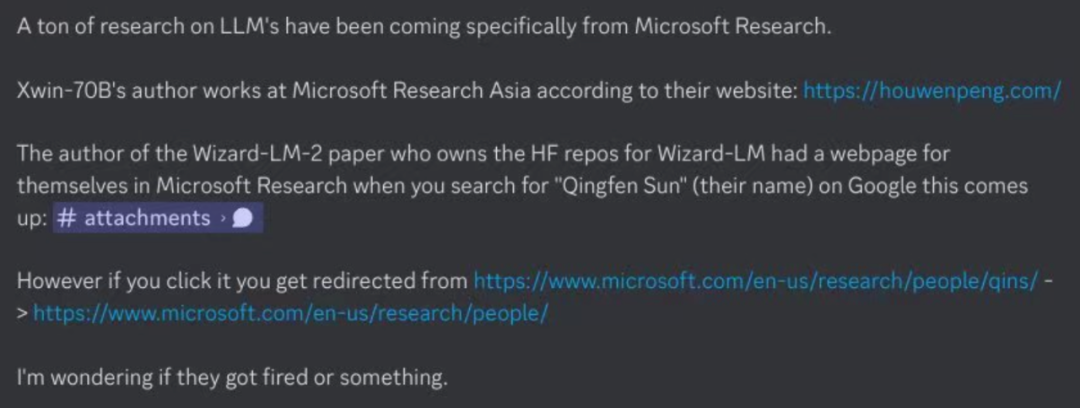

第三,还有人猜测 WizardLM 背后的团队已经被解雇,撤回 Wizard 系列项目也是被迫的。

不过,这种猜测被团队否认了:

图源:https://x.com/_Mira___Mira_/status/1783716276944486751

图源:https://x.com/DavidFSWD/status/1783682898786152470

而且我们现在搜索作者的名字,也并没有从微软官网中完全消失:

图源:https://www.microsoft.com/en-us/research/people/qins/

第四,有人猜测,微软撤回这个开源模型,一是因为性能过于接近 GPT-4,二是因为和 OpenAI 的技术路线「撞车」了。

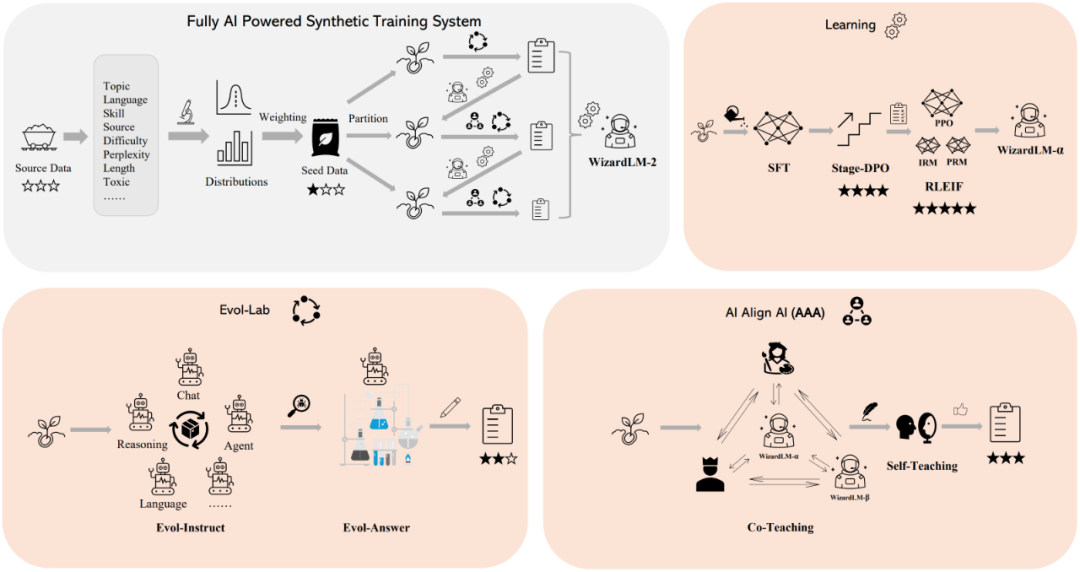

具体是什么路线呢?我们可以看一下当初博客页面的技术细节。

团队表示,通过 LLM 训练,自然界中人类生成的数据日益枯竭,而 AI 精心创建的数据和 AI Step-by-Step 监督的模型将是通往更强大 AI 的唯一途径。

过去的一年里,微软团队建立了一个完全由人工智能驱动的合成训练系统,如下图所示。

大概分为几个版块:

数据预处理:

- 数据分析:使用这个 pipeline 来获得新源数据的不同属性的分布,这有助于对数据有一个初步的了解。

- 加权采样:最佳训练数据的分布往往与人类聊天语料的自然分布不一致,需要根据实验经验调整训练数据中各属性的权重。

Evol Lab:

- Evol-Instruct:投入了大量精力重新评估了最初 Evol-Instruct 方法中存在的各种问题,并对其进行了初步修改,新方法能让各种智能体自动生成高质量的指令。

- Evol-Answer:引导模型多次生成和重写回复,可以提高其逻辑性、正确性和亲和力。

AI Align AI(AAA):

- 协同教学:收集 WizardLM 和各种授权开源和专有的最先进模型,然后让它们协同教学并相互提高,教学内容包括模拟聊天、质量评判、改进建议和缩小技能差距等。

- Self-Teaching:WizardLM 可以通过激活学习,为监督学习生成新的进化训练数据,为强化学习生成偏好数据。

学习:

- 监督学习。

- 阶段 - DPO:为了更有效地进行离线强化学习,将优选数据分割成不同的片段,并逐级改进模型。

- RLEIF:采用指令质量奖励模型(IRM)与过程监督奖励模型(PRM)相结合的方法,使得在线强化学习中实现更精确的正确性。

最后要说的是,任何猜测都是徒劳的,让我们期待一下 WizardLM-2 的复出吧。