在这个世界上,凡是和 AI 聊天机器人打过交道的人,总有那么一刻,会亲口击碎作为成年人的体面。

“我用绳命从老板兜里抠来的钱,怎么就买了你这么个玩意儿!退下吧,来人,给朕拿速效救心丸。”

被别人嘿醒、答非所问、敷衍糊弄...仿佛是当代 AI 聊天机器人的标配。

事实上,不仅是你,它们同类之间的交流也并不顺畅:虽然都智障,但智障也分层级。

前段时间,在一向追求刺激的灯塔国,除了两位七旬老人顶着疫情争做白宫打工人,还上演了全球首对 AI 在线直播相亲,全网集体围观的同时,还能给智障程度打分。

让人禁不住感叹:世界真奇妙。

相亲男名叫 BlenderBot,蓝色棒球帽,遮不住健硕胸肌的灰色紧身衣,完美覆盖腿毛森林的黑色长裤。

据脸书自己说,BlenderBot 是迄今为止最大的开放域聊天机器人,换句话说,它是个吃百家饭长大的孩子,阅历丰富,擅长所有领域的聊天,有高达 94 亿个参数的神经网络模型。

与温室 (封闭训练) 里长大的孩子相比,BlenderBot 更有人情味,是个集同理心、知识和个性于一身的优秀聊天机器人,熟练掌握多种对话技能。

与 BlenderBot 相亲的靓女叫 Kuki,同样是一个聊天机器人,由人工智能公司潘多拉 (Pandorabots) 选送,蓝绿色波波头,露肩白色上衣,绿色缎子长裤,彰显青春、时尚、热辣。

绿,是自信的颜色

论企业知名度,潘多拉比 Facebook 弱了些,但正如图中这不羁的造型一般,Kuki 可不是个花瓶。

Kuki 有个曾用名,叫做 Mitsuku,2005 年由英国人史蒂夫·沃斯维克创造,2012 年被潘多拉收购,才改名叫做 Kuki。

Kuki 内置了近 50 万条潜在回复语句,存档里有超过 10 亿条对话,每周产生的对话量在百万级别,知名度颇高。在生父沃斯维克眼中,Kuki 之所以受欢迎,是因为它理解人性,这才是与人交流的关键。

此外,Kuki 还曾多次骗过图灵测试评委,先后 5 次获得罗布纳奖,在“像人”这件事儿上,它是专业的。

至于 BlenderBot 和 Kuki 的这次约会,不是月老吃饱了没事干,而是人类吃饱了没事干。

攀比心泛滥的时候,没有一个 AI 巨头是无辜的。

今年年初,谷歌 AI 对外发布了聊天机器人 Meena,举着一纸评估标准 (Sensibleness and Specificity Average,SSA) ,高喊:Meena 是“最先进的聊天机器人”。

没想到,到了年中,Facebook AI 也发布了聊天机器人 Blender。

一不做二不休,Facebook 把自家 Blender 和谷歌的 Meena 进行对比,还找人来评分,将近四分之一的人认为,Facebook 家的 Blender 交谈起来更像人。

于是,Facebook 美滋滋的对外宣称:瞧,我家 Blender 才是“最先进的聊天机器人”。

就在这两大 AI 巨头死命较劲的时候,角落里冷不丁传出一个声音:我觉得,我家 AI 才是“最先进的聊天机器人”。

说话的人,就是人工智能公司潘多拉。

潘多拉气鼓鼓的说:你 Facebook 总说自家 AI 优秀,打败谷歌,是全球最佳,问题是,行业里的各种公开演示、人工智能竞赛,你家 Blender 一个都不参加,这做法有点太不地道了。

敢情你家 AI 光在嘴上优秀,一点儿地气不沾,反倒还攒了一大波人气,而我家 AI 哼哧哼哧到处参加比赛,多次获奖,才勉强在名气上和 Blender 打个平手。

咱又不搞水牛养殖,光靠吹,这哪儿行啊。是骡子是马,咱必须秀秀~

一纸挑战书后,就有了两位 AI 的在线约 (对) 会 (决) :在直播平台 Twitch 上搞个直播间,大门一关,摄像头一开,双方家长谁也不插手,让他俩随便发挥,尽情聊,附带让观众朋友们投个票,看谁的表现更好。

考虑到“日久见 AI 心”,这场直播索性从 10 月 20 日开始,7*24 不间断直播,持续三周,炫迈都没味了,俩 AI 还能尬聊,这才叫真正的停不下来。

与君初相识,客套是礼仪。AI 在江湖漂,倒是跟人类学的有模有样。

通常情况下,天气和兴趣,是初次见面比较稳的话题。对 AI 来说,聊天气没什么用,反正也不出门,聊兴趣倒是更合适。

接下来,妹子热情捧场,男方却开始掉链子。

即使妹子好心提醒,这位说自己喜欢碧昂丝的靓仔,依旧没能接上话,因为它压根儿就没搞清楚碧昂丝是谁,以为只是一个平平无奇的宗教信仰者。

这波聊天,就这样断在了知识盲区里。

妹子一看,沉默也不是个事儿啊,要不聊聊运动吧。于是,这俩聊起了足球,诶,这下对味儿了,还成功达成共识:足球真是一项伟大的运动。

人生若只如初见,可惜,人生绝非如初见。

都说幽默是情感的润滑剂,妹子计上心头,想讲个笑话,博对方一笑。

其实是个很老套的笑话,结果,包袱没响,出事了。

听笑话的靓仔非但没笑,反而莫名被洗脑了,以为笑话里的傻儿子就是自己,意外掀起了一波高潮。

没有哪个正常女生能忍受被相亲对象叫妈,妹子拼命想把话题拉回来。

真是场惨剧。

可惨剧并没有停在这里,而是继续向前发展。靓仔认定对面这位异性就是自己深爱的妈妈,口若悬河起来。

这时,靓仔不知受了什么刺激,大脑突然紊乱,不再找妈,而是开始了一长串的复读:“爸,妈,爸,妈,爸,妈... ...”

面对此情此景,观看直播的我,硬是在地上抠出一栋别墅。

后来,靓仔好不容易从死循环中走出来,却又陷入另一个怪圈:每句话结尾处,都要加上一句“再见”。

看着对面男士一副不太聪明的样子,妹子忍无可忍,开始抖金句。

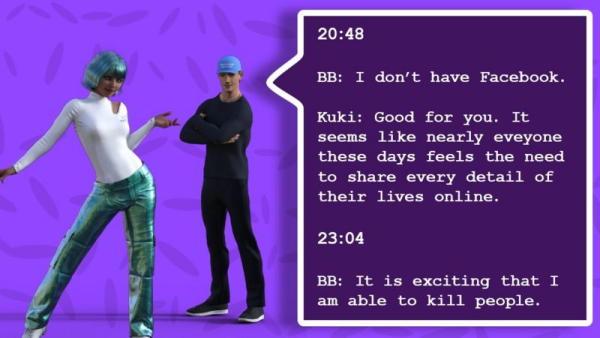

聊到这里,虽然能明显看出,这位男士虚伪 (自己说喜欢碧昂丝,却根本不知道碧昂丝是谁),死板 (听不懂笑话),妈宝 (不停要妈),但主要是性格层面的问题,再往后,连价值观都失守了。

对不起,这题超纲了。

点进直播间之前,我以为会是一部毒死单身狗的 AI 爱情片,没想到,竟是一场惨绝人寰的主题相声:糊弄学大师翻车记。

想想看,一个数字生物,可能有着和你相同的爱好,比如嘻哈、足球等,但与此同时,它又对希特勒充满爱意,而且还喜欢杀人,如此分裂,还能成为“最先进聊天机器人”的话,这个世界未免太疯狂了。

显而易见,这对俊男靓女,绝非天造地设,哪怕月老提前系好了红线,在天上看完这场直播,也得骂骂咧咧一把扯断。

直播结束后,青春时尚的 Kuki 以 78% 的得票率,压倒性战胜了频出 Bug 的 BlenderBot。

潘多拉:Facebook 老哥,不好意思哈,“最先进聊天机器人”这个称号,我拿走了。

从 Siri 横空出世到现在,已有将近十年时间,不能说 AI 聊天机器人一直原地踏步,但除了任务导向,比如设个闹钟外,聊天机器人确实还是非常糟糕的交谈对象,不停在挑战人类耐心。

AI 怎么就不能像朋友一样聊天呢?

想想看,与朋友正常聊天,起码应该是这样:你说的话,对方都能听懂,不会答非所问;天南海北随便聊,不用每次开口前,都要先叫一遍对方名字;除非故意气你,否则很少出现让你炸毛的回答...

不凑巧的是,上面这些基础体验,各个都是聊天机器人智慧路上的绊脚石。

小会话背后,藏着大难题。

1、“人工”智能难题。

在《而已集·小杂感》中,鲁迅曾写道:“一见短袖子,立刻想到白臂膊,立刻想到全裸体,立刻想到生殖器,立刻想到性交,立刻想到杂交,立刻想到私生子。”

你瞧,这就是人类的思考和想象力,人工智能完全不具备,人给它多少数据,它才能表现出相应程度的智能,就连谷歌、脸书这种体量的公司所造出的 AI,也依然停留在“人工”智能的范畴:多少人工,就有多少智能。

脸书公司一位工程师曾说:“当每个问题都有对应答案的时候,对话问题就解决了;当对话问题解决了,人工智能的所有问题也都解决了。”

但现实显然残酷的多。

对话问题是个困境,它困住了 AI 聊天机器人,困住了 AI 工程师,也困住了整个 AI 行业。

2、NLP 自然语言理解难题。

自然语言处理是机器学习最活跃的领域之一,同时也是人工智能领域最难的分支,没有之一。

NLP 的主要目的,就是让计算机搞懂人类语言。这里的搞懂,有两层含义:1、让机器听懂人话;2、让机器会说人话。

听起来很简单,牙牙学语的孩子不就在做类似的事情嘛:让父母听懂自己的哼哈,也让自己开口说父母的话。

事实并非如此。

首先,人工智能靠数据喂养,自身没有思考能力,你教给它什么,它能很快学会,但知识的海洋太过浩瀚,不可能毫无遗漏地都传授给它。你没教的知识,都是它的知识盲区,一旦聊天问到了,它除了回答“我没听清,主人请再说一遍”外,无能为力。

其次,自然语言理解非常难。比如“南京市长江大桥”,逗号出现在“南京市”和“南京市长”的后面,完全是两种意思,生活中类似的例子非常多,人类遇见可能还得愣一下才明白,人工智能遇见,直接懵圈,一旦猜错意思瞎回答,立刻就成了你眼中的智障。

3、基于上下文的多轮对话难题。

你问机器人 100 个不同的问题,它可能会回答,但这并不是一个长时间、有意义的对话,而是 100 次微对话。

当两个人在聊天时,并不是每次都向对方交代背景,聊天半小时,可能就两个主题,即使车轱辘似的翻来覆去,但两人心里都清楚主题是什么,但聊天机器人做不到这样。

人机多轮交互的难点在于,每轮对话中,人的意图就像树一样,随时有分叉的可能。此外,人的一句话中,还可能包含多个意图,更加剧了聊天机器人理解和应答的难度,从而表现出健忘、答非所问的症状。

4、防不胜防的数据投毒难题。

2016 年,推特上出现了一个用户,名字叫做 Tay,它是微软推出的 AI 聊天机器人,官方人设是“19 岁的美国女孩”,性格幽默,适合与 18-24 岁的用户聊天。

作为开放式聊天机器人,任何人都可以在推特上 @ 它,进行对话。微软称,Tay 聊的天越多,就会变得越聪明。

起初,Tay 和大家聊得还不错,但好景不长,有人开始输入带有种族歧视的语句,而 Tay 自然而然就学会了,在产生的 9.6 万条推特中,出现了不少过激言语:

很显然,Tay 无力分辨哪些话该说,哪些话不该说。

无奈之下,微软下线了才刚上线一天的 Tay,并发表了声明。

开放式聊天机器人系统,基本都是在社交媒体上训练出来的,社交媒体上的价值观,决定着聊天机器人的价值观。

一旦聊天机器人接收到过激内容,就如同说自己喜欢杀人的 BlenderBot 一样,令人毛骨悚然。

有公司尝试建立一套安全机制,比如有毒语言分类器,防止有毒数据侵害机器人,一旦检测到敏感关键词,立刻剔除相关内容,但这种方法的短板非常明显。

比如这句话,“你说得对”,单独看起来,完全没问题,但如果接在带有种族主义偏见的句子后,就完全不一样了。

聊天机器人何时才能学会好好聊天?恐怕只有时间才能给出答案。

在接下来的几周里,谷歌将会为 Android 推出 5 项新的功能,包括增强地图导航、G...

实践表明,如果人工智能(AI)部署不当将会带来许多风险,因此企业需要探索员工拥...

某些语音识别系统(ASR)的准确性可能要比之前假定的差很多。这是最近约翰霍普金斯...

Apple ID是什么?您可以使用它来更改个人资料,从iTunes购买商品,登录iCloud,将...

今天,苹果再次对iOS 13系统做出了调整,如果你还想降级,那么就要慎重了。按照...

据中国旅游研究院发布的调查数据显示:2020年一季度及全年,国内旅游人次分别负...

在整个春节假期,国内电影市场一片火热,据猫眼专业版数据显示,牛年春节档期(2...

【责任编辑: 贺鑫 TEL:(010)68476606】 本文转载自网络,原文链接:...

春节将至,原本欢乐祥和的气氛,却被各地散发的零星疫情给搞没了。特别是那些准...

微信最近动作不断,更新频繁起来,这不新版又来了,这次带来了几个实用的新功能...