MambaЙо¶ИЅвОцЈєAIДЈРНµДРВН»ЖЖ

MambaЙо¶ИЅвОцЈєAIДЈРНµДРВН»ЖЖ

јтЅй

ИЛ№¤ЦЗДЬБмУтУАґБЛТ»О»РВРЗЎЄЎЄMambaЈ¬ХвКЗТ»ЦЦ»щУЪЧґМ¬їХјдДЈРНЈЁSSMsЈ©µДРВРНAIДЈРНЈ¬ЛьЧчОЄTransformerДЈРНµДУРБ¦ѕєХщХЯЈ¬ЅвѕцБЛєуХЯФЪґ¦Ані¤РтБРКэѕЭК±µДР§ВКОКМвЎЈ

MambaДЈРНµДББµг

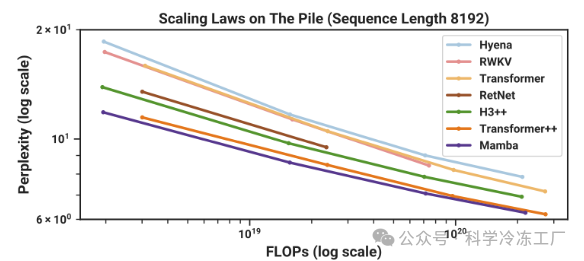

- і¤РтБРґ¦АнДЬБ¦ЈєMambaДЬ№»ґ¦Ані¤ґп°ЩНтј¶±рµДtokenРтБРЈ¬Хв¶ФУЪРиТЄі¤ЖЪјЗТдµДИООсЦБ№ШЦШТЄЎЈ

- їмЛЩНЖАнЈєMambaµДНЖАнЛЩ¶Иј«їмЈ¬±ИTransformerДЈРНїм5±¶Ј¬ХвТвО¶ЧЕЛьїЙТФФЪёь¶МµДК±јдДЪґ¦Анёь¶аµДКэѕЭЎЈ

- ПЯРФА©Х№РФЈєMambaФЪРтБРі¤¶ИЙПµДА©Х№РФКЗПЯРФµДЈ¬ХвТвО¶ЧЕЛжЧЕРтБРі¤¶ИµДФцјУЈ¬ДЈРНµДРФДЬІ»»бКЬµЅПФЦшУ°ПмЎЈ

ґ«НіTransformerДЈРНµДѕЦПЮРФ

ѕЎ№ЬTransformerДЈРНФЪAIБмУтИЎµГБЛѕЮґуіЙ№¦Ј¬µ«ЛьГЗФЪґ¦Ані¤РтБРК±ґжФЪєЛРДОКМвЎЈTransformerДЈРНЦРµДГїёцtokenФЪЅшРРФ¤ІвК±¶јїЙТФ»Ш№ЛЛщУРЦ®З°µДtokenЈ¬ХвµјЦВБЛСµБ·К±µДК±јдёґФУ¶ИОЄO(n?)Ј¬јґЛщОЅµДЎ°¶юґОЖїѕ±Ў±ЎЈґЛНвЈ¬ґжґўХвР©tokenµДјьЦµЈЁKVЈ©»єґжРиТЄO(n)µДїХјдЈ¬ЛжЧЕДЪґжХјУГµДФцјУЈ¬CUDAДЪґжІ»ЧгЈЁOOMЈ©ґнОуµД·зПХТІЛжЦ®ФцјУЎЈ

MambaДЈРНµД№¤ЧчФАн

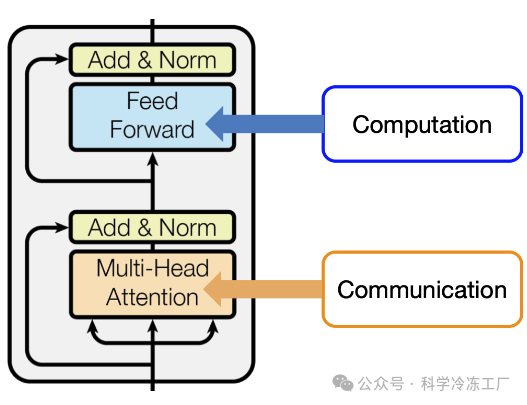

MambaДЈРНІЙУГБЛКЬїШЦЖАнВЫЖф·ўµДЧґМ¬їХјдДЈРНЈЁSSMЈ©АґМжґъґ«НіµДЧўТвБ¦»ъЦЖЈЁAttentionЈ©Ј¬Н¬К±±ЈБфБЛ¶аІгёРЦЄ»ъЈЁMLPЈ©·зёсµДН¶У°АґЅшРРјЖЛгЎЈMambaДЈРННЁ№эХвЦЦ·ЅКЅКµПЦБЛ¶ФРтБРКэѕЭµДУРР§ґ¦АнЎЈ

MambaµДУ¦УГЗ°ѕ°

MambaДЈРНФЪ¶аёц·ЅГжХ№ПЦіцБЛЧїФЅµДРФДЬЈ¬МШ±рКЗФЪРиТЄґ¦Ані¤РтБРКэѕЭµДіЎѕ°ЦРЎЈАэИзЈ¬ФЪЙъОпРЕПўС§ЦРґ¦АнDNAРтБРЈ¬ФЪКУЖµДЪИЭЙъіЙЦРґ¦Ан»тНЖАнКУЖµЈ¬ТФј°ФЪОДС§ґґЧчЦРЧ«Рґі¤ЖЄРЎЛµµИЎЈ

- їШЦЖЧЄПт

AI°ІИ«УлїЙЅвКНРФ

MambaДЈРНµДі¤РтБРјЗТдДЬБ¦ОЄAI°ІИ«ґшАґБЛРВµДїјБїЎЈУлґ«НіµДTransformerДЈРНПа±ИЈ¬MambaДЈРНФЪґ¦Ані¤ЖЪДї±кµДЦЗДЬґъАнК±їЙДЬРиТЄёь¶аµД°ІИ«ґлК©ЎЈ

ЅбУп

MambaДЈРНµДіцПЦ±кЦѕЧЕОТГЗЅшИлБЛєуTransformerК±ґъЈ¬ХвОЄРтБРЅЁДЈґшАґБЛРВµДїЙДЬРФЈ¬УИЖдКЗФЪґ¦Анј«і¤РтБРєНФЙъі¤ЖЪјЗТд·ЅГжЎЈMambaДЈРНµДОґАґ·ўХ№ЦµµГОТГЗіЦРш№ШЧўЎЈ

±ѕОД·ЦПнЧФ Ад¶і№¤і§ ОўРЕ№«ЦЪєЕЈ¬З°НщІйїґ

ИзУРЗЦИЁЈ¬ЗлБЄПµ cloudcommunity@tencent.com ЙѕіэЎЈ

±ѕОДІОУл?МЪС¶ФЖЧФГЅМе·ЦПнјЖ»®? Ј¬»¶УИИ°®РґЧчµДДгТ»ЖрІОУлЈЎ