НгЩЯЮФ ЪЕЪБДѓЪ§ОнМЦЫув§ЧцApache FlinkМЦЫубаОП(вЛ)

Ъ§ОндДВПЗж

ВЛЕЋЬсЙЉСЫСїДІРэ ЛЙЬсЙЉСЫХњДІРэ СїДІРэКЭХњДІРэЗжЪєгкВЛЭЌЕФapi

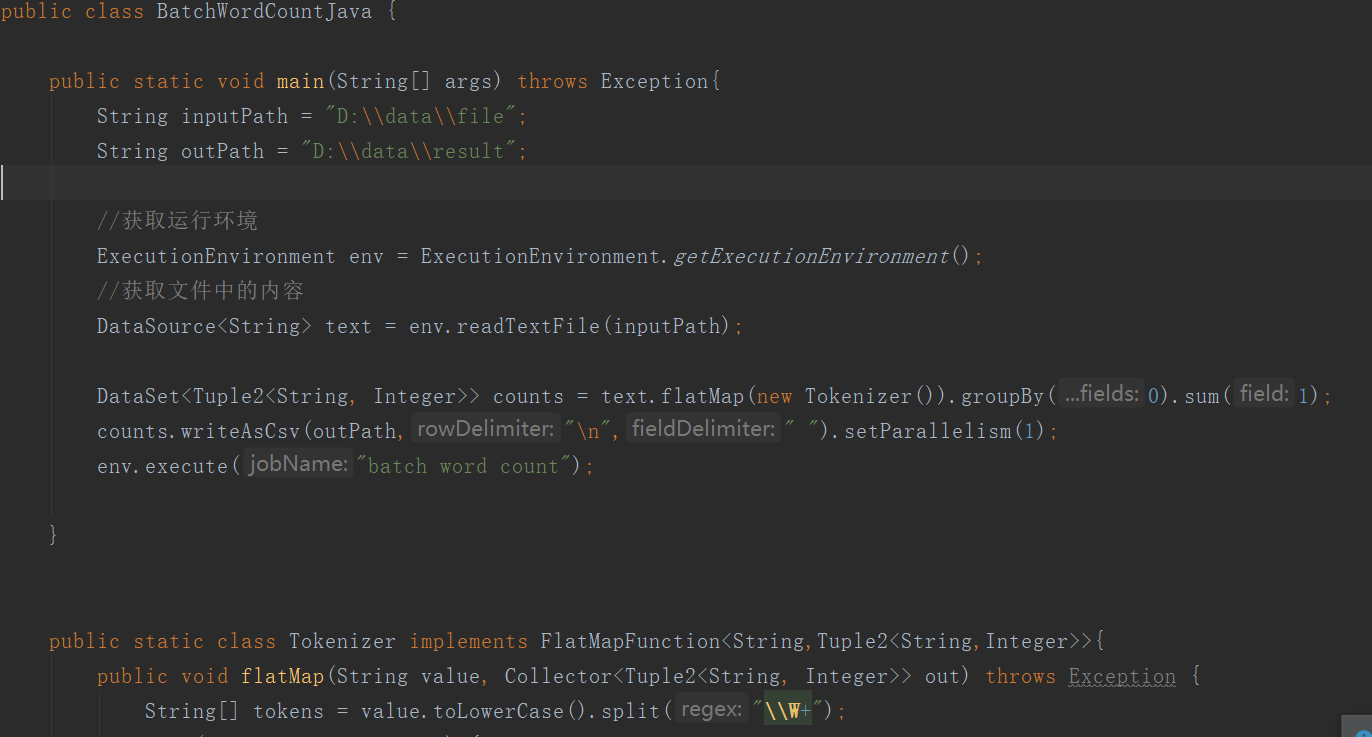

ЛљгкЮФМў

readTextFile(path)ЛљгкМЏКЯ

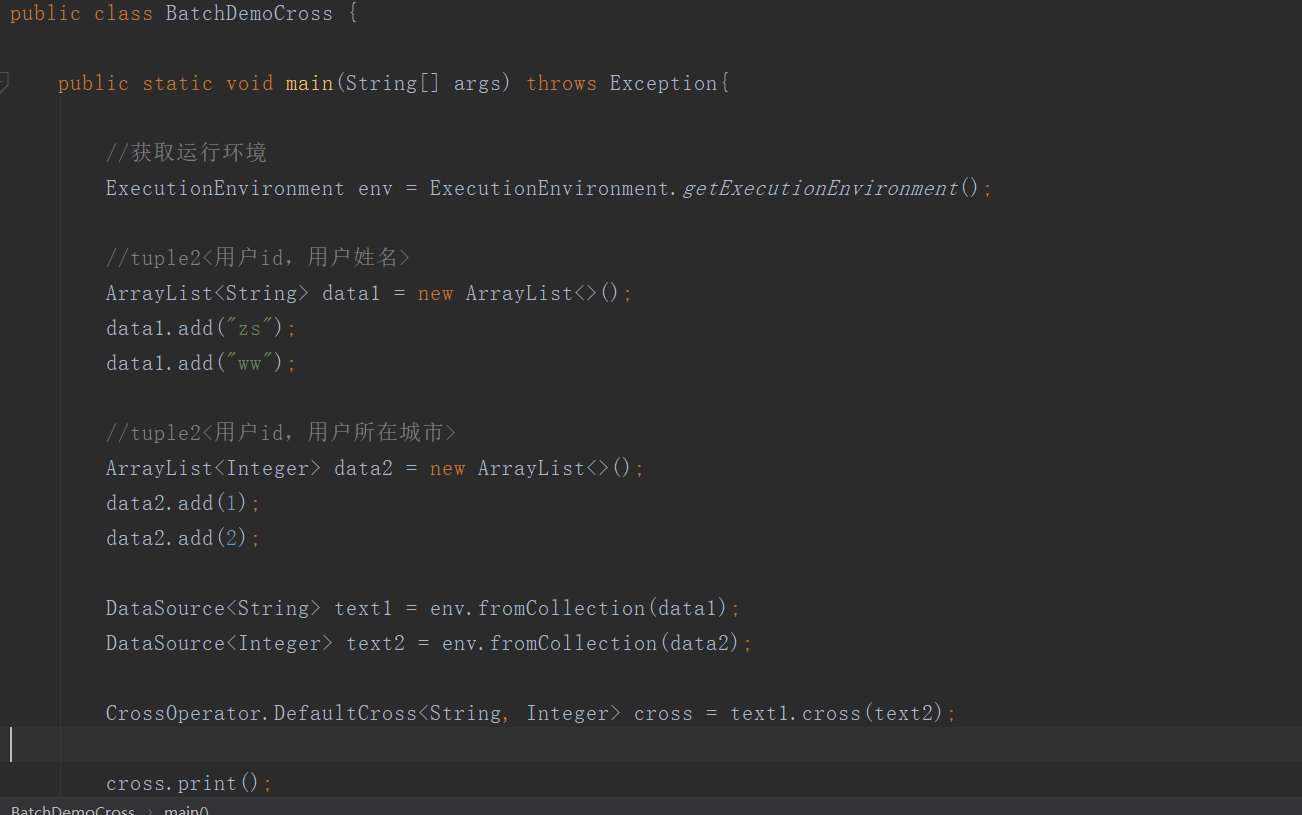

fromCollection(Collection)ЫузгВПЗж

Map ЪфШывЛИідЊЫи ШЛКѓЗЕЛивЛИідЊЫи жаМфПЩвдзівЛаЉЧхЯДзЊЛЛЕШВйзї

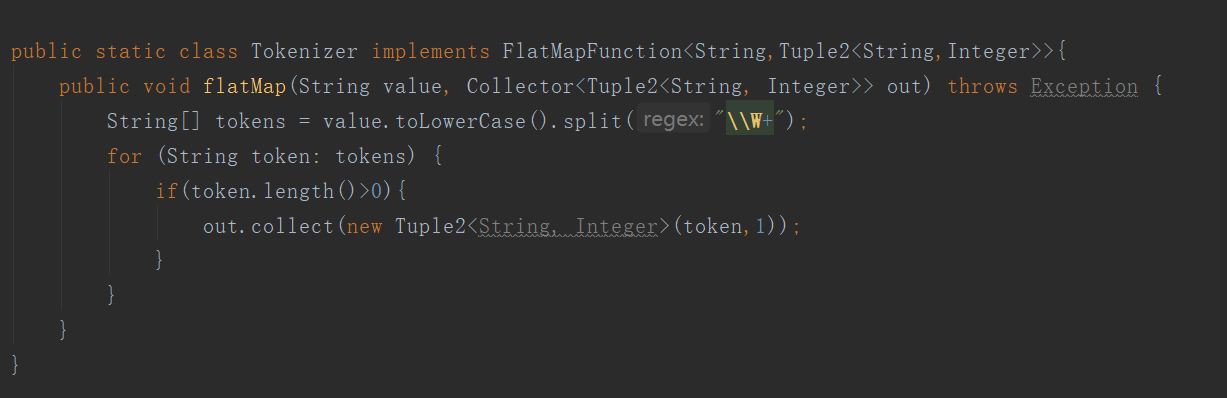

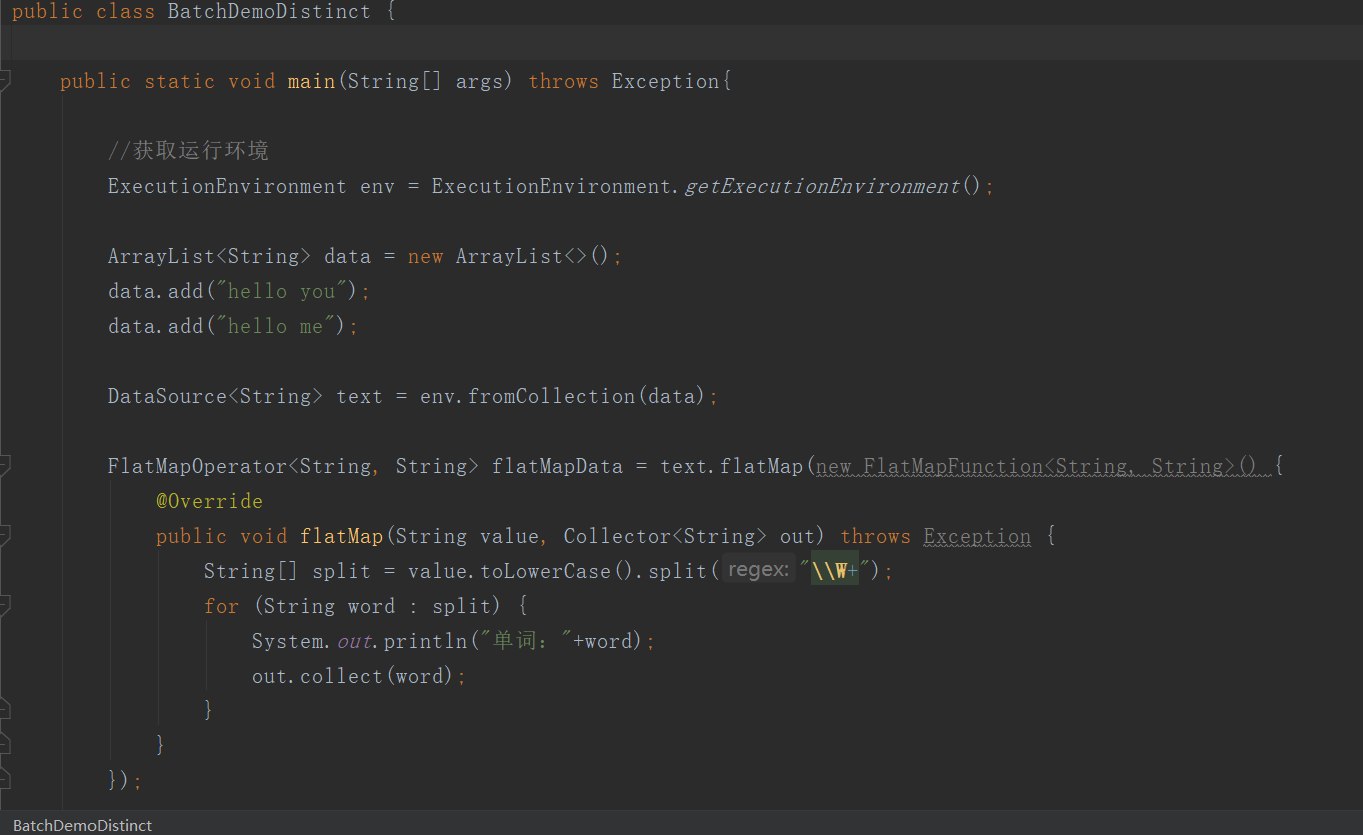

FlatMap ЪфШывЛИідЊЫи ПЩвдЗЕЛиСуИі вЛИіЛђепЖрИідЊЫи

MapPartition РрЫЦmap вЛДЮДІРэвЛИіЗжЧјЕФЪ§ОнЁОШчЙћдкНјааmapДІРэЕФЪБКђашвЊЛёШЁЕкШ§ЗНзЪдДСДНг НЈвщЪЙгУMapPartitionЁП

Filter Й§ТЫКЏЪ§ ЖдДЋШыЕФЪ§ОнНјааХаЖЯ ЗћКЯЬѕМўЕФЪ§ОнЛсБЛСєЯТ

Reduce ЖдЪ§ОнНјааОлКЯВйзї НсКЯЕБЧАдЊЫиКЭЩЯвЛДЮreduceЗЕЛиЕФжЕНјааОлКЯВйзї ШЛКѓЗЕЛивЛИіаТЕФжЕ

Aggregate sumЁЂmaxЁЂminЕШ

Distinct ЗЕЛивЛИіЪ§ОнМЏжаШЅжижЎКѓЕФдЊЫи data.distinct()

Join ФкСЌНг

OuterJoin ЭтСДНг

Cross ЛёШЁСНИіЪ§ОнМЏЕФЕбПЈЖћЛ§

Union ЗЕЛиСНИіЪ§ОнМЏЕФзмКЭ Ъ§ОнРраЭашвЊвЛжТ

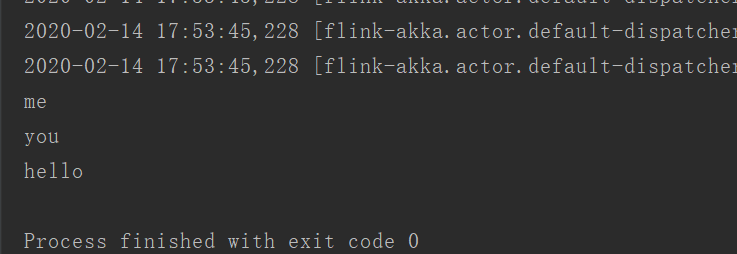

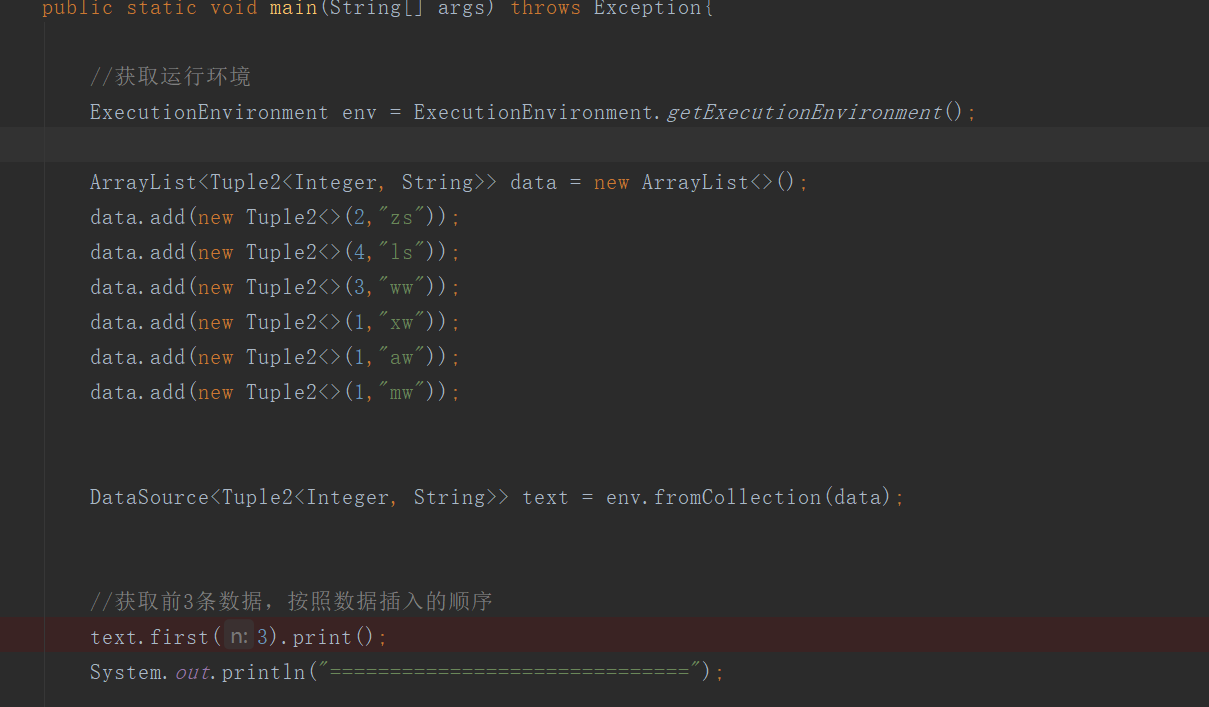

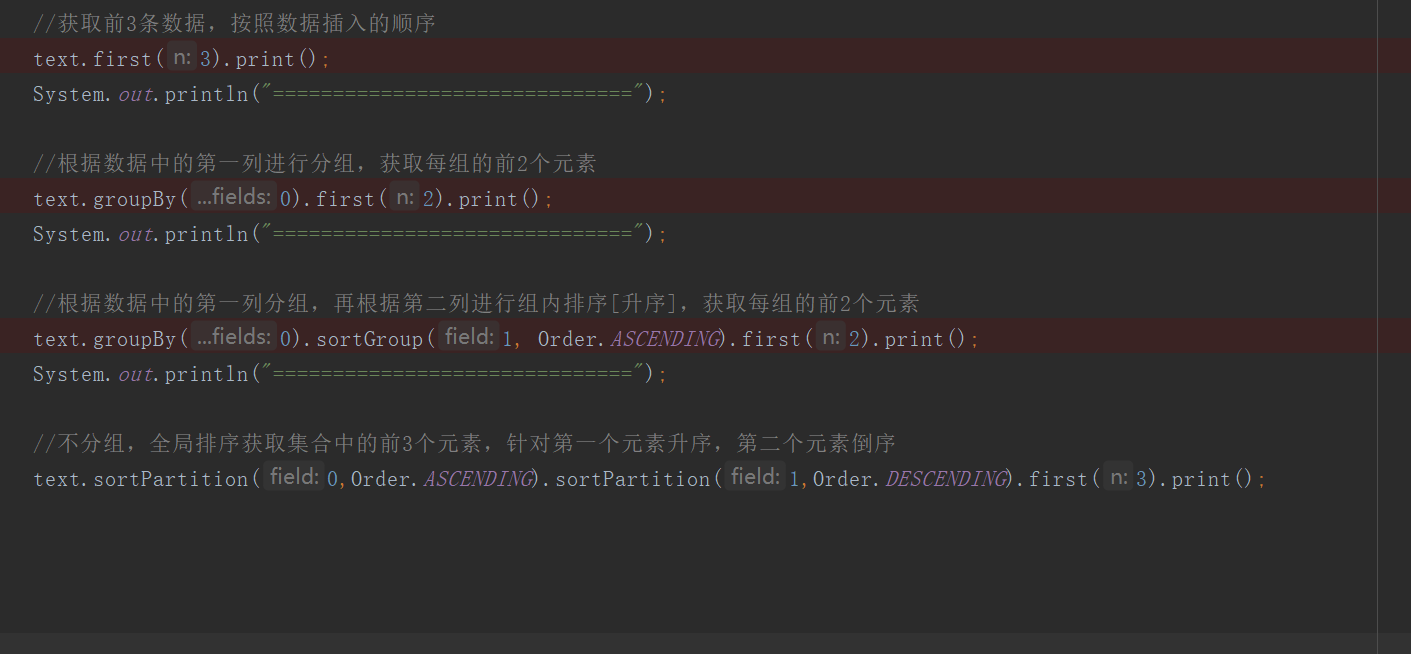

First-n ЛёШЁМЏКЯжаЕФЧАNИідЊЫи

Sort Partition дкБОЕиЖдЪ§ОнМЏЕФЫљгаЗжЧјНјааХХађ ЭЈЙ§sortPartition()ЕФСДНгЕїгУРДЭъГЩЖдЖрИізжЖЮЕФХХађ

ХњДІРэЕФЭГМЦЮФМўжаЕЅДЪЕФИіЪ§

дЫааНсЙћ

ЪфШыЮФМў

ЪфГіЮФМў

ЛёШЁЕбПЈЖћЛ§

дЫааНсЙћ

ХњДІРэШЅжи

ДІРэНсЙћ

ЛёШЁМЏКЯжаЕФЧАNИідЊЫи

дЫааНсЙћ

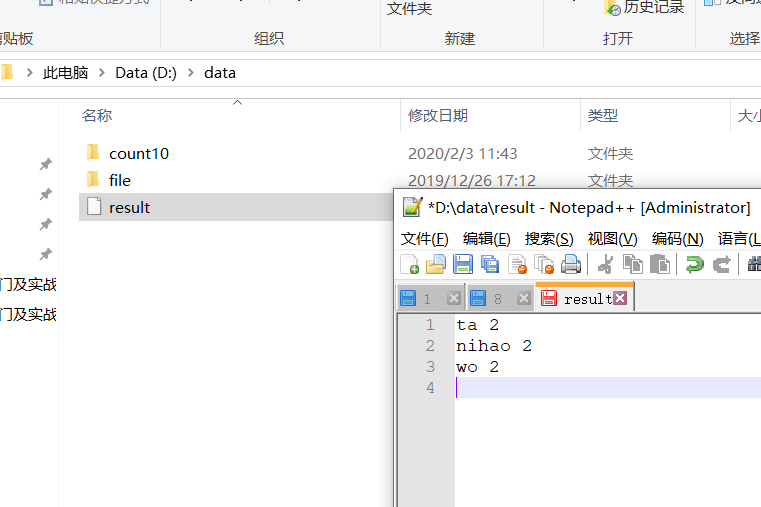

writeAsText() НЋдЊЫивдзжЗћДЎаЮЪНж№аааДШы етаЉзжЗћДЎЭЈЙ§ЕїгУУПИідЊЫиЕФtoString()ЗНЗЈРДЛёШЁ

writeAsCsv() НЋдЊзщвдЖККХЗжИєаДШыЮФМўжа ааМАзжЖЮжЎМфЕФЗжИєЪЧПЩХфжУЕФЁЃУПИізжЖЮЕФжЕРДздЖдЯѓЕФtoString()ЗНЗЈ

print() ДђгЁУПИідЊЫиЕФtoString()ЗНЗЈЕФжЕЕНБъзМЪфГіЛђепБъзМДэЮѓЪфГіСїжа

дкЧА2ИіеТНкжавбВтЪдЙ§ЦфжаЕФЗНЗЈЁЃ

1.гІгУГЁОА

АбдЊЫиЙуВЅИјЫљгаЕФЗжЧј Ъ§ОнЛсБЛжиИДДІРэ

ЙуВЅБфСПдЪаэБрГЬШЫдБдкУПЬЈЛњЦїЩЯБЃГж1ИіжЛЖСЕФЛКДцБфСП ЖјВЛЪЧДЋЫЭБфСПЕФИББОИјtasks

ЙуВЅБфСПДДНЈКѓ ЫќПЩвддЫаадкМЏШКжаЕФШЮКЮfunctionЩЯ ЖјВЛашвЊЖрДЮДЋЕнИјМЏШКНкЕуЁЃСэЭташвЊМЧзЁ ВЛгІИУаоИФЙуВЅБфСП етбљВХФмШЗБЃУПИіНкЕуЛёШЁЕНЕФжЕЖМЪЧвЛжТЕФ

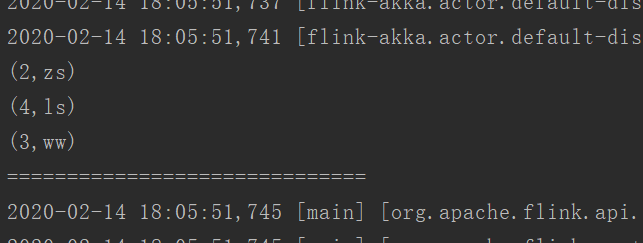

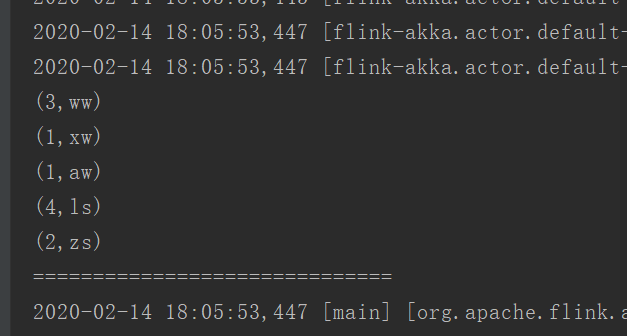

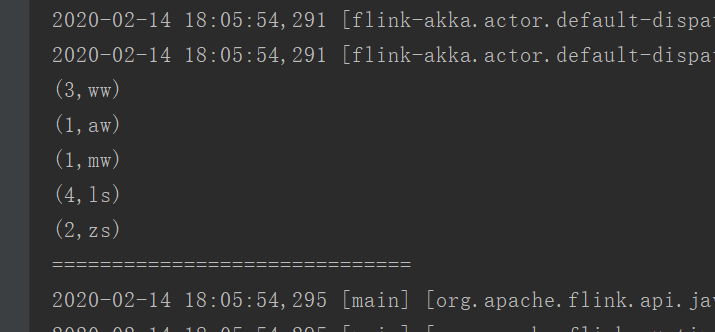

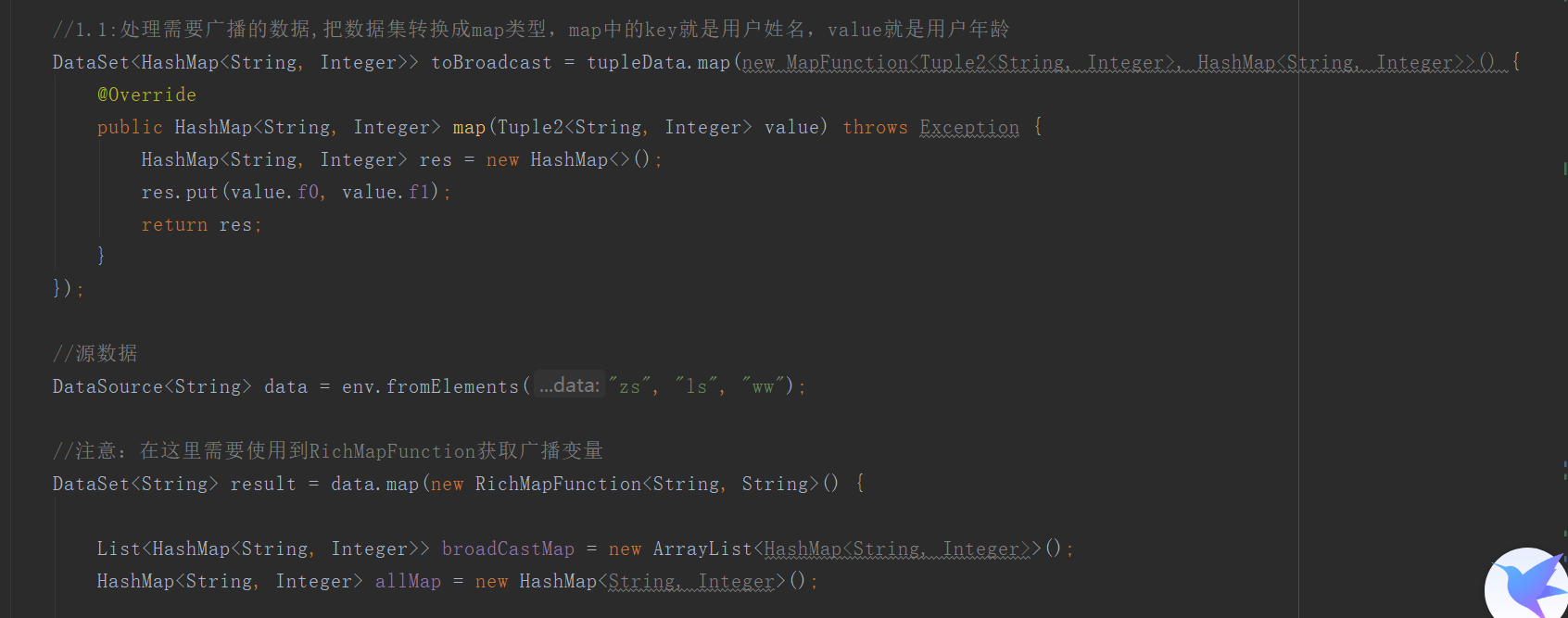

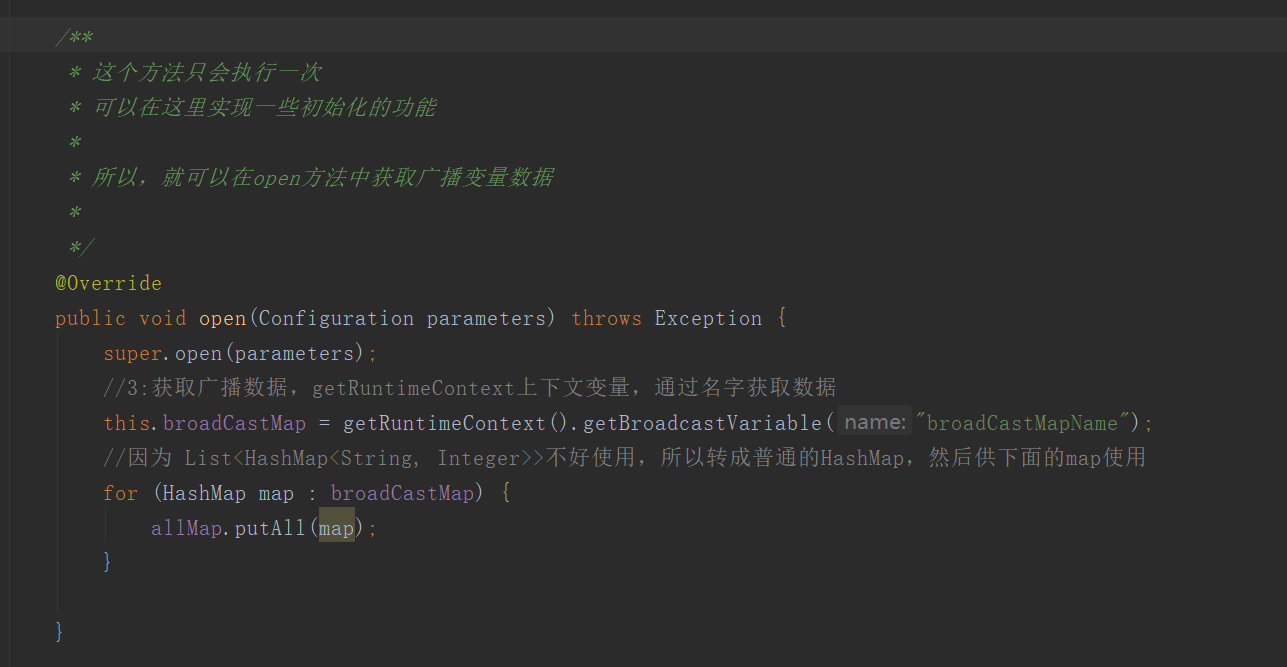

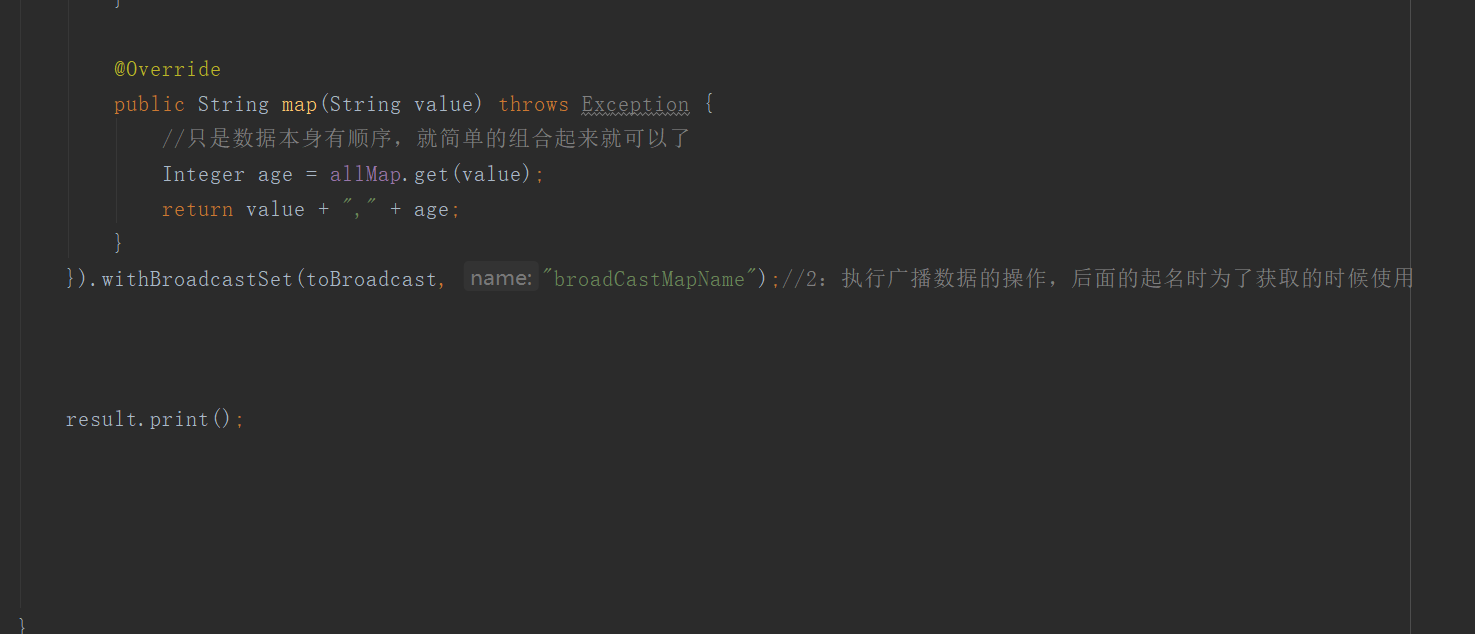

вЛОфЛАНтЪЭ ПЩвдРэНтЮЊЪЧвЛИіЙЋЙВЕФЙВЯэБфСП ЮвУЧПЩвдАбвЛИіdataset Ъ§ОнМЏЙуВЅГіШЅ ШЛКѓВЛЭЌЕФtaskдкНкЕуЩЯЖМФмЙЛЛёШЁЕН етИіЪ§ОндкУПИіНкЕуЩЯжЛЛсДцдквЛЗнЁЃШчЙћВЛЪЙгУbroadcast дђдкУПИіНкЕужаЕФУПИіtaskжаЖМашвЊПНБДвЛЗнdatasetЪ§ОнМЏ БШНЯРЫЗбФкДц(вВОЭЪЧвЛИіНкЕужаПЩФмЛсДцдкЖрЗнdatasetЪ§Он)ЁЃ

гУЗЈ

1 ГѕЪМЛЏЪ§ОнDataSet toBroadcast env.fromElements(1, 2, 3)2 ЙуВЅЪ§Он.withBroadcastSet(toBroadcast, broadcastSetName 3 ЛёШЁЪ§ОнCollection broadcastSet getRuntimeContext().getBroadcastVariable( broadcastSetNameзЂвт

1 ЙуВЅГіШЅЕФБфСПДцдкгкУПИіНкЕуЕФФкДцжа ЫљвдетИіЪ§ОнМЏВЛФмЬЋДѓЁЃвђЮЊЙуВЅГіШЅЕФЪ§Он ЛсГЃзЄФкДц Г§ЗЧГЬађжДааНсЪј2 ЙуВЅБфСПдкГѕЪМЛЏЙуВЅГіШЅвдКѓВЛжЇГжаоИФ етбљВХФмБЃжЄУПИіНкЕуЕФЪ§ОнЖМЪЧвЛжТЕФЁЃ2.ДњТыЪЕЯж

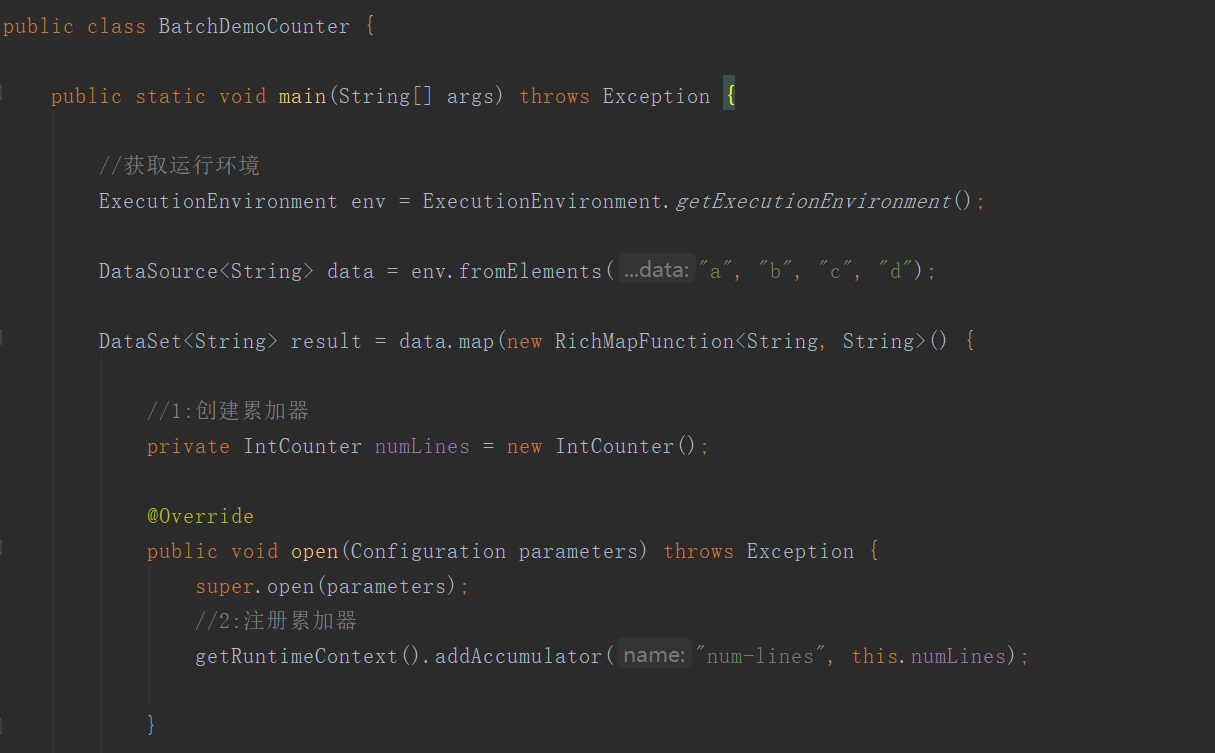

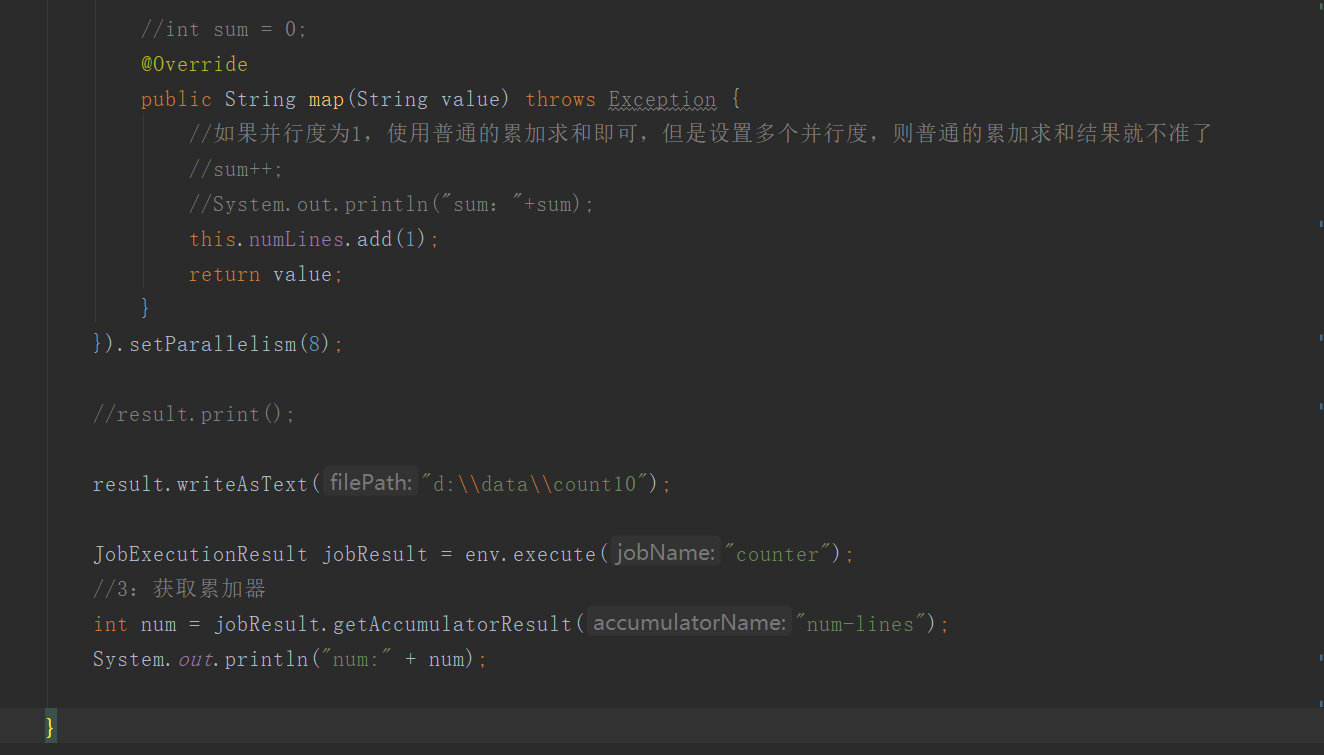

1.AccumulatorМДРлМгЦї гыMapreduce counterЕФгІгУГЁОАВюВЛЖр ЖМФмКмКУЕиЙлВьtaskдкдЫааЦкМфЕФЪ§ОнБфЛЏ

ПЩвддкFlink jobШЮЮёжаЕФЫузгКЏЪ§жаВйзїРлМгЦї ЕЋЪЧжЛФмдкШЮЮёжДааНсЪјжЎКѓВХФмЛёЕУРлМгЦїЕФзюжеНсЙћЁЃ

CounterЪЧвЛИіОпЬхЕФРлМгЦї(Accumulator)ЪЕЯж

IntCounter, LongCounter КЭ DoubleCounterlгУЗЈ

1 ДДНЈРлМгЦїprivate IntCounter numLines new IntCounter();2 зЂВсРлМгЦїgetRuntimeContext().addAccumulator( num-lines , this.numLines);3 ЪЙгУРлМгЦїthis.numLines.add(1);4 ЛёШЁРлМгЦїЕФНсЙћmyJobExecutionResult.getAccumulatorResult( num-lines )

2.ДњТы

дЫааНсЙћ

дЫааНсЙћ

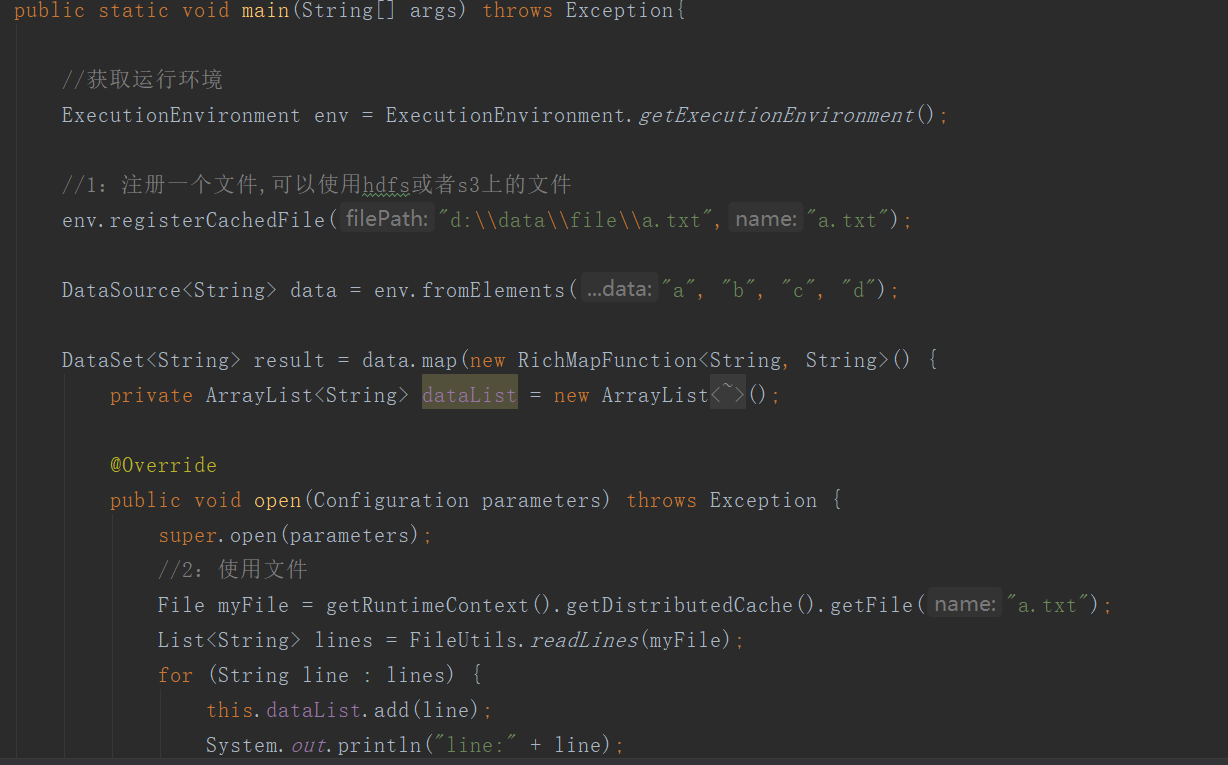

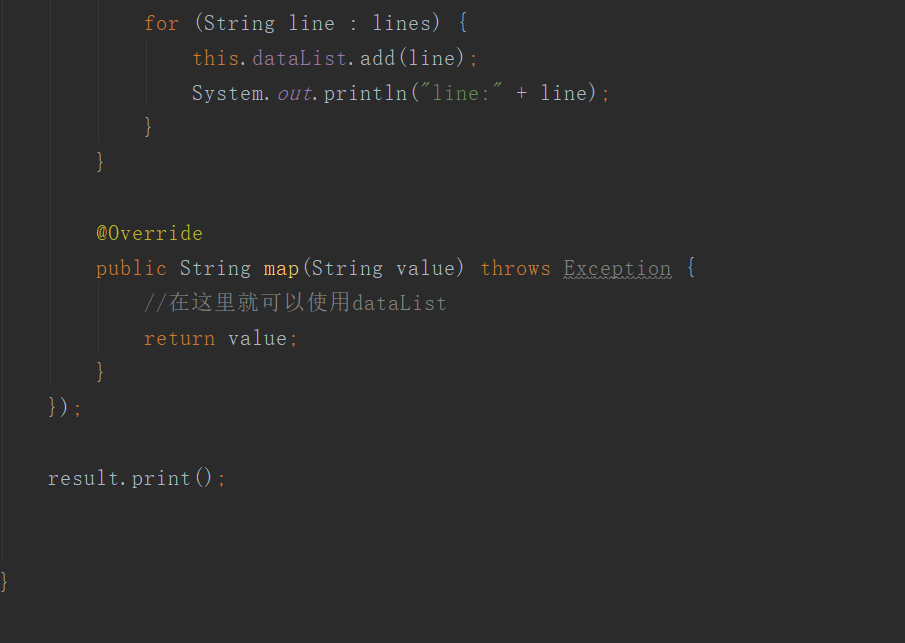

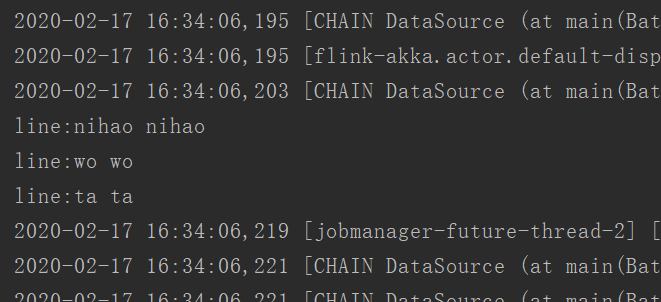

FlinkЬсЙЉСЫвЛИіЗжВМЪНЛКДц РрЫЦгкhadoop ПЩвдЪЙгУЛЇдкВЂааКЏЪ§жаКмЗНБуЕФЖСШЁБОЕиЮФМў

ДЫЛКДцЕФЙЄзїЛњжЦШчЯТ ГЬађзЂВсвЛИіЮФМўЛђепФПТМ(БОЕиЛђепдЖГЬЮФМўЯЕЭГ) ЭЈЙ§ExecutionEnvironmentзЂВсЛКДцЮФМўВЂЮЊЫќЦ№вЛИіУћГЦЁЃЕБГЬађжДаа FlinkздЖЏНЋЮФМўЛђепФПТМИДжЦЕНЫљгаtaskmanagerНкЕуЕФБОЕиЮФМўЯЕЭГ гУЛЇПЩвдЭЈЙ§етИіжИЖЈЕФУћГЦВщевЮФМўЛђепФПТМ ШЛКѓДгtaskmanagerНкЕуЕФБОЕиЮФМўЯЕЭГЗУЮЪЫќ

гУЗЈ

1 зЂВсвЛИіЮФМўenv.registerCachedFile( hdfs:///path/to/your/file , hdfsFile )2 ЗУЮЪЪ§ОнFile myFile getRuntimeContext().getDistributedCache().getFile( hdfsFileДњТы

дЫааНсЙћ

ЮвУЧЧАУцаДЕФword countЕФР§зг УЛгаАќКЌзДЬЌЙмРэЁЃШчЙћвЛИіtaskдкДІРэЙ§ГЬжаЙвЕєСЫ ФЧУДЫќдкФкДцжаЕФзДЬЌЖМЛсЖЊЪЇ ЫљгаЕФЪ§ОнЖМашвЊжиаТМЦЫуЁЃДгШнДэКЭЯћЯЂДІРэЕФгявхЩЯ(at least once, exactly once) Flinkв§ШыСЫstateКЭcheckpointЁЃ

ЪзЯШЧјЗжвЛЯТСНИіИХФю?

stateвЛАужИвЛИіОпЬхЕФtask/operatorЕФзДЬЌЁОstateЪ§ОнФЌШЯБЃДцдкjavaЕФЖбФкДцжаЁПЖјcheckpointЁОПЩвдРэНтЮЊcheckpointЪЧАбstateЪ§ОнГжОУЛЏДцДЂСЫЁП дђБэЪОСЫвЛИіFlink JobдквЛИіЬиЖЈЪБПЬЕФвЛЗнШЋОжзДЬЌПьее МДАќКЌСЫЫљгаtask/operatorЕФзДЬЌзЂвт taskЪЧFlinkжажДааЕФЛљБОЕЅЮЛЁЃoperatorжИЫузг(transformation)ЁЃStateПЩвдБЛМЧТМ дкЪЇАмЕФЧщПіЯТЪ§ОнЛЙПЩвдЛжИД

FlinkжагаСНжжЛљБОРраЭЕФState

Keyed StateOperator State

Keyed StateКЭOperator State ПЩвдвдСНжжаЮЪНДцдк

дЪМзДЬЌ(raw state)ЭаЙмзДЬЌ(managed state)ЭаЙмзДЬЌЪЧгЩFlinkПђМмЙмРэЕФзДЬЌ

ЖјдЪМзДЬЌ гЩгУЛЇздааЙмРэзДЬЌОпЬхЕФЪ§ОнНсЙЙ ПђМмдкзіcheckpointЕФЪБКђ ЪЙгУbyte[]РДЖСаДзДЬЌФкШн ЖдЦфФкВПЪ§ОнНсЙЙвЛЮоЫљжЊЁЃ

ЙЫУћЫМвх ОЭЪЧЛљгкKeyedStreamЩЯЕФзДЬЌЁЃетИізДЬЌЪЧИњЬиЖЈЕФkeyАѓЖЈЕФ ЖдKeyedStreamСїЩЯЕФУПвЛИіkey ЖМЖдгІвЛИіstateЁЃ

stream.keyBy(Ё)БЃДцstateЕФЪ§ОнНсЙЙ

ValueState:МДРраЭЮЊTЕФЕЅжЕзДЬЌЁЃетИізДЬЌгыЖдгІЕФkeyАѓЖЈ ЪЧзюМђЕЅЕФзДЬЌСЫЁЃЫќПЩвдЭЈЙ§updateЗНЗЈИќаТзДЬЌжЕ ЭЈЙ§value()ЗНЗЈЛёШЁзДЬЌжЕListState:МДkeyЩЯЕФзДЬЌжЕЮЊвЛИіСаБэЁЃПЩвдЭЈЙ§addЗНЗЈЭљСаБэжаИНМгжЕ вВПЩвдЭЈЙ§get()ЗНЗЈЗЕЛивЛИіIterableРДБщРњзДЬЌжЕReducingState:етжжзДЬЌЭЈЙ§гУЛЇДЋШыЕФreduceFunction УПДЮЕїгУaddЗНЗЈЬэМгжЕЕФЪБКђ ЛсЕїгУreduceFunction зюКѓКЯВЂЕНвЛИіЕЅвЛЕФзДЬЌжЕMapState:МДзДЬЌжЕЮЊвЛИіmapЁЃгУЛЇЭЈЙ§putЛђputAllЗНЗЈЬэМгдЊЫиашвЊзЂвтЕФЪЧ вдЩЯЫљЪіЕФStateЖдЯѓ НіНігУгкгызДЬЌНјааНЛЛЅ ИќаТЁЂЩОГ§ЁЂЧхПеЕШ Жјеце§ЕФзДЬЌжЕ гаПЩФмЪЧДцдкФкДцЁЂДХХЬЁЂЛђепЦфЫћЗжВМЪНДцДЂЯЕЭГжаЁЃЯрЕБгкЮвУЧжЛЪЧГжгаСЫетИізДЬЌЕФОфБњ

гыKeyЮоЙиЕФState гыOperatorАѓЖЈЕФstate ећИіoperatorжЛЖдгІвЛИіstate

БЃДцstateЕФЪ§ОнНсЙЙ

ListStateОйР§РДЫЕ FlinkжаЕФKafka Connector ОЭЪЙгУСЫoperator stateЁЃЫќЛсдкУПИіconnectorЪЕР§жа БЃДцИУЪЕР§жаЯћЗбtopicЕФЫљга(partition, offset)гГЩф

checkPointМђНщ

ЮЊСЫБЃжЄstateЕФШнДэад FlinkашвЊЖдstateНјааcheckpointЁЃ

CheckpointЪЧFlinkЪЕЯжШнДэЛњжЦзюКЫаФЕФЙІФм ЫќФмЙЛИљОнХфжУжмЦкадЕиЛљгкStreamжаИїИіOperator/taskЕФзДЬЌРДЩњГЩПьее ДгЖјНЋетаЉзДЬЌЪ§ОнЖЈЦкГжОУЛЏДцДЂЯТРД ЕБFlinkГЬађвЛЕЉвтЭтБРРЃЪБ жиаТдЫааГЬађЪБПЩвдгабЁдёЕиДгетаЉПьееНјааЛжИД ДгЖјаое§вђЮЊЙЪеЯДјРДЕФГЬађЪ§ОнвьГЃ

FlinkЕФcheckpointЛњжЦПЩвдгы(streamКЭstate)ЕФГжОУЛЏДцДЂНЛЛЅЕФЧАЬс

ГжОУЛЏЕФsource ЫќашвЊжЇГждквЛЖЈЪБМфФкжиЗХЪТМўЁЃетжжsourcesЕФЕфаЭР§згЪЧГжОУЛЏЕФЯћЯЂЖгСа БШШчApache Kafka RabbitMQЕШ ЛђЮФМўЯЕЭГ БШШчHDFS S3 GFSЕШ гУгкstateЕФГжОУЛЏДцДЂ Р§ШчЗжВМЪНЮФМўЯЕЭГ БШШчHDFS S3 GFSЕШФЌШЯcheckpointЙІФмЪЧdisabledЕФ ЯывЊЪЙгУЕФЪБКђашвЊЯШЦєгУ

checkpointПЊЦєжЎКѓ ФЌШЯЕФcheckPointModeЪЧExactly-once

checkpointЕФcheckPointModeгаСНжж Exactly-onceКЭAt-least-once

Exactly-onceЖдгкДѓЖрЪ§гІгУРДЫЕЪЧзюКЯЪЪЕФЁЃAt-least-onceПЩФмгУдкФГаЉбгГйГЌЕЭЕФгІгУГЬађ ЪМжебгГйЮЊМИКСУы

ФЌШЯcheckpointЙІФмЪЧdisabledЕФ ЯывЊЪЙгУЕФЪБКђашвЊЯШЦєгУ

StreamExecutionEnvironment env StreamExecutionEnvironment.getExecutionEnvironment();

// УПИє1000 msНјааЦєЖЏвЛИіМьВщЕуЁОЩшжУcheckpointЕФжмЦкЁП

env.enableCheckpointing(1000);

// ИпМЖбЁЯю

// ЩшжУФЃЪНЮЊexactly-once етЪЧФЌШЯжЕ

env.getCheckpointConfig().setCheckpointingMode(CheckpointingMode.EXACTLY_ONCE);

// ШЗБЃМьВщЕужЎМфгажСЩй500 msЕФМфИєЁОcheckpointзюаЁМфИєЁП

env.getCheckpointConfig().setMinPauseBetweenCheckpoints(500);

// МьВщЕуБиаыдквЛЗжжгФкЭъГЩ ЛђепБЛЖЊЦњЁОcheckpointЕФГЌЪБЪБМфЁП

env.getCheckpointConfig().setCheckpointTimeout(60000);

// ЭЌвЛЪБМфжЛдЪаэНјаавЛИіМьВщЕу

env.getCheckpointConfig().setMaxConcurrentCheckpoints(1);

// БэЪОвЛЕЉFlinkДІРэГЬађБЛcancelКѓ ЛсБЃСєCheckpointЪ§Он вдБуИљОнЪЕМЪашвЊЛжИДЕНжИЖЈЕФCheckpointЁОЯъЯИНтЪЭМћБИзЂЁП

env.getCheckpointConfig().enableExternalizedCheckpoints(ExternalizedCheckpointCleanup.RETAIN_ON_CANCELLATION);

State Backend(зДЬЌЕФКѓЖЫДцДЂ)

ФЌШЯЧщПіЯТ stateЛсБЃДцдкtaskmanagerЕФФкДцжа checkpointЛсДцДЂдкJobManagerЕФФкДцжаЁЃ

state ЕФstoreКЭcheckpointЕФЮЛжУШЁОігкState BackendЕФХфжУ

env.setStateBackend(Ё)вЛЙВгаШ§жжState Backend

MemoryStateBackendFsStateBackendRocksDBStateBackend

MemoryStateBackend

stateЪ§ОнБЃДцдкjavaЖбФкДцжа жДааcheckpointЕФЪБКђ ЛсАбstateЕФПьееЪ§ОнБЃДцЕНjobmanagerЕФФкДцжаЛљгкФкДцЕФstate backendдкЩњВњЛЗОГЯТВЛНЈвщЪЙгУFsStateBackend

stateЪ§ОнБЃДцдкtaskmanagerЕФФкДцжа жДааcheckpointЕФЪБКђ ЛсАбstateЕФПьееЪ§ОнБЃДцЕНХфжУЕФЮФМўЯЕЭГжаПЩвдЪЙгУhdfsЕШЗжВМЪНЮФМўЯЕЭГRocksDBStateBackend

RocksDBИњЩЯУцЕФЖМТдгаВЛЭЌ ЫќЛсдкБОЕиЮФМўЯЕЭГжаЮЌЛЄзДЬЌ stateЛсжБНгаДШыБОЕиrocksdbжаЁЃЭЌЪБЫќашвЊХфжУвЛИідЖЖЫЕФfilesystem uri вЛАуЪЧHDFS дкзіcheckpointЕФЪБКђ ЛсАбБОЕиЕФЪ§ОнжБНгИДжЦЕНfilesystemжаЁЃfail overЕФЪБКђДгfilesystemжаЛжИДЕНБОЕиRocksDBПЫЗўСЫstateЪмФкДцЯожЦЕФШБЕу ЭЌЪБгжФмЙЛГжОУЛЏЕНдЖЖЫЮФМўЯЕЭГжа БШНЯЪЪКЯдкЩњВњжаЪЙгУlаоИФState BackendЕФСНжжЗНЪНЕквЛжж ЕЅШЮЮёЕїећаоИФЕБЧАШЮЮёДњТыenv.setStateBackend(new FsStateBackend( hdfs://namenode:9000/flink/checkpoints Лђепnew MemoryStateBackend()Лђепnew RocksDBStateBackend(filebackend, true);ЁОашвЊЬэМгЕкШ§ЗНвРРЕЁПЕкЖўжж ШЋОжЕїећFlinkжЇГжВЛЭЌЕФжиЦєВпТд вддкЙЪеЯЗЂЩњЪБПижЦзївЕШчКЮжиЦє

МЏШКдкЦєЖЏЪБЛсАщЫцвЛИіФЌШЯЕФжиЦєВпТд дкУЛгаЖЈвхОпЬхжиЦєВпТдЪБЛсЪЙгУИУФЌШЯВпТдЁЃ ШчЙћдкЙЄзїЬсНЛЪБжИЖЈСЫвЛИіжиЦєВпТд ИУВпТдЛсИВИЧМЏШКЕФФЌШЯВпТд

ФЌШЯЕФжиЦєВпТдПЩвдЭЈЙ§ Flink ЕФХфжУЮФМў flink-conf.yaml жИЖЈЁЃХфжУВЮЪ§ restart-strategy ЖЈвхСЫФФИіВпТдБЛЪЙгУЁЃ

ГЃгУЕФжиЦєВпТд

ЙЬЖЈМфИє (Fixed delay)ЪЇАмТЪ (Failure rate)ЮожиЦє (No restart)ШчЙћУЛгаЦєгУ checkpointing дђЪЙгУЮожиЦє (no restart) ВпТдЁЃ

ШчЙћЦєгУСЫ checkpointing ЕЋУЛгаХфжУжиЦєВпТд дђЪЙгУЙЬЖЈМфИє (fixed-delay) ВпТд Цфжа Integer.MAX_VALUE ВЮЪ§ЪЧГЂЪджиЦєДЮЪ§

жиЦєВпТдПЩвддкflink-conf.yamlжаХфжУ БэЪОШЋОжЕФХфжУЁЃвВПЩвддкгІгУДњТыжаЖЏЬЌжИЖЈ ЛсИВИЧШЋОжХфжУ

жиЦєВпТджЎЙЬЖЈМфИє (Fixed delay)

lЕквЛжж ШЋОжХфжУ flink-conf.yaml

restart-strategy: fixed-delayrestart-strategy.fixed-delay.attempts: 3restart-strategy.fixed-delay.delay: 10 slЕкЖўжж гІгУДњТыЩшжУ

env.setRestartStrategy(RestartStrategies.fixedDelayRestart(3, // ГЂЪджиЦєЕФДЮЪ§Time.of(10, TimeUnit.SECONDS) // МфИє));жиЦєВпТджЎЪЇАмТЪ (Failure rate)

ЕквЛжж ШЋОжХфжУ flink-conf.yaml

restart-strategy: failure-raterestart-strategy.failure-rate.max-failures-per-interval: 3restart-strategy.failure-rate.failure-rate-interval: 5 minrestart-strategy.failure-rate.delay: 10 sЕкЖўжж гІгУДњТыЩшжУ

env.setRestartStrategy(RestartStrategies.failureRateRestart(3, // вЛИіЪБМфЖЮФкЕФзюДѓЪЇАмДЮЪ§Time.of(5, TimeUnit.MINUTES), // КтСПЪЇАмДЮЪ§ЕФЪЧЪБМфЖЮTime.of(10, TimeUnit.SECONDS) // МфИє));

жиЦєВпТджЎЮожиЦє (No restart)

ЕквЛжж ШЋОжХфжУ flink-conf.yaml

restart-strategy: noneЕкЖўжж гІгУДњТыЩшжУ

env.setRestartStrategy(RestartStrategies.noRestart());БЃДцЖрИіCheckpoint

ФЌШЯЧщПіЯТ ШчЙћЩшжУСЫCheckpointбЁЯю дђFlinkжЛБЃСєзюНќГЩЙІЩњГЩЕФ1ИіCheckpoint ЖјЕБFlinkГЬађЪЇАмЪБ ПЩвдДгзюНќЕФетИіCheckpointРДНјааЛжИДЁЃЕЋЪЧ ШчЙћЮвУЧЯЃЭћБЃСєЖрИіCheckpoint ВЂФмЙЛИљОнЪЕМЪашвЊбЁдёЦфжавЛИіНјааЛжИД етбљЛсИќМгСщЛю БШШч ЮвУЧЗЂЯжзюНќ4ИіаЁЪБЪ§ОнМЧТМДІРэгаЮЪЬт ЯЃЭћНЋећИізДЬЌЛЙдЕН4аЁЪБжЎЧА

FlinkПЩвджЇГжБЃСєЖрИіCheckpoint ашвЊдкFlinkЕФХфжУЮФМўconf/flink-conf.yamlжа ЬэМгШчЯТХфжУ жИЖЈзюЖрашвЊБЃДцCheckpointЕФИіЪ§

state.checkpoints.num-retained: 20етбљЩшжУвдКѓОЭВщПДЖдгІЕФCheckpointдкHDFSЩЯДцДЂЕФЮФМўФПТМ

hdfs dfs -ls hdfs://namenode:9000/flink/checkpointsШчЙћЯЃЭћЛиЭЫЕНФГИіCheckpointЕу жЛашвЊжИЖЈЖдгІЕФФГИіCheckpointТЗОЖМДПЩЪЕЯжlШчЙћFlinkГЬађвьГЃЪЇАм ЛђепзюНќвЛЖЮЪБМфФкЪ§ОнДІРэДэЮѓ ЮвУЧПЩвдНЋГЬађДгФГвЛИіCheckpointЕуНјааЛжИД

lbin/flink run -s hdfs://namenode:9000/flink/checkpoints/467e17d2cc343e6c56255d222bae3421/chk-56/_metadata flink-job.jar

lГЬађе§ГЃдЫааКѓ ЛЙЛсАДееCheckpointХфжУНјаадЫаа МЬајЩњГЩCheckpointЪ§Он

savePoint

FlinkЭЈЙ§SavepointЙІФмПЩвдзіЕНГЬађЩ§МЖКѓ МЬајДгЩ§МЖЧАЕФФЧИіЕуПЊЪМжДааМЦЫу БЃжЄЪ§ОнВЛжаЖЯ

ШЋОж вЛжТадПьееЁЃПЩвдБЃДцЪ§ОндДoffset operatorВйзїзДЬЌЕШаХЯЂ

ПЩвдДггІгУдкЙ§ШЅШЮвтзіСЫsavepointЕФЪБПЬПЊЪММЬајЯћЗб

checkPoint?vs?savePoint

checkPoint

гІгУЖЈЪБДЅЗЂ гУгкБЃДцзДЬЌ ЛсЙ§ЦкФкВПгІгУЪЇАмжиЦєЕФЪБКђЪЙгУsavePoint

гУЛЇЪжЖЏжДаа ЪЧжИЯђCheckpointЕФжИеы ВЛЛсЙ§ЦкдкЩ§МЖЕФЧщПіЯТЪЙгУзЂвт ЮЊСЫФмЙЛдкзївЕЕФВЛЭЌАцБОжЎМфвдМА Flink ЕФВЛЭЌАцБОжЎМфЫГРћЩ§МЖ ЧПСвЭЦМіГЬађдБЭЈЙ§ uid(String) ЗНЗЈЪжЖЏЕФИјЫузгИГгш ID етаЉ ID НЋгУгкШЗЖЈУПвЛИіЫузгЕФзДЬЌЗЖЮЇЁЃШчЙћВЛЪжЖЏИјИїЫузгжИЖЈ ID дђЛсгЩ Flink здЖЏИјУПИіЫузгЩњГЩвЛИі IDЁЃжЛвЊетаЉ ID УЛгаИФБфОЭФмДгБЃДцЕу savepoint НЋГЬађЛжИДЛиРДЁЃЖјетаЉздЖЏЩњГЩЕФ ID вРРЕгкГЬађЕФНсЙЙ ВЂЧвЖдДњТыЕФИќИФЪЧКмУєИаЕФЁЃвђДЫ ЧПСвНЈвщгУЛЇЪжЖЏЕФЩшжУ IDЁЃsavePointЕФЪЙгУ

1 дкflink-conf.yamlжаХфжУSavepointДцДЂЮЛжУ

ВЛЪЧБиаыЩшжУ ЕЋЪЧЩшжУКѓ КѓУцДДНЈжИЖЈJobЕФSavepointЪБ ПЩвдВЛгУдкЪжЖЏжДааУќСюЪБжИЖЈSavepointЕФЮЛжУstate.savepoints.dir: hdfs://namenode:9000/flink/savepoints2 ДЅЗЂвЛИіsavepointЁОжБНгДЅЗЂЛђепдкcancelЕФЪБКђДЅЗЂЁП

bin/flink savepoint jobId [targetDirectory] [-yid yarnAppId]ЁОеыЖдon yarnФЃЪНашвЊжИЖЈ-yidВЮЪ§ЁПbin/flink cancel -s [targetDirectory] jobId [-yid yarnAppId]ЁОеыЖдon yarnФЃЪНашвЊжИЖЈ-yidВЮЪ§ЁП3 ДгжИЖЈЕФsavepointЦєЖЏjob

bin/flink run -s savepointPath [runArgs]THE END

ЙЋЫОНщЩм ЮвУЧЙЋЫОЪЧЩЯКЃиОиОМвШэМўгаЯоЙЋЫОЃЌжївЊвЕЮёЪЧзАаоЩшМЦЦНЬЈЃЌгавЛИіЙй...

ШчЙћЫЕЛЅСЊЭјаавЕЪЧФаГЬађдБЕФЬьЯТЃЌетвЛЖЈЪЧЕБНёЩчЛсжаЕФЦЋМћСЫЁЃХЎадСІСПвбО...

ЭЦНјЙњМвжЮРэЬхЯЕКЭжЮРэФмСІЯжДњЛЏЃЌБиаызЅКУГЧЪажЮРэЬхЯЕКЭжЮРэФмСІЯжДњЛЏЃЌСь...

Kakfa ЙуЗКгІгУгкЙњФкЭтДѓГЇЃЌР§Шч BATЁЂзжНкЬјЖЏЁЂУРЭХЁЂNetflixЁЂAirbnbЁЂTwit...

-ИќЖрЙигкЪ§жЧЛЏзЊаЭЁЂЪ§ОнжаЬЈФкШнЧыМгШы АЂРядЦЪ§ОнжаЬЈНЛСїШКЁЊЪ§жЧОуРжВП КЭ...

ЙКТђ дЦЗўЮёЦї ЕФСїГЬЃПШчЙћвбОбЁЖЈСЫдЦЗўЮёГЇЩЬЃЌЦфЪЕећИі дЦЗўЮёЦї ЕФЙКТђСї...

РДдД | АЂРяАЭАЭдЦдЩњЙЋжкКХ НќШеЃЌGartner ЗЂВМСЫЁЖ2021 Фъ Gartner APM ФЇСІ...

ЯыСЫНтИќЖрФкШнЃЌЧыЗУЮЪЃК 51CTOКЭЛЊЮЊЙйЗНеНТдКЯзїЙВНЈЕФКшУЩММЪѕЩчЧј https://...

НќШеЃЌгРВЛТфФЛЕФЪ§ВЉЛс2020ЯЕСаЛюЖЏДѓЪ§ОнВњвЕЩњЬЌНЈЩшгыЗЂеЙИпЗхЛсдкББОЉейПЊ...

ЮвГЩЮЊЪ§ОнПЦбЇМвЪЧвђЮЊЮвзюЯВЛЖевЕННтОіИДдгЮЪЬтЕФНтОіЗНАИЃЌЙЄзїЕФДДдьадВПЗж...